Hirdetés

- Luck Dragon: Asszociációs játék. :)

- Luck Dragon: Óraátállítás

- sziku69: Szólánc.

- sziku69: Fűzzük össze a szavakat :)

- Bethesda kórház

- NvidiaRTX: Xiaomi Electric Scooter 6 Max: Az első rollerem

- sidi: 386-os Chicony gázplazma laptop memóriabővítése

- Brain turbó: Intel Xeon CPU asztali alaplapban

- D1Rect: Nagy "hülyétkapokazapróktól" topik

- Hieronymus: Hogyan parkolj hátramenetben profi módon

Új hozzászólás Aktív témák

-

Raymond

titán

válasz

Petykemano

#46199

üzenetére

Petykemano

#46199

üzenetére

Ez nem szerencse kerdese. Szerintem Kezd azzal hogy lenyugszol egy picit, megnezed mi is az a Cuda P2 State hogy milyen hatasa van milyen orajelekre aztan ha meg van kedved akkor elmondhatod itt hogyan veszi valaki eszre normalis hasznalat mellett.

-

huskydog17

addikt

Returnal PC Teszt - ComputerBase

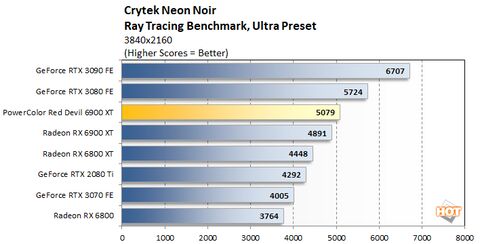

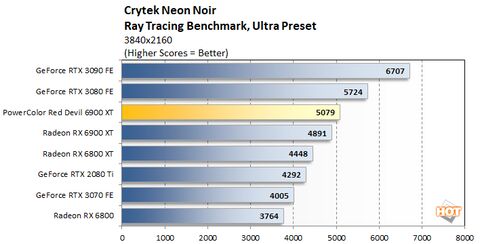

Meglepően gyors lett a játék, szokatlanul magas a sebesség, de az egészet beárnyékolja a szokásos UE4 stutterfest.

Itt legalább normális VRAM használatot láthatunk. 8 GB VRAM még 1440p-hez is elegendő. 4K+RT kombóhoz pedig 12 GB elegendő.

1080p+RT kombóhoz egy RTX 3060Ti is elegendő a stabil 60 fps-hez.

Ebben a játékban az RT-nek viszont semmi értelme, mert semmit nem tesz hozzá a látványhoz (mert a játék alapból nagyon sötét), cserébe eszi a teljesítményt. Néhány tócsánál az RT Reflection ad különbséget, de a CB ez is ritkán fordul elő, az RT árnyékoknak pedig abszolút semmi értelme, az csak egy checklist feature. A lényeg, hogy ebben a játékban a játékos semmit nem veszít ha kikapcsolja az RT-t (pontosabban nem kapcsolja be).

A grafikon majd bővülni fog, mert nem volt még elég idő minden VGA-t letesztelni, de úgy tűnik, hogy egy sima RTX 3060-as is bőven elegendő lesz 1080p-re a stabil 60 fps-hez (RT nélkül talán még egy 2060-as is).

Nem értem, hogy egy ilyen nagy címeknél, ami mögött rengeteg pénz van, miért kell erőltetni még mindig ezt a hulladék UE4-et, amikor már köztudott évek óta, hogy súlyos gondok vannak vele és évek óta szenvednek emiatt a PC játékosok.

Egy másik szögből nézve a kérdést: ha már mindenképp UE4-en történik a fejlesztés, a készítők egész biztosan tökéletesen tisztában vannak azzal, hogy mekkora rakás fos a motor frame pacing szempontból és mégse tesznek ellene semmit, kiadják ilyen katasztrofális frame pacing-gel aztán majd release után talán megpróbálnak csinálni vele valamit, ha elég nagy backlash-t kap a játék. Miért kell ezt, miért nem lehet rögtön release-re rendbe tenni a frame pacing-et, miért kell szándékosan szopatni a PC playereket? Látjuk rengeteg játéknál, hogy ez szimplán hanyagság, sok olyan játék van, ami így jött ki és néhány nap alatt a készítők belepatcheltek egy shader precompilation-t, ami az akadások nagy részét megszünteti.

Egyszerűen számomra teljesen érthetetlen, hogy miért nem képesek release-re a játékba rakni akár opcionálisan egy shader precompilation-t. Rengeteg problémát megoldana, valamiért mégis megvárják, hogy lesz-e anyázás. Ezen felül az, hogy egy eddig PS5 exkluzív címnél sem foglalkoznak vele, ahol van pénz bőven, finoman fogalmazva nagyon gáz.

Itt most ennyire trágya az UE4, hogy ezt nehéz megtenni vagy egyszerűen az UE4-et alkalmazó játékfejlesztők többsége leszarom hozzáállása okozza a gondot? Másképpen fogalmazva a kérdést: technikai akadálya van vagy emberi hanyagság? Ha technikai akadálya van, mitől lehet az, hogy számos UE4 játéknál néhány nap alatt rendbe tudták tenni az akadásokat (pl. Callisto Protocoll)?

Szerintem pont erről az igencsak súlyos problémáról lenne jó valamilyen cikk itt PH-n, hogy ezt hogyan lehetne végleg felszámolni és mi az oka. -

HSM

félisten

válasz

Petykemano

#46196

üzenetére

Petykemano

#46196

üzenetére

"Ha AMD kártyával tapasztalunk valamilyen problémát az az AMD driver hibája."

Van egy önbeteljesítő jóslat jellege szerintem a dolognak. De ezt én is megfigyeltem.

Többször találkoztam olyannal, hogy pl. büszke, de vélhetőeg instabil CPU tuning/undervolt után az illető megjelent az AMD VGA topikban, hogy összedőlt a drivert, meg fekete kép, stb, szinte evidenciának véve, hogy a driverrel van a baj... Nv-nél pont fordítva van, ha a driver beteg, akkor is másban keresik a hibát.

-

Petykemano

veterán

válasz

Busterftw

#46192

üzenetére

Busterftw

#46192

üzenetére

> miert lenne ez az Nvidia sara?

Ha Nvidia kártyával tapasztalunk valamilyen problémát, az a MS hibája, az api hibája, az optimalizálatlan szoftver hibája, a third party szoftver hibája.

Ha AMD kártyával tapasztalunk valamilyen problémát az az AMD driver hibája.> AMD-nel ha nem dupla annyi volt az entry, de sokkal tobb.

Én nem állítottam, hogy melyik cégnél van több vagy kevesebb.

Még csak azt sem, hogy mondanám, hogy a hibák mennyiségének 20-30-50%-kal magasabb mennyisége ne jelenthetne ez ennél lényegesen nagyobb eltérést a vásárlási hajlandóságban.Csak azt a kérdést feszegetem, hogy miért van az, hogy az emlékezetben az marad meg, hogy az Nvidia hibátlan, az AMD driver meg bughalmaz?

És hogy vajon ennek oka lehet-e az, hogy például az AMD találgatósba, vagy a redditre mindig eltalál valaki valami AMD-vel összefüggő problémáról hangoskodni, az NVidia találgatósba meg nem. -

Raymond

titán

válasz

Petykemano

#46191

üzenetére

Petykemano

#46191

üzenetére

"De érdekes módon az Nvidia találgatósban még egyetlen lelkes, de elégedetlen Nvidia rajongó sem hőbörgött azon, hogy az felhasználói élményét rontotta az Nvidia bughalmaz drivere discord használat közben."

Gondolom azert mert eszre se vettek. Annyi torrent hogy a VRAM a Cuda P2 State orajeleken ment ami par szazalek nominalis csokkentes es a jatekombal a teljesitmenyben nem veszed eszre csak ha benchmark szamokat hasonlitasz ossze.

-

omfgk

veterán

válasz

Petykemano

#46187

üzenetére

Petykemano

#46187

üzenetére

Inkább marketingfogás ez...

Több helyen is írják ,hogy ezeket az állítólagos készleteket egyébként senki nem látta.

-

Yutani

nagyúr

válasz

Petykemano

#46191

üzenetére

Petykemano

#46191

üzenetére

-

Busterftw

nagyúr

válasz

Petykemano

#46191

üzenetére

Petykemano

#46191

üzenetére

Discord frissites okozta a problemat egyes Nvidia kartyakon, miert lenne ez az Nvidia sara?

Konkretan 31-en erkeztek a hirek a problemarol, az Nvidia ra 3 napra lekommunikalta hogy kesz a fix, toltheto.Amugy en par eve Excelbe szedtem egyik ev Nvidia/AMD driver megjeleneseit, kijavitott hibak szamat es a "known issues" reszt. (jatek profilokat nem szamolva)

AMD-nel ha nem dupla annyi volt az entry, de sokkal tobb. -

Petykemano

veterán

Normál körülmények között nem szoktam az ilyeneket felkapni. És nem is célom kereszteshadjáratot űzni.

Csak volt jómúltkorjában ez a téma az AMD találgatósban lényegében arról, hogy miért őrződik meg az emlékekben jobban az AMD hibái és miért felejtődnek el az Nvidiáé és hogy ezzel összefüggésben vajon igaz vagy hamis percepció-e az, hogy az Nvidia drivere jobb és/vagy kevesebbszer tartalmaz hibát, mint az AMD? Pontosabban megfogalmazva, hogy tartalmaz-e az AMD driver annyival több mennyiségű, minőségű hibát vagy annyival gyakrabban, hogy az indokolja a piaci részesedést közötti hibát. [link]

Azóta már azt is megállapítottam, hogy természetesen az AMD találgatósba be lett doba lelkes, de elégedetetlen AMD rajongók által, hogy nem jött két hónapja driver, meg hogy elhasal az AMD a varázslós játékban RT alatt és szörnyű.

De érdekes módon az Nvidia találgatósban még egyetlen lelkes, de elégedetlen Nvidia rajongó sem hőbörgött azon, hogy az felhasználói élményét rontotta az Nvidia bughalmaz drivere discord használat közben.

az RDNA2 driverfrissítés megérkezését követően felmerült problémák kapcsán Ismét fellángolt a vita. Mivel nekem szembejött ez, fenti téma köré mementóként álljon itt ez a két gyűjtés:

[link]

Ide idézném Fless szavait is:

"Amíg egy kicsit is tájékozottabb OEM menedzser az AMD drivergondjai miatt síró emberkéket lát..."Nem végeztem számossági összehasonlítást, hogy vajon AMD driver probléma miatt síró emberek a redditen, vagy az Nvidia drivergondok miatt az Nvidia fórumán síró emberek lehetnek-e többen.

Lehetséges volna, hogy a Geforce Experience regisztrációhoz kötött használata valójában intelligens damage control mechanizmus, amivel az NVidia betereli a saját fórumába a panaszokat ahelyett, hogy azt szétkürtölnék a redditre?Mivel azt nem is merném feltételezni, hogy esetleg az Nvidia irányában elkötelezettek járnának sírni a redditre az AMD driverproblémái miatt, ezért feltételezem az AMD-nek nincs ilyen fóruma, ahol a problémákat lehetne jelenteni/megosztani a közösséggel?

-

válasz

Petykemano

#46187

üzenetére

Petykemano

#46187

üzenetére

Kérdéses, hogy a valóságban hány darab volt elérhető ezeken az árakon

-

HSM

félisten

válasz

huskydog17

#46188

üzenetére

huskydog17

#46188

üzenetére

A 420$-os RTX3080 azért durván jó vétel!

Azért végigondolva vicces így a product stack, RTX3060Ti-399$, RTX3060Ti+20$=RTX3080, RTX3080+180$=RTX3070.

-

huskydog17

addikt

válasz

Petykemano

#46187

üzenetére

Petykemano

#46187

üzenetére

Mindegyik elfogyott, ami nem is csoda, ezek elég brutális akciók, főleg a 420 dolláros 3080-as iszonyat jó vétel, így nem csoda, hogy mindet elvitték pár óra alatt. Amúgy szerintem egyéni raktársöprés, ahogy a videocardz is írja:

"However, this is a good sign that even NVIDIA premium retail partners are now expecting to upgrade their inventory to next-gen series, which are hopefully coming in the following weeks."Kár, hogy itthon ilyen akciókat nem nagyon látni. 420 dolcsiért én is gondolkodás nélkül beruháznék egy 3080-ra.

-

Petykemano

veterán

BestBuy price cuts (MSRP → new price):

GeForce RTX 3090 Ti: $1999.99 → $879.99

GeForce RTX 3080 Ti: $1199.99 → $719.99

GeForce RTX 3080: $699.99 → $419.99

GeForce RTX 3070: $599.99

GeForce RTX 3060 Ti: $399.99

GeForce RTX 3060: $329.99 → $299.99

[link]Elszigetelt jelenség? Végkiárusítás?

Lehet valami oka a mozgolódásnak? -

Raggie

őstag

válasz

FLATRONW

#46180

üzenetére

FLATRONW

#46180

üzenetére

A bugok keresése és a tesztelés szempontjából a gyártók felől nézve egyáltalán nem számít a piaci részesedés, csak a VGA modellek száma.

Kb ugyanannyi VGA típus van a két oldalon, tehát ogyanannyi fajta hardveren kell letesztelni a dolgokat. De mivel egy játékban lévő bugot nem feltétlenül gyártói feladat megtalálni és kijavítani ez nem is annyira lényeges szerintem.

A játékfejlesztői oldalról viszont nagyon is számít a piaci részesedés, mert azt szeretnéd, hogy a lehető legtöbb felhasznló jusson lehető legjobb élményhez. Magyarán ha racionálisan szeretnéd elkölteni a tesztelési időt akkor a legnagyobb részedeséssel bíró VGA-któl haladsz a legkisebb részesedéssel bíró VGA-kig. Így tehát favorizálva lesznek az NV kártyák és az azokon előjövő grafikai bugok hamarabb lesznek kijavítva.

Szerntem ez így logikus. -

HSM

félisten

válasz

Busterftw

#46182

üzenetére

Busterftw

#46182

üzenetére

"csucsot csuccsal illik osszehasonlitani"

Szerintem azonos árkategóriát van értelme összehasonlítani, márpedig a 7900XTX a RTX4080 árán van, egészen pontosan többnyire picivel alatta. A 4090 lényegesen drágább ezeknél."Illetve mi ertelme beerni az Nvidiat, ha ilyen orbitalis bugok vannak jatekokban?"

Nincsenek orbitális bugok. BFV-ben tapasztaltam a 6800XT-vel azt az RT-s bugot, ami eléggé hasonlónak tűnik ehhez a másikhoz. Tehát igen, van egy vagy két bug, amiről tudunk. Ezen kívül nálam teljesen rendben van a 6800XT."...hogy kb mindenki Radeonon fejleszt."

A kulcsszó: fejleszt. Én tesztelésről beszéltem, ha úgy tetszik QA [link] . -

FLATRONW

őstag

Szerintem nem. A konzoloknak is nagy előnyük, hogy egy konfigra megy a fejlesztés.

A fejlesztők letesztelik néhány népszerű összeállításon, hibátlan szoftveres háttér mellett a játékukat.

Viszont jóval nagyobb részük van a hibátlan futtatásban a gyártóknak. Egy stabil drivert kell letenni az asztalra, ami minél kevesebb dologgal akad össze. Itt pedig nagy "hátrány" a nagy piaci részesedés. -

Busterftw

nagyúr

16 jatek average-ban kb hibahataron beluli 3-5 fps kulonbseg van.

Azt mar nem emlitem meg, hogy csucsot csuccsal illik osszehasonlitani, ami ugye nem a 4080, hanem a 4090.

Illetve mi ertelme beerni az Nvidiat, ha ilyen orbitalis bugok vannak jatekokban?

Mert ez az user vesz egyet, par jatekban ilyen gany hibak vannak es garantalom neked lecsereli kovetkezore egy Nvidiara. Topikbol van tobb pelda, vagy jatek, vagy driver vagy VR miatt."tehát PC-re Nv-n..."

Erdekes, Abu anno epp azt mondta, hogy kb mindenki Radeonon fejleszt. Illetve RDNA-n, hiszen konzol is kepben van. -

HSM

félisten

Jogos észrevétel, ez is arra való.

Azt most nem tudom neked megmondani pontosan, miért volt megjelenésekor előrébb az AMD-s verzió, ennyire nem ismerem őket behatóan. De vélhetőleg nem véletlen lelkendezett több fejlesztő, hogy végre jobban belelátnak a működésbe.

Azt most nem tudom neked megmondani pontosan, miért volt megjelenésekor előrébb az AMD-s verzió, ennyire nem ismerem őket behatóan. De vélhetőleg nem véletlen lelkendezett több fejlesztő, hogy végre jobban belelátnak a működésbe.

#46178 Busterftw : Legfrisebb információim szerint Nv-n az RT fut csak lényegesen gyorsabban, RT nélkül pl. a 7900XTX még le is lépi a 4080-at. Ami annyira nem is meglepő, hiszen az Nv a GPU-ba jelentősen több ezt gyorsító részegységet pakolt.

#46180 FLATRONW : A piaci részesedés épp nekik kedvez... Hiszen, ha játékfejlesztő vagy, elsősorban a vásárlóbázisodnak megfelelő gépekkel fogsz tesztelni kiadás előtt, tehát PC-re Nv-n...

-

-

-

-

PuMbA

titán

De ilyenje az NVIDIA-nak is van: NVIDIA Nsight Graphics

Ha legörgetsz, akkor ott van pont egy Unreal Engine-es példa is a Hellblade: Senua's Sacrifice személyében.

Ha legörgetsz, akkor ott van pont egy Unreal Engine-es példa is a Hellblade: Senua's Sacrifice személyében. -

HSM

félisten

válasz

Busterftw

#46175

üzenetére

Busterftw

#46175

üzenetére

Megint képzavar...

Az, hogy a Radeonon profilozod a kódot, és a Radeonon megtalálod a teljesítmény szempontjából problémás részeket, az utána jó eséllyel Nv-n is jobban futó, problémamentesebb kódot fog adni. Ha ez nem lenne, keresgélhetné a fejlesztő Nv-n vakon, miért fut lassan a kódja...

Ha jól emlékszem, az egyik UE fejlesztő örült nagyon twitteren, hogy egyből találtak a profilozóval egy kódrészletet a motorban, ami feleslegesen zabált erőforrást, és amiről addig senki nem tudott, mert nem volt eszköz, amivel láthatóvá vált volna.

Az, hogy bizonyos játékokkal előfordulnak bugok, az nem ezzel áll összefüggésben. -

Busterftw

nagyúr

Nem csak, hogy jobb kod szulessen:

"elsődlegesen az az előnye, hogy a RenderDoc és a Radeon GPU Profiler együtt fejlődik, és egymáshoz vannak írva. Ilyen formában a fejlesztők számára nagyságrendekkel könnyebb Radeonon fejleszteni, mert van egy debug eszköz, ami tökre jól használható a Radeon profilozójával"

"Tehát ha találsz egy problémát, akkor egy kattintás azt leellenőrizni az AMD profilozójában."Aztan valamiert megis Nvidian fut altalnossagban gyorsabban valami es/vagy kevesebb problemaval. Ha meg hiba van, akkor gyorsabban jon Nvidiatol/fejslztotol megoldas.

-

HSM

félisten

válasz

Busterftw

#46172

üzenetére

Busterftw

#46172

üzenetére

"az AMD elvileg csinalt egy ubertechnika debuggert es profilozot"

Ami abban segít, hogy jobb kód szülessen, ami utána akármilyen hardveren jobban és problémamentesebben fog futni.

Tehát arról van szó, hogy ez ismét egy olyan AMD fejlesztés, ami összességében minden gamer számára jó.

#46173 PuMbA: Ha meggyőzött volna kellően a 3060, akkor adtam volna el a 6800XT-t is, és jött volna helyette egy 3080 vagy 3090. Mondjuk a 3090 helyett már inkább kicsit többért egy 7900XT, azt még lehet idővel meg is lépem.

Persze, vonzó opció lett volna az is, ha az 'olcsó' 3060 a 'szuper' DLSS-el hozza a 6800XT natív RT tempóját, de messze volt a DLSS-es képminőség a számomra elfogadhatótól.

-

Busterftw

nagyúr

Ezek ugye azok a bizonyos "velemenycikkek".

HSM

A hozzaszolasnak az a lenyege, hogy az AMD elvileg csinalt egy ubertechnika debuggert es profilozot, amivel pikkpakk latnak minden hibat, bugot, bezzeg az Nvidianak ilyen nincs.

A valosag meg amint lathatod az, hogy ennek ellenere a Radeonokon sokkal tobb a hiba es a bug illetve ezek javitasa honapokba telhet. -

HSM

félisten

válasz

Raymond

#46167

üzenetére

Raymond

#46167

üzenetére

A hozzászólásból nekem az is átjött, hogy az opensource és a jó debugger felesleges, hiszen ugyanúgy maradhatnak bugok. Ezt szerettem volna tisztázni, hogy ez nem így működik.

#46168 PuMbA : A jó debugger az Nv hardvereken is segít jobban futó kódot alkotni... Az open source pedig azért jó, mert kis csúsztatással nem fog a fejlesztő a tudta nélkül pl. világrekorder részletességű betontömböt számolni a VGA-n a feketedoboz middleware-el.

Nv-n nekem amúgy nem volt játékban grafikai bugom, AMD-n is csak az az egy, amit említettem. Viszont az Nv másfélszer akkora méretű drivere volt, hogy sikertelenül installált, és a control centert is sikerült párszor összezavarjam. Az experience-t meg fel sem raktam, nem fogok nekik csinálni accountot is. Ezek meg AMD-n működtek jobban és sokkal kényelmesebben.

#46170 PuMbA: Én a gyakorlatban is a Radeont tartottam meg, nem az RTX-et...

-

PuMbA

titán

válasz

huskydog17

#46169

üzenetére

huskydog17

#46169

üzenetére

Ilyen hírek / cikkek kellenének a PH-ra is, mert az elméleti dolgokban az AMD tényleg jobb és a PH főként elméleti dolgokkal van tele. A gyakorlatban viszont többször az NVIDIA a jobb és erről meg nem látunk semmit a PH-n. Csak ezért tűnik úgy, hogy AMD fényezés van itt, mert elméleti dolgokról folynak a diskurzusok

Ha lennének a konkrét tesztek, játék elemzések (a lá DigitalFoundry), akkor egyből más lenne a helyzet.

Ha lennének a konkrét tesztek, játék elemzések (a lá DigitalFoundry), akkor egyből más lenne a helyzet. -

huskydog17

addikt

válasz

huskydog17

#46163

üzenetére

huskydog17

#46163

üzenetére

Kiegészítés

Itt a témához kapcsolódó AMD-s Reddit topic:

7900XT white grass and bush rendering issueSajnos még itt sem reagált az AMD.

A játékhoz kapcsolódó további érdekes technikai teszt:

Hogwarts Legacy: FSR 2.1 vs. XeSS vs. DLSS 3 Comparison ReviewAkit csak a konklúzió érdekel:

"Hogwarts Legacy is an action game with a lot of small particle effects on screen during combat, so when using any temporal upscaling solutions, the stability of the image is key to enjoyable gameplay. When using DLSS, the image was stable in motion in all Quality modes, the level of detail rendered in vegetation and tree leaves is improved in comparison to the in-game TAA solution, and small details in the distance, such as thin steel objects, are rendered more correctly and completely. The FSR 2.1 implementation comes with a few compromises in image quality—in favor of performance in most sequences of the game. We spotted excessive shimmering and flickering on character hair, vegetation and tree leaves; they are shimmering even when standing still. This is the same level of shimmering that we've previously seen in The Witcher 3 Wild Hunt with FSR 2.1. XeSS on the other hand, does not have these shimmering issues at all, but XeSS is suffering from ghosting at medium and far distances. Flying birds have black trails behind them, for example. To be fair, DLSS also has these shimmering problems, but only in motion at extreme angles, and with DLSS you have the ability to minimize these issues by upgrading to the newer DLSS version 2.5.1.

The NVIDIA DLSS Frame Generation is excellent, the overall image quality is quite impressive. Even small flying particle effects, such as different varieties of magic spells, are rendered correctly, during with fast movement. However, there's also a few important issues of note. We spotted excessive shimmering and flickering in motion on tree leaves and vegetation at 1440p and below, but it is less pronounced when compared to the FSR 2.1 shimmering issues. Also, as mentioned in our performance review, you can't enable Frame Generation without enabling DLSS first. The issue is that the developers falsely assumed that enabling DLSS 3 Frame Generation, requires enabling DLSS 2 Upscaling, too. If you want to use Frame Generation with DLAA instead of DLSS: enable DLSS in the menu, then enable Frame Generation and only after that enable DLAA. Many other DLSS Frame Generation games that we've tested had issues with the in-game on-screen UI, which had a very jittery look—the DLSS Frame Generation implementation in Hogwarts Legacy does not have this issue."Itt is a megszokott felállás következett be: DLSS adja a legjobb minőséget a három felskálázis metódus közül. FG is kiválóan működik.

-

PuMbA

titán

-

HSM

félisten

Összekeversz dolgokat...

Az open source nem azért jó, hogy ne legyenek bugok, hanem hogy a fejlesztő lássa, mi történik, jól tudjon optimalizálni, és jól tudja beépíteni a szoftverbe. A debugger meg a problémák megtalálásában segít, de a megléte nem elég a csodához, ahhoz kell a fejlesztő is, aki használja a problémák felderítésére. -

PuMbA

titán

válasz

huskydog17

#46163

üzenetére

huskydog17

#46163

üzenetére

Az AMD-nél nagyon béna emberek dolgozhatnak, ha a szuper open szósz debugger cuccukkal, amivel egy-kettőre felfedeznek minden hibát a játékmotorba és ami az NVIDIA-nak nincs, is több hibájuk van a megjelenő játékokban az NVIDIA-nál. Vagy még se annyira világmegváltó dolog az open szósz és ezért nem is foglalkozik vele annyira az NVIDIA

-

HSM

félisten

válasz

huskydog17

#46163

üzenetére

huskydog17

#46163

üzenetére

Érdekesség, hogy egy első ránézésre rendkívül hasonló jelenséggel találkoztam BFV közben is a 6800XT-n [link] . Én ezért használok most is 21.5.1 drivert, mert az újabbakkal nem jó az RT BFV alatt, nem mennek a tükröződések és bizonyos részek ilyen feltűnően fehérek lesznek és a ram igény is megnőtt jelentősen új driverrel. Persze, reportoltam is úgy 1-2 hónapja, de azóta nem jött új driver, vagy visszajelzés.

Ez egyébként valóban jogos negatívum, ezekre jobban kellene figyelni.

-

huskydog17

addikt

A tesztben további érdekesség is van:

"Auf einer Radeon RX 7900 XT sowie einer Radeon RX 7900 XTX gibt es in Hogwarts Legacy bei maximalen Grafikdetails Grafikfehler. Immerhin tauchen diese nicht durchweg auf, sondern „nur“ unter freiem Himmel. Dort sind dann einige Gräser ganz gerne einmal weiß, erst wenn man davor steht, werden sie grün Ob Raytracing an- oder abgeschaltet ist, hat keinerlei Einfluss auf diesen Effekt.

Es ist unklar, in wie weit die Fehler Einfluss auf die Performance haben, jedoch macht es nicht den Anschein. Die Grafikoption „Materialqualität“ ist der Schuldige. Auf „Niedrig“ tritt der Fehler nicht mehr auf."Azaz röviden tömören az AMD jelenlegi aktuális csúcstermékein az aktuálisan legnépszerűbb single player játékban grafikai hibák léphetnek (és lépnek) fel ha a játékban a Material Quality nem Low-ra van állítva.

Ezt a jelenséget egyébként már jelezték az AMD-nek a hivatalos weboldalon is. Ez azért is érdekes, mert Abu állítása szerint a profil már rég ott van a driverben, hónapok óta. Nos, úgy tűnik, hogy az AMD a saját profilját nem tesztelte elég alaposan.A gond megint ott van, hogy a legnépszerűbb játékban az AMD csúcstermékein grafikai hibák jönnek elő, miközben a konkurens termékeken nincs gond. A problémát tetézi, hogy egyrészt az érintett csúcstermékekhez már több exkluzív driver is megjelent, mégse lett javítva, másrészt az AMD a mai napig semmit nem reagált erre, így akit érint a hiba, azok a sötétben tapogatóznak, hogy vajon lesz-e javítás és ha igen mikor, merthogy az AMD annyit se mondott eddig, hogy fapapucs.

Korábban felmerült többször a téma, hogy miért olyan a piaci részesedés amilyen. Nos, az ilyen esetek is hozzátesznek ahhoz, az AMD-nek az ilyeneket el kéne kerülnie. A legtöbb felhasználót nem érdekli a technikai megvalósítás, ha egy felhasználó találkozik például a fent említett grafikai hibával a frissen vásárolt csúcsterméken, jogosan hiheti/gondolhatja azt, hogy a hardverrel van gond, főleg ha tudja hogy a többieknél akiknek mondjuk NV kártyája van, nincs gondjuk. A legtöbb érintett felhasználót nem fogja érdekelni a miért, egyszerűen valamilyen módon megszabadul az RX 7900-tól (akár visszaviszi ha két héten belül van vagy eladja) és vesz NV-t. Az ember nem azért vesz ráadásul csúcsterméket kb. 1000 euróért, hogy Low-ra kelljen állítani az egyik grafikai opciót.

Az ilyen problémás game launch-okat kéne elkerülnie az AMD-nek. Ha ez egy noname indie game lenne, akkor who cares, viszont jelenleg ez egy iszonyat népszerű játék, jelenleg a legnépszerűbb single player játék Steam-en. -

Petykemano

veterán

válasz

paprobert

#46161

üzenetére

paprobert

#46161

üzenetére

Én inkább úgy mondanám, hogy egy álló óra is naponta kétszer a pontos időt mutatja.

Ami pedig Abut illeti...

Azért nehéz kérdés - szerintem - mert nem mindig egyértelmű (talán saját maga számára sem), hogy amiket mond, amilyen álláspontot képvisel, az a szakma (grafikus szoftverfejlesztők) álláspontja, vagy az AMD mondja tollba. -

paprobert

őstag

válasz

Petykemano

#46157

üzenetére

Petykemano

#46157

üzenetére

Aki nagyot mond, az (statisztikailag) nagyot tévedhet.

Az AMD esetében pedig inkább nem valósultak meg a kívánt dolgok, mint igen, azaz jócskán 50% felett van az a szám, hogy tévedtél, ha pro-AMD jellegű jóslatokat tettél.

-

Azért lettek egymásra szabva mert ez egy Microsoft szabvány és Nvidia ehhez tervezte a hardvert. Microsoft kiadta az alapjait és a gyártókra bízta ehhez a hardverek fejlesztését.

Az hogy ez mennyi hibát és rugalmasságot tartalmaz nem tudom, biztos keveset.

Majd évek alatt csiszolódik ezt mutatják a a folyamatosan érkező fejlesztések.

Mi nem került bele? ezt nem értem..

A konzolok az az Xbox lehet maximum és azon belül is a PC + Microsoft címek, mert a Ps nem DXR alapú RT-t használ egyértelműen. Ezért kerül átdolgozásra minden konzol port Pc re kiadás elött..két dolgot árulj el nekem.

első:

Nvidiának mennyiből tartana elhagyni a fixfunkciós részegségeket ( ez kb 7- 10 % amik RT re vannak szánva) és mit nyerne /veszítene azzal ha elhagyná?

Vagy azok mellett miért ne menne rajtuk bármilyen általános RT? hisz szinte az összes RT eljárás amit beemelnek kompatibilis a többi gyártóval....vagy szerinted az Ada-n -Turingon- Amperen nem menne egy általános DXR -t támogató eljárás? Miért ne menne? A IC nincs használva RT re még AMD címeknél sem ,mert nem arra való, hogy BVH-t operáljanak vele. Raszterben erős az Nvidia is , sávszél pedig van rajtuk, a nagy L2 elméletileg ezen segít az Ada-nál.

Crytek féle SVOGI ban a Turing széjjel verte a konkurenciát, és az Ampere sem lassult le pedig itt nincs RT mag használva állítólag, kizárólag az AMD gyorsabb tőle de Nvidia nem lassabb vagy kerül az AMD mögé. Ez egy általános eljárás mindenen is fut..

A második:

Azt áruld el nekem ismét leírva már 3x hogy az Intelnél ugyan olyan jól megy a raytracing azonos raszterképességű kártyákon és RX 7000 is sokat fejlődött azokban a címekben amiknél a 6000 gyengélkedik. Hogy lehetséges ez hogy pusztán hardveres fejlesztéssel a szerinted Nvidiára szabott játékokban ennyit gyorsult az AMD és Intel gyorsabb mint az Nvidia? .

igen egymásra vannak szabva az RTX kártyáka DXR hez nem pedig a DXR az RTX hez ez látszik ,hogy pusztán pár hardveres fejlesztéssel beérhető az Nvidia, de annyi hogy AMD lemaradásban volt ezzel 1,5 generációval és most már azt vizionálod hogy hátráltatva vannak, miközben Nvidia már a 3. generációt adja ki DXR re és folyamatosan támogatja általános eljárásokkal amik mennek az összes gyártó kártyáin. . -

PuMbA

titán

Itt az lesz a kérdés megint, hogy kié lesz jobb megoldás és ha a megoldás jó, akkor ki készül el gyorsabban. Az AMD RT API-ja is még idő mire elkészül és az NVIDIA is dolgozik a témán, ahogy írtad is a Micro Mesh-sel például. Ezen kívül ugye az RTXDI-jal, ami a mostani néhány fényes limitet feldolja a DXR keretein belül és AMD-vel is kompatibilis. Ezt a Cyberpunk 2077-ben láthatjuk ez évben, tehát az NVIDIA úgy néz ki az első gyorsítást elhozza nekünk.

-

HSM

félisten

válasz

Petykemano

#46148

üzenetére

Petykemano

#46148

üzenetére

"És csak a piaci penetráció vs extra munka kérdéskörön bukhat el"

Ha okosan csinálják, szerintem nem túl nagy extra munka, hiszen kész az API, és a konzolokon is elérhető a feature. Főleg, ha később esetleg szabvány is lesz belőle, ami nem elképzelhetetlen, mert mások is látják azért a DXR jelenlegi korlátait, köztük az nv is, azért hozták a 4000-es széria fejlesztéseit a fixfunkciós blokkba [link] .#46149 Busterftw : Nem tudok róla, hogy lenne olyan játék, ami az AMD saját RT API-ját használná.

#46150 b. : A helyzet, hogy a DXR és az RTX-ek eléggé egymásra lettek szabva... Lásd DXR1.0 - Turing, DXR1.1 - Ampere. Így könnyű. Az AMD más megoldást képzelt erre el a konzolokkal és RDNA2-vel kezdődően. A nagy költői kérdés, hogy annak támogatása miért nem került bele a PC-s DXR-be, főleg, hogy a konzolok is tudják?

Egyébként már a DXR rendszer megjelenésekor többen panaszkodtak a rendszer black-box jellegére és bizonyos pontokon a programozhatóság, rugalmasság hiányára. Szintén Abu85 linkelte nemrég [link] , teljes mértékben egyetértek vele szoftverfejlesztési szemszögből.#46156 paprobert : "De hát mindhárom állítás igaz. ... A kártyákban nincs elég számítási kapacitás ... rövid távon."

Ezzel a pontoddal nem értek egyet. Jó példa erre a mostani RDNA2 és RDNA3 kártyák (Navi21, 31). Elég komoly RT-re képesek még úgy is, hogy rá vannak kényszerítve a korlátozott DXR megvalósításra.

Természetesen a fixfunkciós hardver + rá szabott, a konkurencia erősségét nem támogató API mellett nyilvánvalóan az RTX-es megvalósítás tűnik szükségesnek és jobbnak. De ne csak a chartokat nézzük, hanem a tágabb kontextust is, és máris nem lesz ez olyan magától értetődő.

-

paprobert

őstag

válasz

Petykemano

#46155

üzenetére

Petykemano

#46155

üzenetére

"az AMD megközelítése a programozhatóságról volt a helyes megközelítés

Abu majd hiába mondja, hogy 5 éve pofázom nektek, hogy a fixfunkciós hardver zsákutca

Nvidia fanok részéről, hogy azért kellett a fixfunkciós hardver a hőskorban, mert a kártyákban nem volt még akkor elég számítáci kapacitás"

De hát mindhárom állítás igaz.

A programozhatóság a helyes megközelítés... hosszú távon.

A fixfunkciós hardvernek van elméleti korlátja ... hosszú távon.

A kártyákban nincs elég számítási kapacitás ... rövid távon.Emiatt lett a FFRTU a megoldás, a mankó a jelen kor problémáira. Amelyre majd valamikor nem lesz szükség többé. De addig is Abu 2 évente kidobatja a kukába fórummal az NV gépparkot.

-

Petykemano

veterán

Nézd, én nem mélyedtem el ennyire a DXR rejtelmeiben, és hogy varázsol-e az Nvidia vagy sem.

Abu sokat szokta szidni a DXR-t. HSM most azt állítja, hogy a jelenlegi szabványon kívüli megoldásban a memóriára nézve jóval kevésbé pazarlóan lehet megoldani. Én elhiszem.

Én azt az egy részét értem az AMD hozzáállásának, hogy egy (szerintük) rossz RayTracing implementációhoz nem akarnak hardveres gyorsítót készíteni.

De....

Az eddig sosem működött, hogy az AMD hoz egy "jobb" megoldást és csak mert jobb az terjed. Pontosabban lehet, hogy a GPUk hőskorában, amikor még volt 30-40%-os piaci részesedése volt ilyen. De már a tesszeláció esetén is az történt, hogy az AMD formabontó módon betette a hardverbe, különösebben senkit nem érdekelt (úgy értve, hogy nem készült olyan szoftver, ami ezt használta volna, és hátrányba került volna emiatt az Nvidia), aztán amikor az Nvidia meghozta a saját megoldását a hardverbe, akkor meg még itt-ott kicsit meg is nyomták a használatát.

Az AMD bizonyára sokmindent el tudott intézni, ki tudott könyökölni fű alatt (Mantle), de ahhoz, hogy te hozol valamilyen újdonságot a hardveredben és az arra írt szoftverekkel előnyhöz jutsz (hátrányba kerül a versenytársad) mielőtt még a versenytársad behozná a lemaradását, piaci penetráció kell.

Ennek megfelelően nekem semmilyen illúzióm nincs afelől, hogy ha és amennyiben a későbbiekben beigazolódik, hogy az AMD megközelítése a programozhatóságról volt a helyes megközelítés, azon is, akkor is, abban is az Nvidia lesz majd a zászlóvivő. Abu majd hiába mondja, hogy 5 éve pofázom nektek, hogy a fixfunkciós hardver zsákutca, majd az lesz mondva az Nvidia fanok részéről, hogy azért kellett a fixfunkciós hardver a hőskorban, mert a kártyákban nem volt még akkor elég számítáci kapacitás. És végül ebben is az Nvidia lesz a nyerő.

-

Az RTX remix AI-t és annak maximális tudását reklámozták vele a modderek részére,de ezt már akkor is lenyilatkozták. [link]

[link] Mi másért nyúlnának hozzá egy 10 éves játékhoz amit amúgy 3.9 euroért frissíthettél ha megvolt ? Miben befolyásolná ez a konkurenciát?

Miben befolyásolná ez a konkurenciát?

igen ezek a limitek a két kártya tudás között léteznek. -

Busterftw

nagyúr

válasz

Callisto

#46151

üzenetére

Callisto

#46151

üzenetére

Okosan vagy sem, kb 10 ev buktazas utan en valtottam volna strategiat.

"Addig azonban az Nvidia az aki újíthat bármennyire is hátrányosabb a megoldásuk."

Megegyszer, szabvanyos DXR-rol van szo, kicsit erthetetlen a mondat.

Jelen helyzetben az AMD az, akinek hatranyosabb megoldasa van. -

"El kellene tudni fogadni pár dolgot azt gondolom az AMD rajongók részéről..."

Az AMD okosan akar nyerni nem erőből (ahogy Nvidia mindig is azt tette) és valóban jobb megoldásokat fejleszt és szállít az AMD. A bökkenő az, hogy sajnos nem veszik figyelembe azt a tény, hogy nagyon kevés a piaci részesedése ahhoz, hogy Radeonra fejlesszenek. Előbb be kéne állni Nvidia mögé és ha már nagyobb részesedük van újíthatnak. Addig azonban az Nvidia az aki újíthat bármennyire is hátrányosabb a megoldásuk, mert arra fognak fejleszteni.

-

válasz

Petykemano

#46146

üzenetére

Petykemano

#46146

üzenetére

Ez pontosan ugyan olyan hardveres implementáció mint a fixfunciós hardverek direkt támogatása nem érzek benne különbséget. Egyértelműen ha olyan hardverelemre optimalizálnak amivel csak az egyik gyártó rendelkezik.

Nvidia jelenleg a szabványos DXR-t gyorsítja RT magokkal, és ez látszik abból, hogy az Intel meg az ARC 770 nel egyből belépett a raszteres párja mellé ( RTX 3060) raytracingban , sőt gyorsabb is annál, bármiféle Inteles játék optimalizáció nélkül Nvidia támogatott játékokban is... [link]

Tehát nincs itt Nvidia varázslat hanem az van hogy van egy szabványos kód amit mindenki támogathat a maga módján.

Tehát abból, hogy valaki arra vár hogy az Amd milyen jó lehetne ha rá optimalizálnának és közben Nvidiát kritizálja mert ő hardveres részegységekkel gyorsítja a szabványos API-t számomra kissé érthetetlen és azt várja hogy pont AMD ne legyen szabványos hanem direkt rá legyen majd írva a DXR Raytracing... köszi...El kellene tudni fogadni pár dolgot azt gondolom az AMD rajongók részéről...

-

HSM

félisten

válasz

Petykemano

#46146

üzenetére

Petykemano

#46146

üzenetére

Architektúrálisan azért itt lehetnek szűk keresztmetszetek.

Pl. hogyan kommunikál a shader a fixfunkciós metszésvizsgálóval? Egyáltalán nem ugyanaz, ha ezek egy komplett blokk, mintha a compute shaderrel kell intenzíven együttműködni. Az már csak hab a tortán, hogy az RDNA-ban több és potenciálisabban optimálisabban kihasználható cache van.

Pl. hogyan kommunikál a shader a fixfunkciós metszésvizsgálóval? Egyáltalán nem ugyanaz, ha ezek egy komplett blokk, mintha a compute shaderrel kell intenzíven együttműködni. Az már csak hab a tortán, hogy az RDNA-ban több és potenciálisabban optimálisabban kihasználható cache van.Én erre számítok, hogy DXR lesz, és nem fog olyan jól futni, mint az AMD-specifikus kód. Nem is kifejezetten az L2 miatt. De ez mind csak találgatás az elérhető információ-motszákból.

-

Petykemano

veterán

> L2 miért nem egészen ugyanaz

Nem ugyanaz a funkciójuk, ok. Akkor azt mondod, hogy a ez a compute shaderen futó bejárás azért nem működne jól a méretében közel ugyanakkora L2$-sel rendelkező Nvidia kártyán, mint a GPU cache rendszertől némileg távolságot tartó L3 victim cache-től eltérően, mert utóbbit nem szemeteli tele.

Hát nem tudom. Nem állítom, hogy ne lehetne oylan felhasználási módot találni, amire az egyik jó, de a másik elvérzik tőle, de az eddigiek alapján eléggé kiegyenlítettnek tűnik a meccs.Lehet, hogy ez lesz az első use-case, amin az Nvidia féle L2$ elhasalna, de ha szerinted úgyis implementálják a DXR-féle utat is, akkor igazából mindegy.

-

HSM

félisten

Ezt én sem értem egyébként, miért írta. Illetve saját tapasztalatból is mondhatom, hogy ugyanaz a játék, mint a képek, nekem szó szerint bántja a szemem az élesség hiánya, nem esik jól nézni.

#46143 Busterftw: Ahhoz képest értettem, hogy a 3060 WQHD-ban pl. 9FPS Portal RTX-ben, míg a 6800XT csak 2, és hogy ez mennyire reális erőviszony egy átlagos, szép RT-jű játékban.

Mit jelent... 3060-ason ugyanabban a gépben kaptam a tesztelt erdei jelentnél FHD-n nagyjából 20FPS-t TAA-val, Quality DLSS-el és jóindulattal 30 körül. A 6800XT-n pici finomhangolással (2.5Ghz GPU, kb. 100Mhz OC kis alulfesszel) TAA FHD szalad 30-35-el, régi driverrel, újabbakkal gyorsabb ennél picivel. Viszonyításként a 6800XT WQHD-n is 25 FPS körül adott ugyanott TAA-val.

Nem pontos mérések idő hiányában, csak amolyan gyors erőfelmérésnek szántam saját szórakoztatásomra, melyiket tartsam meg, no, meg kipróbálni a DLSS2-t.

A nyerő kombináció nálam egyébként FHD lett TAA-val a 6800XT-n, fix 30FPS korláttal, így ugyanis nincs az RT miatti extra input lag és darabosság, és vajsimán fut fixen ennyivel, nyilván amennyire 30 FPS vajsima lehet.

Kicsit sajnálom, hogy így marad némi kihasználatlan hely a WQHD monitoromon, de kárpótol a gyönyörű képi világ.

Kicsit sajnálom, hogy így marad némi kihasználatlan hely a WQHD monitoromon, de kárpótol a gyönyörű képi világ.

Amúgy ez a csatorna töltött fel szuper összehasonlító videókat. 1440P-n így megy a 3080 [link] , így a 6800XT: [link] és így a 3060 [link] . Annyi lábjegyzet, hogy a 3080-on minden RT ment, a másik kettőn csak az RT-GI. Illetve én is minden RT-t bekapcsolva teszteltem. Szubjektíven ez nálam a 6800XT-nek kedvezett a 3060-al szemben videó benyomásához képest.

#46144 gV: Nem vitatom, én is szívesen kipróbáltam volna, de ~2 FPS-el nem opció.

-

gV

őstag

2080 100%-on tekerve csak ~155W-ot fogyaszt Portal RTX alatt. míg más játékokban 200+W szóval limitbe a Turing is belefut csak közben még így is játszható vele. most haragudhatnék az nV-re, mert jaj mi ez már, de inkább örülök annak, hogy a 4+ éves már megjelenésekor leírt (pl 720p [link]) uarch még mindig használható és nem kellett visszavennem semmit, csak a szokásos qDLSS-t pDLSS-re állítani. persze volt amikor csak 25fps volt (13. teszt egy pontján), de a Reflex tette a dolgát. nekem nagyszerű élmény volt ilyen pompában végigjátszani újra egy klasszikust.

és ezt az nV-nek köszönhetem.

és ezt az nV-nek köszönhetem. -

PuMbA

titán

Amúgy érdekes, hogy a Witcher 3 cikkben az van írva, hogy DLSS-sel részletesebb a kép, mint natívban:

"When using DLSS, the image was stable in motion in Quality modes, the level of detail rendered in vegetation and tree leaves is greatly improved in comparison to the in-game TAA solution, and small details in the distance, such as fishing nets or thin steel objects, are rendered more correctly and completely."

Valami nem passzol itt, mert a képeken tényleg az ellenkezője látszik.

-

HSM

félisten

"Jok az uj radeonok,az arazasuk szar."

Nekem pont az árazással van a kisebb bajom, nagyobb, hogy ismét sikerült félkész driverrel megjelenni. Így pl. azonnal kukák a multimonitor és videólejátszós magas fogyasztásos mérések, mert még folyamatban van a rendberakásuk...

#46140 Petykemano : "az Nvidia behozta a lemaradását az L2$ méretének megnövelésével"

Abu85 a találgatósban elég szépen levezette, az L2 miért nem egészen ugyanaz: [link] . Illetve jóval kisebb mérettel is rendelkeznek. A 7900-asokban L2-nek van 6MB, IC-nek 80 vagy 96MB, ehhez képest a 4090-ben 72MB L2 van, a 4080-ban már csak 64MB, a 4070Ti-ben pedig 48MB."Ez alapján nagyjából olyan erősorrendnek kéne kialakulnia kb, mint RT mód nélkül, nem?"

Szerintem nem szükségszerűen. Hiszen a Radeon felépítése optimalizálva van erre a működésre, hogy compute shaderen fut a bejárás, és fixfunkciós a metszéspont vizsgálat (ha jól emlékszem a részletekre), míg az RTX-eken vélhetőleg az optimális működés módja, ha a fixfunkciós rész van mindkét lépésre felhasználva.

A másik probléma, hogyan hajtod meg így az RTX-et? A sima DXR nem tud ilyet, azt nem tudom, van-e hasonló tudású saját API-juk."Miért gondolod, ... fognak még foglalkozni azzal is, ... DXR irányt is implementálják"

Az eladások miatt. A jelenlegi piaci arányok szerint lényegesen több RTX kártya van, mint RT-képes Radeon, így kelleni fog valami megoldás, ami azokon is működőképes. Persze, lehet opció az is, hogy RT csak Radeonon, de azt kevéssé tartom reálisnak, mint egy alternatív, pazarlóbb, de szabványos megvalósítást az egyéb termékekre. -

Petykemano

veterán

> Ami miatt hatékonyabban gyorsítótárazható is lesz egyből a BVH struktúra.

Ha csak az AMD rendelkezne nagy méretű cache-sel, akkor érteném, de az Nvidia behozta a lemaradását az L2$ méretének megnövelésével.> Mivel Nv-n egyből ugrik a kötött fixfunkciós egységek használhatósága ekkor.

Ez alapján nagyjából olyan erősorrendnek kéne kialakulnia kb, mint RT mód nélkül, nem?

> Én arra számítok, az AMD mód jól fog futni, míg az Nv-re jönni fog egy hagyományos DXR alapú módMiért gondolod, hogy egy olyan játékban, ahol megcsinálják ezt a programozhatóságot, fognak még foglalkozni azzal is, hogy az Nvidia által prefereált de hardveres erőforrásokban pazarlóbb DXR irányt is implementálják, hacsaknem jár az egyébként komoly teljesítményelőnnyel - persze megfelelő VRAM kapacitás mellett?

-

válasz

gainwardgs

#46129

üzenetére

gainwardgs

#46129

üzenetére

Soha nem tagasram ezt egyertelmuen a zold kartyakat szeretem,de latom a gondokat veluk.

Jok az uj radeonok,az arazasuk szar. -

HSM

félisten

válasz

gejala

#46134

üzenetére

gejala

#46134

üzenetére

Én a 2.4.x-eset próbáltam, ami a Witcher 3 next-gen 4.0 verzióban volt.

Sajnos abban a címben nekem nem úgy tűnik, hogy érdemben javítana a 2.5.1... [link]

A ghostinggal nem volt problémám, mással igen, itt részletesen beszámoltam róla: [link] .#46135 Busterftw : Idő hiányában nem mentem részletesen bele, melyik RT megoldás pontosan hogyan működik, de pl. a Witcher 3 teljes RT-módja nekem elég komplett/meggyőző (korrekt tükröződések, megvilágítás, árnyékok), és teljesen rendben van rajta az RDNA2 teljesítménye is, saját tapasztalat alapján körbefutja RT-vel pl. a 3060-at.

Arra célzok, mennyi létjogosultsága van így csinálni pl. egy játékban, amikor máshogy is meggyőzőnek tűnő eredményeket lehet felmutatni, ami a Radeon kártyákon is jól fut? Nem tudom, csak felvetés.

#46136 Petykemano : "a programozható eljárás abban segít, hogy ne legyen olyan nagy VRAM igénye az eljárásnak"

Ami miatt hatékonyabban gyorsítótárazható is lesz egyből a BVH struktúra."Ebből ugyanúgy profitálhat majd AMD és NVidia kártya is."

Szerintem nem. Mivel Nv-n egyből ugrik a kötött fixfunkciós egységek használhatósága ekkor. Tehát ott vagy az eredeti nagy adatstruktúrával dolgozol a fixfunkciós egységekkel és az eredeti DXR-el, vagy kellene valami alternatív API, ami máshogy használja a hardvert, feltéve, hogy ez egyáltalán lehetséges, és kéne support a játék oldaláról is mindehhez.

Én arra számítok, az AMD mód jól fog futni, míg az Nv-re jönni fog egy hagyományos DXR alapú mód, ami meg megy, ahogy bírja. Csodára nem számítok én sem, de nem tartom elképzelhetetlennek, hogy pont fordított legyen az erősorrend, mint amit megszoktunk.

-

Petykemano

veterán

> Érdekes lesz a Snowdrop2 is az AMD RT megoldásával.

Úgymond, nem lesz semmi.

Abu leírása alapján én azt szűrtem le, hogy a programozható eljárás abban segít, hogy ne legyen olyan nagy VRAM igénye az eljárásnak. Ebből ugyanúgy profitálhat majd AMD és NVidia kártya is. Elképzelhető, hogy mivel programozott, ezért az Nvidia fixfunkciós hardverei kevésbé/nem lesznek használhatók hozzá. Ez alapján talán egy hardvergyártók szempontjából kiegyensúlyozottabb RT teljesítmény jöhet ki.A "Semmi"-t tehát úgy kell értelmezni, hogy lehet, hogy szoftvertechnológia szempontjából egy hatékonyabb eljárás lesz, mint az NVidia által preferált mód, de mivel többletmunkával jár, ezért idővel ez is bekerül majd más "optimalizáció" jellegű kuriózumok sorába és mivel nem valószínű, hogy itt/emiatt az AMD átvenné az RT teljesítményben a dominanciát, ezért ez egy újabb ok lesz gúnyolódni azon, hogy "Abu technológia blablával ígérte, hogy az AMD átveszi a vezetést és nem lett belőle semmi" (miközben abu csak annyit mondott, hogy ez az eljárás hatékonyabb és az AMD emiatt ezt tartaná követendőnek)

-

Busterftw

nagyúr

-

gejala

őstag

A 2.5.1 DLSS frissítés nagyon jó lett, már nincs élesítés se benne, ghosting minimális. Hogwarts Legacyban kb semmi különbséget nem látok 1440p quality és natív között. Viszont ha kikapcsolom, jó pár beállítást lejjebb kellene venni, de így nem.

A 2.3.x meg 2.4.x branch nagyon homály volt, de most már mindent javítottak.

-

HSM

félisten

Az RX 5700-ról már évekkel ezelőtt is leírtam, hogy én RTX2060 Super-t vennék helyette, és nem egészen értem, hogy gondolták azon az áron RT nélkül [link] .

"A portal az a jaték ami arra világít rá ha ki lenne használva a hardver akkor mit tudna az Ada mennyire lehetne megterhelni."

Mi támasztja alá, hogy ez így van (a hardver képességeit mutatja be) és nem arról van szó, hogy mesterségesen limitekbe futtatják a konkurens hardvereket?

Talán még emlékszel erre: "This model may well be the most complex representation of a concrete traffic barrier ever used in any video game, movie, or any other computer graphics-related enterprise." [link]

Nem állítom, hogy ez ismétlődött meg, csupán azt szeretném felvetni, hogy a látottakból messzemenő következtetések levonása igen mély analízist kívánna meg, ami szerintem mindkettőnk témába vágó kompetenciáját messze meghaladja.#46129 gainwardgs : Érdekes lesz a Snowdrop2 is az AMD RT megoldásával.

[link]

[link] -

Busterftw

nagyúr

válasz

gainwardgs

#46129

üzenetére

gainwardgs

#46129

üzenetére

A hatalmas kulonbseg itt az, hogy az Nvidarol es megoldasaikrol nem hangzanak el evrol-evre ugyanazok a mesek es fantiaziak, csak mas kontosben.

Az Nvidia inkabb kijon valamivel aztan az elterjed es fejlodik.

Persze minden esetben jon a kontra es meg van magyarazva, hogy az miert halott otlet, bezzeg az AMD megoldasa.

Aztan a valosag meg teljesen mas. -

gainwardgs

veterán

Neked meg egy kicsit Nv felé húz a szíved, de hát nincs ezzel semmi baj.

Jók a radeonok is azért, sokkal jobb a helyzet mint anno amikor mérföldekkel le voltak maradva és nem volt semmi konkurencia.

Amúgy én meg hiszek ebben a szándékosságban mindkét gyártó részéről, egy-egy címben direkt rámegyek az architektúrám erősségeire hogy még jobban kijöjjön a különbség, de hát ez egy ilyen business

-

Jatekok alatt azért nem. És az 5700 XT mivel vív ádáz harcot?

A portal az a jaték ami arra világít rá ha ki lenne használva a hardver akkor mit tudna az Ada mennyire lehetne megterhelni.kb 9x gyorsabb elmeletileg mint a 7900 XT RT ben.Ahogy irtad is egy techdemo.De azert van benne az options fulecske, hogy menjen Turingon is lazabbra véve.

Az intel az ARC cal jol megy RT cimekben minden hokuszpok nelkul. -

Kissé elfogult vagy az AMD felé. Abu sok mindent leírt már aztán fele sem igaz.

Baromi unalmas már ez az AMD fanatik szarság amiben az gondoljátok hogy AMD mindig mindenben jobb csak a körülmények áldozata és ez miatt és az tart itt ahol tart és persze RT ben is sokkal jobb lenne csak nincs kihasználva a "programozható bejárás" amit Nvidia amúgy Nvidia meg smafu csak vannak a világban semmit nem tudnak ezekről a dolgokról, de kár hogy Abu nem szól nekik hogy lenne jó RT re hardvert tervezni, mennyivel jobb lenne neki az Nvidiánál hardvertervező mérnökként mint itt a PH-n kibic cikkírónak lenni...Atyavilág, ne már..

ugyan ez az Abu írta 3 éve hogy a DXr 1.1 [link]megváltja a világot és leváltja a szar DXr megoldást és ez már minden is sokkal jobb lesz. és az új hardverekkel idézet tőle " drámaian jobb lesz" a

A másik remek komment 2 évvel ezelöttről

[link]

és a mostani hardverek gyakorlatilag halottak ( lásd Turing kukázása ) és előröl kell kezdeni minden hardver és szoftver fejlesztést.

Abu egy elfogult ember és soha nem fogtok tőle pártatlan véleményt kapni formálja az egész PH-t és a fórumot a saját elképzeléseihez. Szomorú hogy nem láttok át ezen. -

gV

őstag

ha csak beállt volna akkor kevesebbe kerülnének mint amennyibe most kerülnek és amíg nem jöttek addig simán csak túlárazott volt a 4080, a 7900 megjelenésével viszont "jó" ára lett

majd ha jön ilyen és engem is érdekel, akkor lesz valami az amd oldalán, de amíg nincs ilyen marad az, hogy van ami 4080-al megy 7900-al nem

én viszont használom, mert amit látok tetszik.

-

HSM

félisten

"4080-nak árának sajnos pont az AMD árazása miatt van alapja."

A 4080 előbb jött ki, mint a 7900-as versenytársak... Az Nv jelölte ki az irányt árakban, az AMD 'csak' beállt a sorba.

Az Nv jelölte ki az irányt árakban, az AMD 'csak' beállt a sorba."Portal RTX-ni"

Jópofa techdemó lett. De biztos vagyok benne, hogy a Radeonok programozható bejárását kihasználva produkálni lehetne a fordítottját is, ahol az RTX-eket látnánk izzadni.

Abu85 az AMD találgatósban elég jól leírta pár napja, mi a baj ezzel a megközelítéssel, ami a Portal-t lehetővé tette: [link] [link] ."DLSS"

2023-ban tolhatod kamu dupla FPS-el, vagy homályos képpel. Próbáltam, kihagynám.

#46123 Raymond: Mi baj van a reffel? Ok, gyárilag kicsit túlhűt, ~1750rpm ~60 fokkal [link] , de szerintem a minőség is rendben van, és a méretezés is. Igényesebb, mint néhány 4070Ti... Ha meg tuning kell, vagy szélsőségesen halk működés, akkor remélhetőleg nem azon a 70-100€-n fog múlni, hogy vegyen az ember egy TUF-ot vagy Nitro-t [link] .

-

Yutani

nagyúr

válasz

Petykemano

#46118

üzenetére

Petykemano

#46118

üzenetére

Szép új világ. Tulajdonképpen bármilyen is a szituáció, árat kell emelni. Ha túl nagy a demand, azért, ha túl kicsi, akkor meg azért. Gyalázat.

-

HSM

félisten

Én inkább venném a 7900XT-t, mint pl. használt 3090-et nem sokkal alacsonyabb összegért. Kicsit lehetne olcsóbb, de a mostani kínálatban én egész jó ajánlatnak találom. Ellenben a 12GB-al elrondított 4070Ti-al vagy a tudásához képest egekbe árazott 4080-al...

Nyilván nem lesz olyan erős ár/teljesítményben, mint a készletkisöprős áron adott elődje, de legalább egy komplett csomagot kapsz a mostanság divatos árazáshoz képest egész vállalható összegért. -

Petykemano

veterán

Ezek is elmehetnek... [link]

-

HSM

félisten

válasz

Raymond

#46116

üzenetére

Raymond

#46116

üzenetére

Szerintem egész jó vétel 900€ körül a 7900XT is, illetve az előző generáció is, ha még valaki kifogott akciósan 650€-ért 6800XT-t és annyira nem kell neki durva RT tempó.

A 6700XT-el az lehet a baj, hogy RT-hez már eléggé el tud fogyni jópár címben, a 6800XT-vel viszont az is opció.

4070Ti nagyon szépen néz ki papíron, de ennyi pénzért szvsz ne legyen már ennyire kicentizve egy kártya VRAM-ja 900€-ért...

-

Raymond

titán

válasz

keIdor

#46115

üzenetére

keIdor

#46115

üzenetére

Az uj kartyak az AMD-nel is vadul vannak arazva, de ott legalabb van ertelmes termek ertelmes aron az also kategoriaban:

269EUR - RX6600 8GB [link]

329EUR - RX6650XT 8GB [link]

369EUR - RX6700 10GB [link]

399EUR - RX6700XT 12GB [link]

469EUR - RX5750XT 12GB [link]Az RX6750XT tul draga 469EUR- ert az eppen kemenyen kiarusitott 6700XT-hez kepest ami szerintem 399-ert best buy per pillanat. NV-nel ott csak a 349EUR-os 3060 12GB -van ami azert nem ugyanaz a teljesitmeny kategoria. Utanna meg mar csak 539 es 649 aron vanak a 8GB-os 3070 es 3070Ti kartyak ami egy rohen 2023-ban. a 649-rol meg csak a 899-es 4070Ti-re lehet ugrani mert gondolom epeszu ember nem vesz 799-849 kozott 3080 10GB-ot.

-

Raymond

titán

-

amargo

addikt

Sziasztok,

Melyik CPU-t érdemes választani, virtualizáció -hoz + ha lesz mellette stream transcoding is több csatornán.

AMD 5825U vagy Intel 1265U? [link]Az AMD erősebb viszont az intelnek is ott vannak a maga előnyei. Ezért kicsit nehéz.

Köszönöm a segítséget előre is.

-

gV

őstag

most nézem, kicsit kibővítette és javította (A770) a méréseket illetve megnézte a patch után is:

Update Feb 10: The game is now released for everyone and there's a new patch. I've tested the patch on RTX 4090 and RX 7900 XTX, with RT on and off, there's no change in performance. The DLSS 3 menu bug is also not fixed. [link]

Don't believe any benchmarks that are run inside the castle. Here there isn't much to see and your view distance is low. We've done our benchmark runs in the open world areas and FPS are much lower here. I picked a test scene that's demanding, but not worst case.

[link] -

HSM

félisten

"írta aztán HU, mielőtt elkezdődne a zöld gyíkemberek üldözése"

Olvastam. Illetve be is linkeltem időbélyeggel a videót az említett részen, ahol el is mondja részletesen... Nem a gyíkemberek, hanem az esetleges irreállisan magas FPS-es beszámolók kiszűrése végett említettem.

Nem a gyíkemberek, hanem az esetleges irreállisan magas FPS-es beszámolók kiszűrése végett említettem. -

Amúgy a hiba, a keretgenerálás bekapcsolódása a játék menüjének a hibája volt,írta aztán HU, mielőtt elkezdődne a zöld gyíkemberek üldözése.[link]

CB szerintem megint a legjobb tesztet hozza le. Fordítóval németből :[link]

"

A Roxfort Legacy sok grafikus kártya memóriát igényel a textúra maximális részletezéséhez. Pontosabban, ez az első olyan játék a szerkesztőség tesztjében, amely csak 16 GB VRAM-tól működik minden helyzetben probléma nélkül. Még 12 GB esetén is el kell fogadnia a korlátozásokat. Pl. a GeForce RTX 4070 Ti-nek nincs teljesítményproblémája Ultra HD és DLSS minőségben egyébként teljes grafikai minőség mellett, de egyes objektumoknál nem töltődnek be a textúrák, mások rövid időre teljesen eltűnnek, mivel valószínűleg próbálkozik a motor. hogy valahogy megmentsék a helyzetet. Sugárkövetés nélkül 12 GB-tal is működik. 10 GB már sugárkövetés nélkül sem elég DLSS-sel, megfelelő képkockasebesség mellett. Ha a grafikus kártya csak 8 GB-os, WQHD-n, beleértve a DLSS-t is, már sugárkövetés nélkül is láthatóak a kopás jelei, és még Full HD-ben is hiányzik egyik-másik textúra játék közben. Végül a 8 GB és a maximális textúrák nem lehetségesek."

Plusz azt írják több helyen, a játék valamiért egyes CPU kat nem szeret és ütemezési gondokkal küzd, extra módon megterheli az első 4 magot. -

HSM

félisten

válasz

Yutani

#46100

üzenetére

Yutani

#46100

üzenetére

A Hardware Unboxed-ék is mást mértek, ott sem vészes a Radeonok teljesítménye.

Az egyik teszt helyszínen a 3080 elég csúnyán padlót is fogott az elfogyó 10GB VRAM-ja okán... [link]

Az egyik teszt helyszínen a 3080 elég csúnyán padlót is fogott az elfogyó 10GB VRAM-ja okán... [link]

A 8GB-os modellek (3070, 3070Ti, 3060Ti) elég nagy bajban voltak már 1080P-n is. Külön érdekes, hogy a 8GB-os 6650XT jobban bírta a strapát.Az is rendkívül érdekes, hogy a végén mesél arról, hogy a 4000-es RTX-eken magától bekapcsolódott a "Frame Generation" (DLSS3), mégpedig úgy, hogy kiszürkítve maradt a menüben [link] !

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Samsung Galaxy A55 - új év, régi stratégia

- Luck Dragon: Asszociációs játék. :)

- AliExpress tapasztalatok

- PlayStation 5

- iPhone topik

- Renault, Dacia topik

- Milyen autót vegyek?

- Samsung Galaxy S26 - szeret, nem szeret

- Témázgatunk, témázgatunk!? ... avagy mutasd az Android homescreened!

- Napelem

- További aktív témák...

- Gigabyte GT 1030 2GB

- ASUS ROG STRIX GeForce RTX 4090 WHITE OC EDITION 24GB - Alza garancia 2027.03.19 - BESZÁMÍTOK!

- ASUS ROG Strix RTX 3080 10G OC Gaming White (fehér)

- ASUS TUF Gaming GeForce RTX 5080 OC Edition 16GB - Garancia 2029.03 - Felbontott - BESZÁMÍTOK!

- A LEGENDA! ASUS ROG STRIX GTX 1080 Ti 11GB GDDR5X 352bit - Brutális erő, makulátlan hűtés!

- Lenovo Idea Tab 128GB, Kártyafüggetlen, 1 Év Garanciával

- Lenovo X390 i5 8265U, 8GB RAM, 256-512GB SSD, jó akku, számla, 6 hó gar

- GYÖNYÖRŰ iPhone 14 128GB Midnight -1 ÉV GARANCIA - Kártyafüggetlen, MS3971, 94% Akkumulátor

- Samsung Galaxy Watch5 LTE 40mm, Kártyafüggetlen, 1 Év Garanciával

- Lenovo LEGION 5 PRO Ultra 9 275HX 32GB RAM 1TB SSD RTX 5070 Ti 12GB 16" QHD+ OLED 3év Prémium GAR

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Ha legörgetsz, akkor ott van pont egy Unreal Engine-es példa is a Hellblade: Senua's Sacrifice személyében.

Ha legörgetsz, akkor ott van pont egy Unreal Engine-es példa is a Hellblade: Senua's Sacrifice személyében.

Miben befolyásolná ez a konkurenciát?

Miben befolyásolná ez a konkurenciát?