A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Gyorskeresés

Legfrissebb anyagok

- Bemutató Spyra: akkus, nagynyomású, automata vízipuska

- Bemutató Route 66 Chicagotól Los Angelesig 2. rész

- Helyszíni riport Alfa Giulia Q-val a Balaton Park Circiut-en

- Bemutató A használt VGA piac kincsei - Július I

- Bemutató Bakancslista: Route 66 Chicagotól Los Angelesig

Általános témák

LOGOUT.hu témák

- [Re:] [Luck Dragon:] Asszociációs játék. :)

- [Re:] [D1Rect:] Nagy "hülyétkapokazapróktól" topik

- [Re:] [antikomcsi:] Való Világ: A piszkos 12 - VV12 - Való Világ 12

- [Re:] Elektromos rásegítésű kerékpárok

- [Re:] [gban:] Ingyen kellene, de tegnapra

- [Re:] [sziku69:] Szólánc.

- [Re:] [Kolondrum:] Éves rezsi

- [Re:] [plevips:] Építkezünk 3. rész (2024)

- [Re:] [Tüzi:] Geek-hatarozo

- [Re:] PLEX: multimédia az egész lakásban

Szakmai témák

PROHARDVER! témák

Mobilarena témák

IT café témák

Téma összefoglaló

Hozzászólások

Petykemano

veterán

Ez beszédesebb mint amiket Te linkeltél: [link]

És látszik is, hogy a 3070 teljesítménye alacsony felbontáson és alacsony minőségben sokkal inkább függ attól, hogy milyen procit raksz alá, mint pl a 5600XT vagy 5700XT esetén.

Tehát ne érts félre, a driver overhead tényleg létezik, csak azzal kötözködök, hogy ebből milyen ÁLTALÁNOS megfogalmazásokat (marketing szövegeket) vonsz le.

A valóság az, hogy ha az általánosan elfogadott feltételek mellett (tehát az elérhető legjobb procival) mérsz (Megjegyzés: a jelenségnek vajmi kevés köze van a magszámhoz, tehát nem attól pörög jól a review-kban az nvidia kártya, hogy brutáldrága 5950X-et raknak alá. Ugyanúgy érvényes ez az 5600X-re.), akkor nem, vagy alig fogsz észrevenni bármit is ebből a driver overhead-ből.

Az általad - általános sebességkülönbség színben feltüntetett - 20-30%-os különbséget csak akkor tapasztalhatod, ha

- gyenge minőségben (1080p medium)

és

- valami topa cpu-val mérsz

Én a helyedben ezeket az apróságokat a helyedben kiemeltebben kezelném, mert pont az ilyen csúsztatások miatt szoktak kapni cégek és újságok egyaránt.

Találgatunk, aztán majd úgyis kiderül..

Abu85

HÁZIGAZDA

Sajnos elég sokat fogsz még úgy is belőle észrevenni. A medium részletesség csak segít a kimutatásban, de ez már max részlegességen is érződik. Láthatod a TPU tesztben, hogy ott a 3080 még 4,8 GHz-re húzott Zen 3-mal is CPU-limites pár játékban 1080p-ben, néhol 1440p-ben is.

Max részletességre értettem. Egyszerűen a Valhallában a Zen 2-Zen 3-ra váltás ennyit ért egy top GeForce-on, 1080p-ben. Ez már nem csak a medium részletességet érinti, ha csak azt érintené, akkor lehetett volna használni a Valhallát Zen 2-vel is, de egymás mögött sorakoztak a GeForce-ok 1080p maxon, miközben a Radeonok szépen skálázódtak.

Ott van a TPU mérésekben 1080p-ben a CPU-limit a GeForce 3080-on, és bivaly tuningolt procival, elég ha megnézed.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Hellwhatever

aktív tag

Szerintem ez inkább a Zen 2 -> "normális" procira váltás eredménye. Kíváncsi lennék ha valami (ne adj isten OC-s) i9-re váltotok akkor mik a számok. (Gyanítom hogy hasonló ugrást látnánk.)

A Zen 2 játékok alatt sok esetben mérhetően lassabb volt a konkurenciához képest, az AMD csak a Zen 3-mal tudott egyértelműen fordítani.

Volt 3800X-em és még az is (asszem 3700X-etek volt javítsatok ki ha tévedek) határozottan lassabbnak érződött már Windows alatt is mint az elődje a 4.8-ra húzott 9600K.

Szvsz egyik Zen 2 se való top VGA mellé (tesztelésre meg főleg), de ez csak az én véleményem.

Abu85

HÁZIGAZDA

Mint ugye többször írtam, és nem győzöm hangsúlyozni, hogy a Radeon esetében ez a javulás nem figyelhető meg. Egyszerűen azok skálázódnak Zen 2-vel és Zen 3-mal is. A Radeon 6800 XT esetében a Zen 3-ra váltás előnye csak 3-4%. A GeForce driver mellett eredményez a játék akkora többletterhelést, hogy valamiért nem tud jól működni a játék a régebbi, kevésbé tempós procikkal.

És a probléma még mindig jelen van 1080p-ben a GeForce-on, hiába a Zen 3, a Radeon most is jobban skálázódik, de már nem extrém a különbség.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

paprobert

senior tag

DX11-ben konstans NV előny volt.: "-Az átlag konzumer úgysem 1080p-ben játszik, tehát mindegy, és sosem jönne ki a különbség, csak VR-ban." "-Válts 1440p-re vagy 4K-ra, és akkor egy FX is elég lesz, az AMD driver overhead-del ne foglalkozz."

DX12-ben masszív AMD előny van.: - Azonnal fontos a 1080p high refresh gaming.

Én is érzékelem a fordulatot.  Bár annyiban igazat lehet adni, hogyha a konzolban található Zen2@3.5GHz lesz a 30fps-re elég CPU erő, akkor az NV driver 15-30%-os overhead-je tud számítani középtávon bármilyen felbontáson.

Bár annyiban igazat lehet adni, hogyha a konzolban található Zen2@3.5GHz lesz a 30fps-re elég CPU erő, akkor az NV driver 15-30%-os overhead-je tud számítani középtávon bármilyen felbontáson.

Még nem láttunk CPU-gyilkos next-gen játékot, de már nem lehetnek túl messze.

[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

Busterftw

veterán

"Azonnal fontos a 1080p high refresh gaming"

Epp nem, mert ugye epp azt mondja Abu, hogy alacsonyabb felbontason van gond.

Mondjuk en 11700-11900k CPU-kal egyertelmuen tobb FPS-t latok 3080-3090-nel, mint az ennel nincs gyorsabb Zen2-3 procikkal.

Hellwhatever

aktív tag

Szigorúan elméleti síkon maradva és nem trollkodva megfordítva a dolgot az nem lehet hogy az AMD drivere a problémás mert az nem skálázódik rendesen?

"hónapok óta követni azt a fika hadjáratot , amit az AMD ellen folytatsz."

Mutatnál példát a hónapokból a fika hadjáratra AMD ellen? Véleményt olvastál, nem AMD re vonatkoztatva. Abu= AMD ? oh wait..Sejtem kinek az alteregója vagy.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

GeryFlash

veterán

b. bevallottan Nvidia szimpatizáns, drukkol nekik és örül a sikereiknek, de az AMD-vel rendre objektív csak krvára idegesíti a kettős mérce (csak 1 példa az ezer közül: VEGA korszakban az 1440p volt a fontos, 4 évvel később az hogy mennyivel gyorsabb kikapcsolt RT-vel 1080p mediumon a 6600XT a 3060TI-nál). Abu ezzel szemben nem bevallottan AMD szimpatizáns, de valahogy mindig úgy csűri-csavarja... Komolyan ez hogy hetekig sejtelmesen fel lett szopva a 6600XT, aztán kiderül hogy egy 3060TI-nál 7%kal gyorsabb VGA viszont RT-ben szintekkel rosszabb és kevesebb VRAM mindezt drágábban

Kiadták az 5700XT-t RT támogatással kisebb fogyasztással 400 dollárért. Ez volt a világmegváltó cucc. Ehhez képest a 3060/3060TI/6700XT kiemelkedően jó ár/érték arány.

De héh, 128 biten hozza az 5 éves 1080TI-t 1080p-n 🤡

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

Hellwhatever

aktív tag

Utána számolok már hogy a 128 bites GTX 1650 mennyivel alázza a 4096 bites Radeon Fury-t ....

Computer4U

kezdő

Sziasztok!

Egy olyan kérdésem lenne, hogy ha játék alatt afterburnerrel szeretném kiiratni az infókat rivatunerren keresztül miért van az, hogy csak kb 5 féle adat látszik.

Szeretném látni az 1% és 0,1% fps stb, de semmi. Hiába pipálom be, hogy monitorozza és írja ki OSD-n.

Köszi

Jack@l

veterán

A legelső hsz-ben le van irva.

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

Abu85

HÁZIGAZDA

Ha nem skálázódna, akkor sorakoznának egymás mögött azok a kártyák, amelyek teljesítménykülönbsége amúgy kétszeres. Ez az AMD-nél nem következik be, csak az NV-nél lassabb procival.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Petykemano

veterán

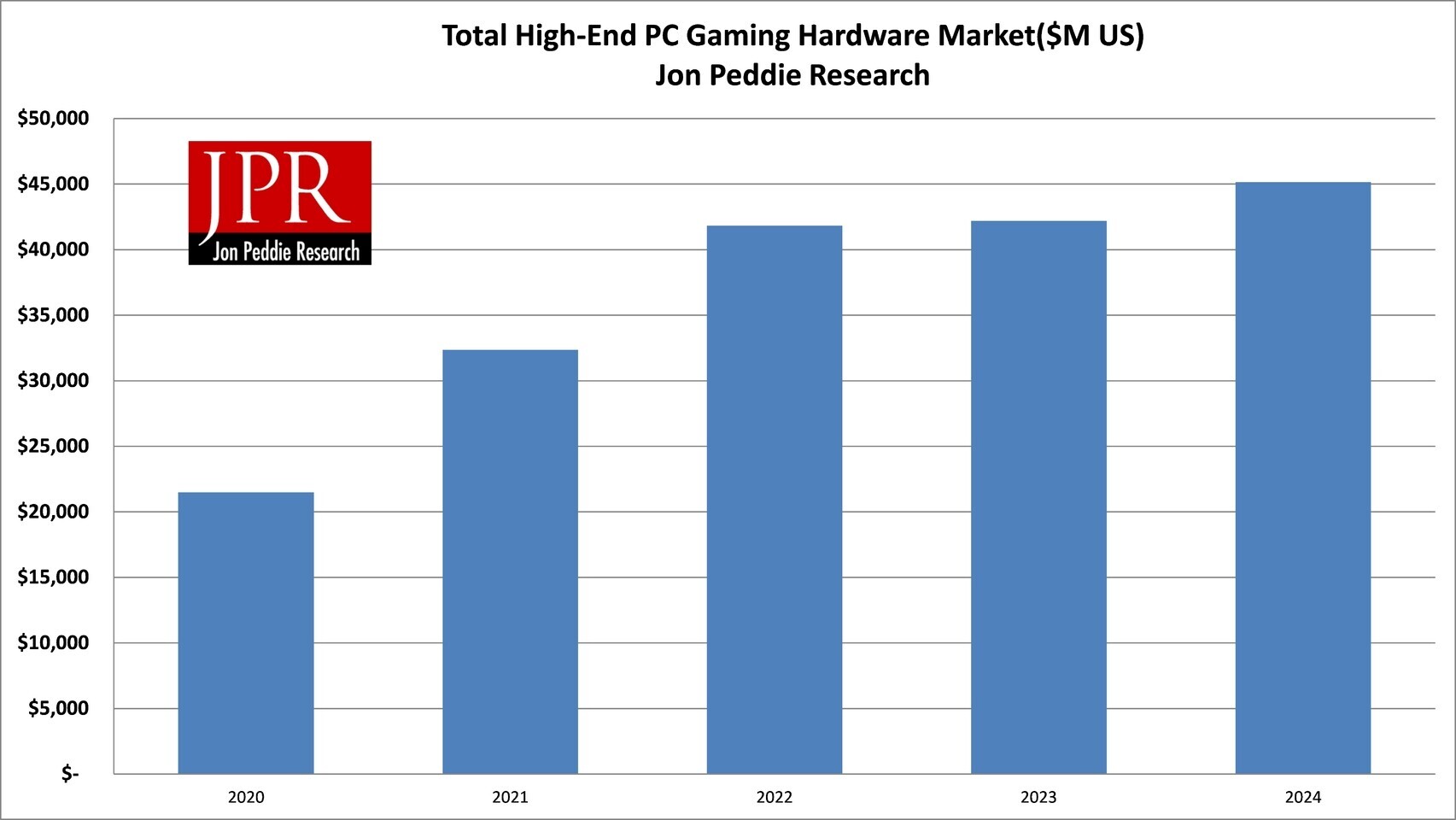

"Szűkül a piac, egyre kevesebben vásárolnak játékra PC-t, mainstreamből geekség lett."

Eközben:

[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

Busterftw

veterán

Ez mondjuk latszik, mert hiaba novekszik, nem novekszik olyan utemben mint pl 2020-2021-ben.

Petykemano

veterán

Nem ment át, amit mondani akartam.

Arról volt szó az elmúlt 4-5 évben, hogy szűkül a piac, a GPU piac az nagyon kicsi.

És mivel kicsi, ezért mindenki mostohája és mivel kis volumen, ezért drágul is.

(Ebből már bullshit generátort lehetne készíteni)

Az eközben meg arra vonatkozik, hogy épp most nő kétszeresére a TAM.

jójójó, persze ezt 2018-ban senki nem láthatta előre, tehát akkor lehet, hogy tényleg szűkült.

És hát ugye az is igaz, hogy ez nem volumen, hanem összeg, amibe nyilván beleszámít, hogy a $400 az új $250. A volumen meg lehet, hogy továbbra is picit csökkenőben van.

Találgatunk, aztán majd úgyis kiderül..

Az mindenesetre szépen látszik, hogy az AMD-nek is megéri lehajolnia ezért a 2021-re 30+ mrd USD-osra becsült piacért.

solfilo

Televan74

nagyúr

Azért hajol le hogy felvegye, vagy azért hogy le..opjon.? Esetleg tegyem be neki hátulról? ![;]](http://cdn.rios.hu/dl/s/v1.gif)

De a témánál maradva. Feltételezzük hogy kb. 80 millió új felhasználó vett gépet a covidnak köszönhetően. És ők nem a csóresz gamer tábort alkotják. Velük hamar meglehet a kívánt bevétel, sőt ha egy kicsit normalizálódnak az árak, azok is vesznek akik eddig kivártak.

Amikor nincs remény! Jusson eszedbe nincs isten, csak én!

olymind1

senior tag

Mondjuk nem csoda, ha mindent egyre drágábban adnak, akkor kevesebbet is vesznek belőle, mert szűkül a réteg is aki megveszi, vagy aki hajlandó annyi pénzt kiadni érte. De az is biztos hogy magyar piacra terveznek ezek a cégek.

Játékfejlesztőknek egyébként előbb-utóbb nem fog feltűnni, hogy kevesebbet vesznek a játékaikból, mert nem tudják futtatni őket?

GeryFlash

veterán

Nem mert a játékokat konzolon adják el ami folyamatosan egyre nagyobb ütemben nő, a PC-s port meg az azonos architektúra miatt fillérekből megvan, megéri azért lehajolni.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

Jack@l

veterán

https://www.techpowerup.com/284585/amd-fidelityfx-source-code-released-updates-posted-uses-lanzcos-under-the-hood

Sima (butitott) upscaler + sharpening

[ Szerkesztve ]

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

beef

őstag

Mire számítottál?

Nem tök mindegy, hogy mi, ha elvégzi a feladatát?

Jack@l

veterán

Őszintén egy hajszállal többre, mikor ilyen cikkek jelentek meg róla év elején:

"FidelityFX Super Resolution is one of the biggest AMD’s software initiatives"

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

Abu85

HÁZIGAZDA

Mert jóval több is. A Lanczos évtizedek óta a legjobb megoldás skálázásra, nem véletlen, hogy a MadVR is arra épít, de rengeteg olyan operációt alkalmaz, amelyben a GPU-k veszettül lassúak. Az AMD implementációja pont ezen módosít jelentősen, illetve az egész algoritmus problémáit kicseréli olyan eljárásokra, amelyek nem okoznak képi hibákat.

És figyeld meg, hogy mennyien be fogják építeni. Pont az a lényege, hogy semmiféle overengineering nincs benne. Egyszerű megoldás egy egyszerű problémára, ami akármilyen futószalagon belül működik, ráadásul 14 évre visszamenőleg fut a hardvereken.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Jack@l

veterán

Amd csak butított az amúgy középkategóriás algoritmuson, hogy ne kelljen odaadnia érte a gpu jópár %-át... Semmivel nem lesz tőle jobb, inkább rosszabb, mint az eredeti.

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

Petykemano

veterán

(Xilinx) FPGA-val, vagy más dedikált ASIC akár integrált, akár chipletes összeragasztáss tehető az FSR futása

- gyorsabbá?

És/vagy

- jobb minőségűvé?

Korábban ez a gondolat felmerült a pletykákban, de ha jól értem, a jelenlegi algoritmus a lehető leggyorsabbra van átalakítva, így gondolom a skálázás footprintje nagyon elhanyagolható. A minőséget illetve a gyorsulást pedig döntően az befolyásolja, hogy mekkora a forrás és cél felbontás közötti különbség.

Tehát a kérdés az, hogy egy esetleges FSR2 esetén - új, bonyolultabb, de valamilyen dedikált hardverelemmel gyorsított algoritmussal, javulhat-e az eredménye?

Találgatunk, aztán majd úgyis kiderül..

FLATRONW

őstag

Az NGU Lanczos alapokra épít?

Abu85

HÁZIGAZDA

A probléma az eredeti algoritmussal az volt, hogy nem mindig végez elég jó munkát, illetve nem is gyors.

A "nem is gyorsra" az volt a válasz, hogy megkeresték azokat a részeit az számításoknak, amelyek marhára lassan futnának egy GPU-n. Ilyenek a különböző szögfüggvénye, a négyzetgyök, stb. Ezek azért futnak lassan, mert a fő ALU-kban, nincs rá utasítás egyik GPU-ban sem. Helyettük a multiprocesszorok tartalmaznak pár SFU-t, amelyek el tudják végezni a feladatokat, de úgy 32-, 256- rosszabb esetben 512-szer lassabban. Ez ugye elég nagy szopás ahhoz, hogy valós időben az alapalgoritmus ne legyen alkalmazható. Egyrészt az SFU-k száma nem sok egy teljes GPU-n belül, másrészt az egyes speciális operációk is 8-16 órajel alatt valósulnak meg.

Ezt a problémát kezeli a kódban egy 0x5F3759DF WTF-szerű ötlet, amely a lassan futó operációkat kicseréli alapműveletekre, amelyek több nagyságrenddel gyorsabban futnak, és ezért csak kevés pontosságot áldozol. Emiatt az alapalgoritmus teljesítménye az egyes GPU-kon akár a százezerszeresére is tud nőni, vagyis eljutottál ahhoz a tartományhoz, hogy valós időben alkalmazható legyen.

A másik probléma a "nem elég jó munka". Ehhez az alapalgoritmusnak külön kezelték a képi hibákat adó részeit. Ezeket kompletten átírták, illetve a képi hibák lehetőségét mellőzni lehessen. Ugye ennek is az volt a kulcsa, hogy az alapalgoritmust átlagosan a sok tízezerszeresére gyorsították egy GPU-n, tehát most már van miből költeni a jobb minőségre. Ebből jön az élek rekonstrukciója, ami az eljárás alapja.

A további modulnak számító RCAS már csak egy adalék, ami extra helyreállítási munkát végez.

#55835 Petykemano : A Xilinxet nem ezért veszi meg az AMD.

A FidelityFX Super Resolution eleve egy rohadt gyors eljárás. Amellett, hogy ez adja az ismert eljárások közül a legjobb rekonstrukciós minőséget, még ez is fut a leggyorsabban a GPU-kon. Tehető ennél gyorsabbá is, de egy középkategóriás VGA-n sem számol 1 ms-nél tovább, ha azt leviszed 0,9-re, ami egyébként még talán realitás is, akkor sem nyersz vele sok sebességet, mert a képszámítási teljes idejének a töredékrészén optimalizáltál 10%-ot, vagyis a teljes képszámítás időigényén ez jó ha 1%-ot dob.

Jobb minőség sem várható, mert eleve képes arra az algoritmus, hogy a natívval nagyon megegyező minőséget csináljon. Elméletben a natív minőség a referencia. Papíron ennél jobbat nem lehet csinálni. Az más kérdés, hogy a FidelityFX Super Resolution esetében is van olyan, hogy az UQ beállítás szebbnek tűnik, de ugye papíron ez nem lehet szebb, csak szubjektív benyomás szintjén.

Az alacsonyabb felbontásról való rekonstrukción lehet javítani. De ez egy balansz kérdés. Minél alacsonyabb felbontásról skálázol fel valamit, annál nagyobb számítási teljesítmény kell magához a skálázáshoz, hogy jó eredményt érj el. Az AMD nem véletlenül ajánl előre skálázási paramétereket. Azok ugyanis a sweet spotok.

A másik dolog, hogy az AMD régóta tart FidelityFX-es preziket, és sokszor elmondták már, hogy az elmúlt évtizedben arra jöttek rá, hogy sokszor a legegyszerűbb megoldások a legjobb válaszok egy problémára. Semmiféle overengineeringet nem szabad felvállalni. A FidelityFX fejlesztése úgy működik, hogy feltárnak egy problémát, arra átbeszélnek pár megoldást, és abból mindig a legegyszerűbbet választják, mert az esetek 99,99%-ában az a legcélszerűbb. Amikor egy algoritmust bonyolítasz, akkor előjönnek vele a problémák, nehezebben kezelhető lesz, több limitációt kell figyelembe venni, arra nem is biztos, hogy mindegyik fejlesztő hajlandó. Magát a FidelityFX CAS-t is az egyszerűsége adta el. Ugyanezt az elvet követi az FSR is.

#55836 FLATRONW : Mire gondolsz NGU alatt? Hirtelen nem tudom dekódolni.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

FLATRONW

őstag

[link] - Itt található összehasonlítás is.

Abu85

HÁZIGAZDA

Ja a madVR-ben... Nem az NGU az más algoritmus, csak az proprietary, míg a Lanczos nem az.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Petykemano

veterán

Akkor tehát a válasz az, hogy az FSR-re nem várható és nem is elképzelhető dedikált hardveres gyorsítás.

Tehát nincs olyan masterplan, hogy az AMD elterjeszti az egyszerű, bármin futó FSR-t, amihez aztán beépít a saját hardverébe valamilyen olyan elemet, ami aztán lényegesen gyorsít, vagy javít a minőségen és már nem lesz érdemes a konkurenciát vásárolni.

Mondjuk az is igaz, hogy ha az algoritmus open-source, akkor talán bárki más is készíthetne hozzá dedikált hardverelemet. Nem?

Találgatunk, aztán majd úgyis kiderül..

Busterftw

veterán

Megforditva, elofordulhat az, hogy Nvidia tensor core-okon gyorsabban fusson, ha az Nvidia arra optimalizal?

(#55842) Alogonomus válasza Petykemano (#55840) üzenetére

Alogonomus

őstag

Több helyen olvastam olyan fejtegetést, hogy az Infinity Cache az óriási adatátviteli sebességének és elhanyagolható késleltetésének, meg a kisebb felbontásból származó nagyobb találati aránynak köszönhetően bizonyos szempontból már tekinthető az FSR "hardveres gyorsítójának" is.

Petykemano

veterán

Én is azt feltételeztem, hogy az FSR footprintje nagyon minimális és ezt végülis Abu megerősítette azzal, hogy azt mondta, hogy 1ms.

Ha ez igaz, akkor - a jelenlegi algoritmuson - nincs igazán mit gyorsítani.

Az én kérdésem az, hogy vajon lehet-e úgy bonyolítani az algoritmust, hogy jobb minőséget adjon, cserébe erőforrás-igényesebb legyen, amit viszont már érdemes dedikált hardverelemmel gyorsítani.

Abu szavaiból azt veszem, ki, hogy nem.

De persze Abuból általában az AMD marketing osztály beszél és ha lenne ilyen nem publikus tervük, akkor azt Abu sem mondaná.

Ha lehetséges az algoritmust így módosítani, akkor végülis az Nvidia beküldhet olyan PR-t, ami opcionális és tensor által gyorsított. Nem mondom, hogy lehetséges, de az út az Nvidia előtt nyitva van.

Találgatunk, aztán majd úgyis kiderül..

Abu85

HÁZIGAZDA

Ez a kód eléggé ALU-intenzívre van szabva, szóban akkor fog gyorsabban futni, ha több ALU kerül a hardverbe. De dedikált maggal nem.

A dedikált magnak mindig az a gondja, hogy sok követelmény van a kód felé, és ez behatárolja a fejleszthetőséget. Ez látható a DLSS-nél. Az kezdetben a tensor magokon működött, majd az 1.9-cel lekerült róla, ekkor jött egy nagy minőségbeli ugrás. Majd a 2.0-2.1-gyel részben visszakerült, de a 2.2-vel megint lekerültek feladatok a tensorról. Egyszerűen maga a tensor mag egyáltalán nem hatékony abban a feladatban, amit a DLSS mostani verziója csinál, így jobb lesz az eljárás, ha a munka jó részét nem is a tensor csinálja meg.

És innen trükkös a helyzet, mert építesz a hardverbe egy rakás olyan feldolgozót, amire próbálsz valamilyen munkát rakni, de közben rossz lesz a hatékonyság. A DLSS-nél ez úgy működne jól, ha a tensor magoknak lenne dedikált regiszterterületük, de akkor meg a lapka fele a tensor lenne, amit használhatsz 100-akárhány játékkal, a többi cím alatt pedig minden drámaian lelassul, mert az ALU-nak szánt tranyókat elvitte a tensor regiszterterülete.

Értem, hogy sokan hisznek ebben a gyorsítás dologban, de ez a valóságban elég nagy kockázat. A DLSS-en borzasztóan látszik, hogy mennyire nem jól működik, a kezdeti kód óta folyamatosan kerül át a normál ALU-kra a feldolgozás, mert hiába jó papíron a tensor valamire, ha nem olyan dologra használod, amire le van tervezve a hardver. Ha pedig úgy használod, akkor meg szar lesz a minőség, lásd DLSS 1.0. Pont ugyanez lenne a baja egy FSR-nek is, ha elkezdenél dedikált hardvert építeni rá, és még a fejleszthetőséget is behatárolja.

Olyan lehet, hogy a feladat egy kis részét gyorsítod egy külön hardverrel, de eleve egy olyan eljárás az FSR, ami egy elég gyönge GPU-n is 1 ms alatt megvan. Most ha annak egy részfeladatát felgyorsítod, akkor meglesz egy hasonló képességű modern GPU-n az eljárás 0,8 ms-ból, és akkor megveregetheted a vállad, mert az kb. 1-2 fps plusz a végleges képkockára. Cserébe ellőttél egy csomó pénzt a hardverre, a hozzáigazított szoftverre, és a tranyók egy része az FSR-t nem támogató játékokban nem is aktív. Badarság ilyet csinálni jelenleg.

#55841 Busterftw : A tensor már a DLSS új verzióival is nagyon rossza hatékonyságú, felesleges az NV-nek az FSR átalakításába pénzt ölnie, mert a dedikált hardverek használatától csak lassulnának.

#55842 Alogonomus : Annyira nem memóriaintenzív ez az eljárás, hogy az IF nagymértékben számítson. Valamennyit mindenképpen számít, de ez még +1 fps-t sem ad ki.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Petykemano

veterán

köszi.

Csak két megjegyzés:

"Értem, hogy sokan hisznek ebben a gyorsítás dologban, de ez a valóságban elég nagy kockázat."

Ennek valószínűleg az lehet az oka, hogy több - talán főképp mobilos, elsősorban Apple - példán keresztül úgy tűnik, hogy jelenleg az a nyerő irány, hogy a SoC-odba több különböző dedikált fixfunkciós hardverelemet építesz.

Persze értem én, hogy az Apple azért más tészta, mert ott a szoftver is az ő irányításuk alatt áll. A fixfunkciós dedikált egység és az általános programozhatóság megközelítése nyilván mindig küzdeni fog egymással.

Nagyjából ez a megközelítés látszik az nvidiánál is az RT, tensor és hagyományos magok megkülönböztetésével. És legalábbis eddig ez nyerőnek tűnt. Számok alapján mindenképpen, hiszen az AMD CDNA-ja még mindig nem közelíti meg azokat a számokat, amit a tensor magos nvidia gpu-k tudnak.

"A DLSS-en borzasztóan látszik, hogy mennyire nem jól működik, a kezdeti kód óta folyamatosan kerül át a normál ALU-kra a feldolgozás, mert hiába jó papíron a tensor valamire, ha nem olyan dologra használod, amire le van tervezve a hardver."

Ezzel ugye nem azt akarod mondani, hogy a tensor magokat az Nvidia nem az DLSS felskzálázó megoldáshoz tervezte, hanem alapvetően professzionális/AI célokra, és csak megpróbálta valamiképp hasznosítani, ha már benne van a hardverben és úgy adta el(ő), mintha ez mindig is a gamereknek készült volna?

Találgatunk, aztán majd úgyis kiderül..

Jack@l

veterán

A linken amit beírtam, már találgatják kommentekben, hogy lehet a laczosnál jobb minőségű felskálázásokat beépíteni reshade-be.

Majd fsr2-ben meglépik 1 év mulva, mint csodatétel.

[ Szerkesztve ]

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

Yutani

nagyúr

A Tensor magok nem a DLSS miatt kerültek bele az NV hardverekbe:

NVIDIA Tensor Core technology has brought dramatic speedups to AI, reducing training time from weeks to hours and providing massive acceleration to inference. The NVIDIA Ampere architecture provides a huge performance boost and delivers new precisions to cover the full spectrum required by researchers— TF32, FP64, FP16, INT8, and INT4—accelerating and simplifying AI adoption and extending the power of NVIDIA Tensor Cores to HPC.

Forrás: NVIDIA

#tarcsad

Z10N

veterán

Samsung Exynos 2200 now rumored to feature 384 AMD RDNA2 Stream Processors

# sshnuke 10.2.2.2 -rootpw="Z10N0101"

Z10N

veterán

AMD Radeon RX 6900 XT LC with Navi 21 XTXH GPU has been tested

# sshnuke 10.2.2.2 -rootpw="Z10N0101"

hokuszpk

nagyúr

"A másik dolog, hogy az AMD régóta tart FidelityFX-es preziket, és sokszor elmondták már, hogy az elmúlt évtizedben arra jöttek rá, hogy sokszor a legegyszerűbb megoldások a legjobb válaszok egy problémára"

ha meghivtak volna egy meetingre, kapasbol bebofogom, ugyanis ezt a valaszt mar ugy 40 eve megtanultam, es akkorsem en talaltam fel, hanem a tanero igensokszor elmondta. Es megcsak nem is egyetemi vagy mernokkepzorol volt szo.

* szerintem mindenki ismeri a peldat a milliardokbol fejlesztett Amerika urtollrol ; az "Oroszok ceruzat hasznaltak" csattanoval.

[ Szerkesztve ]

Első AMD-m - a 65-ös - a seregben volt...

Téma tudnivalók

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.