A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Gyorskeresés

Legfrissebb anyagok

- Bemutató Spyra: akkus, nagynyomású, automata vízipuska

- Bemutató Route 66 Chicagotól Los Angelesig 2. rész

- Helyszíni riport Alfa Giulia Q-val a Balaton Park Circiut-en

- Bemutató A használt VGA piac kincsei - Július I

- Bemutató Bakancslista: Route 66 Chicagotól Los Angelesig

Általános témák

LOGOUT.hu témák

- [Re:] [Doky586:] Helyreállítási partíció létrehozása (javítása)

- [Re:] [sziku69:] Szólánc.

- [Re:] Toyota Corolla Touring Sport 2.0 teszt és az autóipar

- [Re:] [Mr Dini:] Hálózati problémából kiber-versenyfeladat!

- [Re:] [antikomcsi:] Való Világ: A piszkos 12 - VV12 - Való Világ 12

- [Re:] Gurulunk, WAZE?!

- [Re:] [bb0t:] Gyilkos szénhidrátok, avagy hogyan fogytam önsanyargatás nélkül 16 kg-ot

- [Re:] [GoodSpeed:] Új alaplap, vagy BIOS frissítés után beállítandók II. Secure Boot

- [Re:] [gban:] Ingyen kellene, de tegnapra

- [Re:] [Luck Dragon:] Asszociációs játék. :)

Szakmai témák

PROHARDVER! témák

Mobilarena témák

IT café témák

Téma összefoglaló

Hozzászólások

IzI

senior tag

Néztem én is,de jó lett volna egy 12gb-os kártyát közélyük rakni.

-

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Abu85

HÁZIGAZDA

A Navi 32-re 16 GB-ot tudnak tenni. A Navi 33-ra 8 vagy 16 GB-ot.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

S_x96x_S

őstag

> Nekem nagyon furcsa, hogy az emberek miert viszik ennyire a 4070Ti-t

nekem annyira nem furcsa.

egyrészt jelenleg az a legolcsóbb Ada Lovelace alapú nVidia kártya.

ha kijön az olcsóbb 4070 akkor azt viszik majd sokan.

Amúgy ha valakinek fix budget-je van, akkor kevésbé számít az ár/érték.

és ha a CUDA létszükséglet (ai/gpt) akkor a Radeon rizikós alternativa.

> Ugy latom sokan szeretik ha faj

ha valaki upgrade kényszerben van akkor valahol mindenképp fájni fog ..

ha másbannem, akkor a 4090 -es árban fog fájni ..

a VRAM szűkösség

- sokak által nem ismert ..

- a holnap problémája ( vs. a ma problémája, hogy ki kell fizetni )

vagyis bár igazad van, csak abban vagyunk szabadok, hogy eldönthetjük,

hogy hol fáj ..

u.i:

Amúgy ha jönnek a CXL-es Gen5-ös GPU-k, akkor a szükös memória problémájára

az már ad egy részleges megoldást ..

[ Szerkesztve ]

Mottó: "A verseny jó!"

GeryFlash

veterán

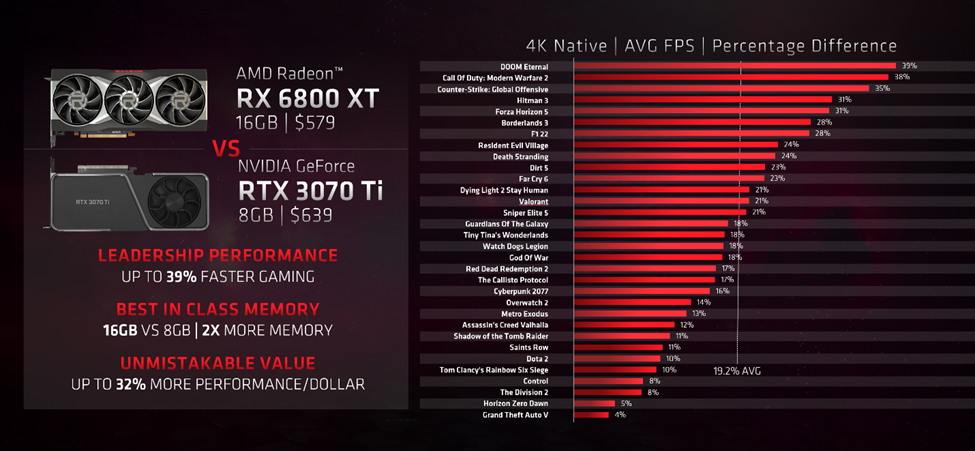

Mondjuk az AMD ezt a 39%ot 2 kartyaval hozza ossze mig az Nvidia az 54%-ot 3 kartyaval.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

GeryFlash

veterán

Te is tudod, hogy azzal hogy EBBEN a pillanatban meg nincs VRAM bottleneck, attol meg a kovetkezo 6-12 honapban erkezo UE5 engine jatekdomping utan ez nagyon nem lesz igaz. Itt most nem a jovoallosagrol beszelek, ez konkretan kezelheto jelenkent is, annyira a kuszoben vagyunk valaminek. Egy 3090-nel kicsit erosebb VGA feleakkorra VRAM-mal. Nonszensz.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

Egyetértek természetesen, mint írtam is 16 GB lenne rá ideális, sőt annyi lenne rá kötelező. De azért ez sok mindentől függ, kinek mennyire bírja a jövőt. ( célfelbontás például,1440P-n azért nem hiszem hogy limitálni fog az UE5 sem 12 G Vrammal, mert ha igen akkor a 16 GB is kevés 4 K-ra..) .

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

S_x96x_S

őstag

AMD blog: "Are YOU an Enthusiast?" avagy VRAM ...

https://community.amd.com/t5/gaming/building-an-enthusiast-pc/ba-p/599407

Radeon™ RX 6800 XT (16GB) versus RTX 3070 Ti (8GB)

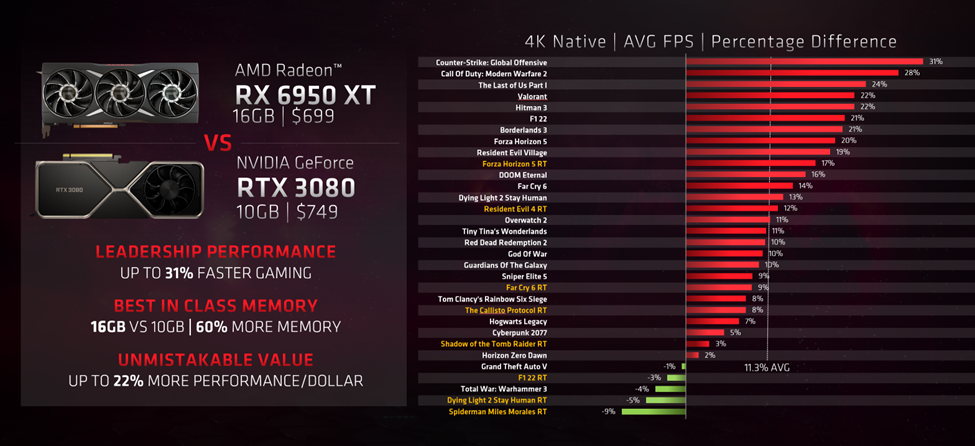

Radeon™ RX 6950 XT (16GB) versus RTX 3080 (10GB)

RX 7900 XT (20GB) versus RTX 4070 Ti (12GB)

RX 7900 XTX (24GB) versus RTX 4080 (16GB)

Mottó: "A verseny jó!"

AMD bele is állt a témába, nagyon helyes. Azért a saját mérések sántítanak kissé a Tom's szerint.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Alogonomus

őstag

Igazából valószínűleg univerzálisan az lesz a megoldás a túl kevés memória esetén, amit az UE4-es Hogwarts Legacy alkalmaz már.

A játékmotor igazodik a rendelkezésre álló erőforrásokhoz, és egyes objektumokhoz betölti a részletes textúrát, a többi objektumra pedig egy a memóriakapacitásba még beférő szintű egyszerűbb textúrát tölt csak be. Az érintett objektumok körét pedig folyton cserélgeti, hogy amikor körbenézel, akkor időről időre mindegyik objektum magas részletességű modelljét láthasd, csak nem egyszerre mindet. Ez nyilván csúnyább látványt nyújt, és a képernyőmentés eredménye nem lesz szép, de legalább a játék nem fog az elégtelen memória miatt szaggatni.

A másik lehetőség pedig, hogy a driver "felülvezérli" a játék beállításait, így a memória elég lesz, csak a kép lesz olyan, mintha alacsonyabb grafikai beállításon futna a játék.

HSM

félisten

"az lesz a megoldás a túl kevés memória esetén, amit az UE4-es Hogwarts Legacy alkalmaz már"

LOL, ezt a megoldást már közel 15 évvel ezelőtt tudta pl. a GTA4. Remek élmény volt, amikor apránként eléd épült a város...  [link]

[link]

Normális mennyiségű VRAM-al szerelt kártyát kell venni, ilyen egyszerű... Nem belemenni az előrelátható avulásba...

Nyilván 12 GB vramnál nem lesz ilyen drasztikus különbség, de biztos hogy ehhez is hozzá fognak nyúlnia fejlesztők. A másik ami segíthet a CXL hardverek megérkezése.

Természetesen ilyen drága hardvereknél azért nevetséges, hogy + 4 GB vram hiánya okoz problémát egy 800+ Euros GPU nál.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Petykemano

veterán

CXL - most már csak az a baj, hogy a tierrel nem csak a RAM mennyisége, hanem a pcie szélessége is csökken.

Találgatunk, aztán majd úgyis kiderül..

Alogonomus

őstag

8 vs. 16 és 12 vs. 20 (3090 esetén 24) között arányaiban nem sokkal kedvezőbb a különbség, csak már valószínűleg nem 1080p esetén jelenik meg a hatása, hanem 1440p, vagy 4k esetén, ahol az 1000 Euro környékén kapható kártyákat használni szeretnék az emberek.

Bár - ha hihetünk a kijelzésnek - 1080p esetén is 14 GB memóriát foglal le összesen a két játék futtatása a 6800-on, vagyis ennyire "éhes" játékok esetén a 12 GB már 1080p esetén is valamennyire korlátozó adottság lehet.

[ Szerkesztve ]

A 4070 Tiről beszéltünk feljebb, az 12 GB , nem 8. Ott azért GDDR6X van benne nem GDDR6 ami ha nem is nagy durranás de némileg gyorsabb plusz van valami emlegetett memória dekompressziós technika állítólag az Adában és jóval nagyobb L2 az Amperehez nézve. ezek mind valamelyes ellensúlyozzak a dolgokat, főleg az L2 mérete.

Az hogy 1080P-n korlátozna 12 GB vram szerintem hülyeség, a ló túloldala , egy fejlesztő sem hülye. 1440P ben sem korlátoz.

Maradjunk annyiban hogy necces és értelmetlen spórolás, de a kártya ma használható, tervezett elavulással.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

HSM

félisten

"Ott azért GDDR6X van benne ... plusz van valami emlegetett memória dekompressziós technika állítólag ... nagyobb L2 az Amperehez nézve. ezek mind valamelyes ellensúlyozzak a dolgokat, főleg az L2 mérete"

A memóriából hiányzó dolgokat semmi nem fogja pótolni. Szépen meg kell várnia a GPU-nak, mire átcsorog a PCIe-en, vagy használni a rosszabb minőségű alternatívákat, amik rendelkezésre állnak. Esetleg a DirectStorage tud ezen talán kicsit segíteni, hogy hamarabb megérkezzen, de a méretet ez sem fogja helyettesíteni, ez borítékolható.

Egyébként a 12GB-ot tartom a kisebb gondnak, a nagy, hogy mennyi pénzt kérnek érte...

Annak idején pl. az RTX3060-on teljesen rendben volt a 192 bites busz + pici GPU + 12GB ram, 330$-ért. Legyen infláció és 500$. De 8-900$?!

[ Szerkesztve ]

Persze hogy nem pótolja( nem is ezt írtam) , csak némileg javít rajta, főleg a nagy L2.

500$ lenne a reális ára. ebben a formában. Olyan érzésem van hogy az összes SKU elcsúszott nevezékben egyel feljebb.

Szerintem amikor látták hogy az AMD 20-25 % kal lassabb az előzőleg beharangozotthoz képest fogták aztán a 4060Ti ból lett 4070 Ti a 4070Ti ből 4080 és így tovább , ott lapul még egy 15-20% kal gyorsabb SKU a tarsolyban amire nem volt így szükség behozni.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

HSM

félisten

A 4070Ti-t ráadásul eredetileg 4080 néven akarták behozni, az szép lett volna, ha nem söpri el a népharag...

Az L2 egyébként semmit nem fog javítani a késleltetésen, míg megérkezik a rendszer felől az adat, ami nem fért el a VRAM-ban...

[ Szerkesztve ]

Abu85

HÁZIGAZDA

A DirectStorage az csak ront a memória problémáján, mert a GPU-s dekódolás miatt nem csak a dekódolt textúrákat kell tárolni, hanem a kódoltakat is. Tehát az lehet, hogy ez a technika gyorsabb betöltést és jobb streaming képességeket biztosít, de ennek az ára, hogy jobban zabálja majd a VRAM-ot.

Ezen egy olyasmi módszer segítene, hogy lenne egy API a lapalapú menedzsmentre, hogy ne teljes nagy allokációkat, hanem szimplán 4 kB-os lapokat mozgasson a rendszer. De ez PC-n nincs csak konzolon.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Pug

veterán

Abu, tudsz bármit AMD oldalról Path tracing, FSR3-mal kapcsolatban?

Abu85

HÁZIGAZDA

Az AMD inkább a FidelityFX Brixelizert fejleszti. Ennek a lényege, hogy a mostanihoz hasonló RT effektek 3-4-szer gyorsabban is kiszámolhatók lesznek. Az FSR 3 meg majd gyün, de annyiban nem fog különbözni a DLSS3-tól, hogy használhatóbb legyen, szóval ugyanaz a fos generálás lesz tele hibával és plusz késleltetéssel. Úgy meg minek?

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

"Ennek a lényege, hogy a mostanihoz hasonló RT effektek 3-4-szer gyorsabban is kiszámolhatók lesznek."

AMD marketing üzente ?

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Abu85

HÁZIGAZDA

Ahogy csinálják ez normális lehet, hiszen a mostani RT problémája az, hogy fos az API működése. Ha SDF-et használnak, akkor az bőven gyorsabb ennyivel, mert pont kikerüli azt a részt, amiben a DirectX Raytracing iszonyatfos, és ez a rész okozza azt, hogy sokkal több erőforrást zabál a rendszer, mint amennyit amúgy kellene.

Többször írtam már, hogy a mostani DXR brutálisan korlátozott, mert iszonyatosan sok limitet generál, amit nem lehet kikerülni. Technikailag ezt az AMD sem tudja, de át lehet ugrani, hogy megszabadulj ezektől a limitektől.

Például a Dreams című játék pont azért használ SDF-et a PS4/5-ön, mert nagyon gyors lehet az eredmény. Csak PC-re ezt soha senki nem csinálta meg. Most lényegében ez lesz a Brixelizer.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Busterftw

veterán

Egy újabb félgőzös megoldás, ami csodával határos módon gyorsabb! ![;]](http://cdn.rios.hu/dl/s/v1.gif)

PuMbA

titán

Ha jön és elterjed, akkor jó lesz az AMD kártyáknak nagyon. Így tényleges előnyt tudnak felmutatni az NVIDIA-val szemben és nőnének az eladások.

[ Szerkesztve ]

Abu85

HÁZIGAZDA

Itt ez nem arról szól, hogy min jó és min nem. A probléma az, hogy a DXR egy zárt konstrukció, amit nem lehet kiismerni. És amíg különböző licencproblémák miatt ezen nem változtat a Microsoft, addig szar teljesítménye lesz. Ergo kell valami megoldás, hogy jobb legyen a teljesítmény. Ez minden hardveren működő megoldás lesz.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

és gondolod hogy ezt majd Microsoft támogatni fogja a DXR helyett? mert biztos hogy kell hozzá támogatás, hogy ne legyenek ütközések , mint ahogy 3 éve volt a nagy őszi frissitésnél hogy a két gyártó 3 hónapig nem tért magához még a normális működés szintjén is alig.

Mert ha csak AMD re lesz bízva a szoftveres támogatás abból katasztrófa lesz főleg úgy hogy ezt játék szintjére lemenve kell beépíteni és támogatni, al la Mantle.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Abu85

HÁZIGAZDA

Nem kell támogatnia, hiszen ez nem egy API, hanem egy framework, ami magán a DirectX Raytracingen fut. Csak a nem gyors részeit compute shaderre váltja, hogy gyors legyen. A DXR-nek alapvetően vannak nagyon jól működő részei, azokat fel is használja a Brixelizer. A problémás részeket ugorja át. A Microsoft számára teljesen jó megoldás ez is, mert az alap API marad a DXR-jük. Még új driverek sem kellene hozzá. Mindegyik mostani jó lesz. Módosítani sem kell semmit.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Számomra ez nagyon marketing szagú, nem tudom hol van ebben a difi.

Nvidia erre építi fel a következő generációt is ha ezt megtehetnék már megtették volna.

Lásd Neural Radiance Cache és z RTX GI 2.0 mesh shaders támogatással.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Abu85

HÁZIGAZDA

Az a baj ezzel a megoldással, hogy nagyon gyors, így nem venne senki nagyon drága VGA-t. Az NV megoldásai azért előnyösek a cég számára, mert nagyon lassúak, és ez eladja a hardvert. Azt meg a GameWorks idejében sem kérdezte senki, hogy miért lassú a kód. Az NV és az AMD felfogása itt nagyban különbözik. Az NV egyszerűen nem is kutatja a gyors lehetőségeket. De ez nem azért van, mert nem tudnák kutatni, hanem azért, mert nem része a gazdasági koncepciójuknak, mert ha gyors lenne egy effekt, akkor nem gondolkodnál RTX 40-es VGA-n. De azt amúgy sosem állították, hogy a megoldásaikat ne lehetne sokkal gyorsabban megcsinálni, tehát nem is hazudnak, csak nem fejtik ki az igazság minden részletét.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

bitblueduck

senior tag

Ha jól gondolom DirectStorage-al sem framenként akarják betölteni a hiányzó dolgokat. Akkor pedig nem fogja az pótolni a hiányzó VRAM-ot.

Mármint lehet gyors egy SSD meg a PCIe 5 x16, de pl másodpercenként 60x swapelni 2GB-nak megfelelő adatot még tömörítve is elég vadul hangzik.

An open mind is like a fortress with its gates unbarred and unguarded.

HSM

félisten

"mert a GPU-s dekódolás miatt nem csak a dekódolt textúrákat kell tárolni, hanem a kódoltakat is"

Minek tárolnák azt is? A kódolt csak addig kell, míg ki nem kódolják... Okosan használva ez a technológia szvsz segíthet gyorsabban cserélgetni a VRAM tartalmát, kevésbé okosan használva meg jobban zabálhatja is azt.

#60879 b.: Nekik a sok dedikált HW egységgel nem az az érdekük, hogy gyors shader alapú alternatíva legyen.

#60881 bitblueduck : Én is így látom, azért írtam, hogy talán és kicsit segíthet.

[ Szerkesztve ]

Abu85

HÁZIGAZDA

A VRAM-ot egyszerűen nem lehet ilyen dolgokkal pótolni. Azt jó menedzsmenttel lehet megoldani. De a DirectStorage ezen pont ront.

#60882 HSM : Ez nem olyan egyszerű ám, ahogy leírva tűnik. Amíg a dekódolás tart, addig a VRAM terhelése nagyobb. Emellett maga az allokációk törlése sem ingyenes. Tehát addig például nem is érdemes törölni a kódolt adatokat tartalmazó allokációkat, amíg nem feltétlenül muszáj, mert a törlés művelet maga sebességvesztést okoz.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Atyavilág.Te ezt komolyan gondolod és le is írtad? Úgy érzem magam mint a Kádárkorszakban ...nekem abból elég volt 10+ év. Ezt a hülyeséget híveidnek és a 10 éves AMD fanoknak tartogasd tartogasd Abu ne nekem.

Én pont ellenkezőleg, kihasználom ettől a kommentedtől kezdve a prémium tagságimat.

HSM: hát persze valószínűleg majd jön az AMD egy 3x-4x gyorsabb megoldással hirtelen mert a raytracingot kizárólag shader alapon sokkal könnyebb és gyerekjáték kiszámolni, mint láttuk az elmúlt 30 évben. Az RT részegységek részben tehermentesítik a shader hardverelemeket, nem helyettesítik azokat, innen ered a sebesség előny.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Abu85

HÁZIGAZDA

Itt a Portal RTX konkrétan profilozva.

Ez az optimalizáció mindennek ellentmond, amit az egyetemeken tanítanak. Nem a hardver a lassú, hanem maga a kód annyira szar, hogy nem tud futni normális sebességgel a hardvereken.

Az RT műveletek pedig elég lightosak.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Raymond

félisten

Tessek, eldontheted hogy mennyi valosagalapja van az allitasoknak [link] es hogy mikepp viszonyul a Brixelizer a DXR-hoz es a mondjuk a CP2077 RT Overdrive-ban latott megoldashoz.

Privat velemeny - keretik nem megkovezni...

paprobert

senior tag

"Az FSR 3 meg majd gyün, de annyiban nem fog különbözni a DLSS3-tól, hogy használhatóbb legyen, szóval ugyanaz a fos generálás lesz tele hibával és plusz késleltetéssel. Úgy meg minek?"

Ha 1:1-ben sikerül lemásolni az DLSS3-at, az fantasztikus hír.

640 KB mindenre elég. - Steve Jobs

Abu85

HÁZIGAZDA

Hát nem, mert az azt jelenti, hogy konkrétan ugyanaz a fos lesz. De amúgy nem látom, hogy az ilyen frame generálási megoldásokból hogyan lehet kevésbé fost kihozni.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

paprobert

senior tag

Lassabb játékmenetű és generálás nélkül csak közepesen - jól futó játékból fluidat csinál a DLSS3. Van értelme.

Valamint ez a hard CPU-limit egyetlen mitigációs technikája, amiről jelenleg tudok.

Ha a képminőség az AMD másolat esetében nem lesz mérföldekkel rosszabb, akkor rendben lesz, várjuk.

[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

Letöltöttem, átfutottam a következtetést nem tudom levonni sajnos az Overdrivehoz nézve. Mire gondolsz? Azt látom ,hogy API szintjén DXR, Vulkan nem probléma.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Abu85

HÁZIGAZDA

A probléma az, hogy a DLSS3-hoz mérünk, aminek a képminősége eleve problémás a belegenerált hibák miatt. Ahhoz, hogy egy ilyen működőképes legyen, a DLSS3-nál sokkal-sokkal jobban kell működnie, sokkal-sokkal kevesebb hibával. Különben pont annyira nem lesz értelme, mint a DLSS3-nak.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Raymond

félisten

Brixelizer: Real-time Sparse Distance Fields for Games

Brixelizer Global Illumination is a probe-based approach

• It’s basically screen space+

• The direct light probe is updated from screen space

• Updating out-of-screen direct light probe is very scene dependent

• Convergence over time can be visible

• Suffers from overshadowing for tiny geometry

Privat velemeny - keretik nem megkovezni...

Abu85

HÁZIGAZDA

Elejére: CURRENT LIMITATIONS

Végére: Brixelizer Global Illumination is still under development!

Csak, hogy ne hagyjuk már ki ezeket sem. Elnézést, hogy belekontárkodtam.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Jah leesett , igen ezek mellékes tények .  így már értem mire gondoltál. Busternek volt igaza meg ha jól is működik akkor is fényévekkel egyszerűbb és primitívebb a megoldás a még a PDF leírása szerint sem lehetne vele CP szintű RT megoldást összehozni.

így már értem mire gondoltál. Busternek volt igaza meg ha jól is működik akkor is fényévekkel egyszerűbb és primitívebb a megoldás a még a PDF leírása szerint sem lehetne vele CP szintű RT megoldást összehozni.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

rajtad kívül aki használni akarja az szerint jól működik a FG a DLSS3 ban.

egy kikapcsolható ficsőr.

Nincs semmiféle fos, azt teszi ami a dolga képkockát generál. Szerencsére bárki talál teszteket róla a minőségéről, és méréseket a késleltetésről, a CPU loimit csökkenéséről, mennyire zavarja ez egy egy játékos sztori alapú játékban.

Ha nem akarod használni nem használod ha akarod akkor meg aktiválod.

ha Amd előbb hozta volna már itt azt írnád hogy az AMD kifejlesztetett egy olyan megoldást ami akár 3x gyorsabb minta DLSS 2.

Gyerekes ez a fosozás minden Nvidia megoldásra tőled és azt gondolod mindenben az a jó amit az AMD hoz. lásd FSR lásd RT árnyékolás lásd RT lásd DXR lásd bármi.

Na jó tényleg elég volt ebből az ovis színvonalból. Pá.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Abu85

HÁZIGAZDA

Már bocsánat, de egy már kész képkockát csak azért nem kiküldeni a kijelzőre, hogy előbb generálj elé egy kevésbé friss, ráadásul potenciális képi hibákkal tarkított képkockát, a mélypont a rossz ötletek tárházában. És ha az AMD is ugyanezt csinálja, akkor ugyanolyan fos marad, mert pont ugyanazt a rossz ötletet lovagolják meg. Ha kész a friss és jó minőségű, valós adatok alapján számolt képkocka, akkor azt ki kell rakni! Nem érdemes húzni az időt. Azért vesz a játékos új hardvert, hogy ezt megkapja, és nem azért, hogy a nagyobb kiírható FPS-érték miatt parkoltatva legyen.

Én abszolút nem értem, hogy ezekben a lehetőségekben mit láttok. Vesztek egy új hardvert, amiben bekapcsoljátok a köztes frame generálását, hogy végül az elméletben lehetségesnél később kapjátok meg a legfrissebb képkockát. Why?  Pont azért veszitek a drága új hardvert, hogy hamarabb kapjátok meg az eredményt, és bekapcsoltok egy olyan dolgot, ami ezt késlelteti. Nem beszélve a belegenerált képi hibákról.

Pont azért veszitek a drága új hardvert, hogy hamarabb kapjátok meg az eredményt, és bekapcsoltok egy olyan dolgot, ami ezt késlelteti. Nem beszélve a belegenerált képi hibákról.  Nem az a durva, hogy van ilyen, hanem az, hogy ezt el is lehet adni, és láthatóan már két cég hiszi azt, hogy van piaca annak, ha a játékos a nagyobb FPS-ért rontja a saját felhasználói élményét.

Nem az a durva, hogy van ilyen, hanem az, hogy ezt el is lehet adni, és láthatóan már két cég hiszi azt, hogy van piaca annak, ha a játékos a nagyobb FPS-ért rontja a saját felhasználói élményét.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Raggie

őstag

Szerintem. Ezt a frame generálást csak akkor kapcsolják be a játékosok, ha az FPS 20-30 körül van. Akkor nem lesz előbb legenerált friss képkocka amit ki lehetne tenni, hanem nagyon jól jön nekik a köztesen legenerált "hamis" képkocka is.

Vagy ha mégis pont az egyik legenerált képkocka kicsit késlelteti is a valódi frame-et akkor ott már nem veszed észre azt a kis késlektetési többletet, mert eleve nagyon magas a késleltetés az alacsony valós FPS miatt.

Az általad felhozott probléma akkor jönne elő, ha 70-80-90 FPS valós teljesítményhez kapcsolják be, hogy az 200 FPS legyen a "hamis" frame-ekkel. De erre nem fogja senki használni, mert ekkor inkább a frame generation nélküli normál DLSS-t fogják használni, ami így is kiad 150 FPS-t és nincs benne ilyen...

Szerintem ezért a most felhozott ellenérved nem igazán állja meg a helyét.

Clint Eastwood FTW

DudeHUN

senior tag

Nem tudom használtad-e. De pont ennél a 20-30 fps-nél nem a legjobb. Nő a késleltetés és ilyen alacsony fps esetén nem a legjobb élmény lesz a dolog. Hiába néz ki folyamatosabbnak. Én 60 fps alatt nem használnám a DLSS3-at.

De igazán szerintem akinek ilyen 200+ hz-es kijelzője van, annak jó lehet. Mert nagyobb képkockaszámnál nem érzékelhetőek a képhibák és a hozzáadott késleltetés is olyan minimális, ami nem érzékelhető szvsz. Cserébe folyamatosabb a kép.

Tök jó szerintem ez a frame generálás (meg alapból a DLSS), csak meg van a helye és hogy hol van értelme használni.

Gamer for Life

Raggie

őstag

Nem használtam, mert nincsen már vagy 15 éve nVidia kártyám.

De ez nem úgy van, hogy a "hamis" frame-eket villámgyorsan ki tudja számolni a VGA és ezért azok nem okoznak igazán nagy késleltetési többletet?

Vagy valamit akkor nem értek jól.

[ Szerkesztve ]

Clint Eastwood FTW

Téma tudnivalók

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

Mai Hardverapró hirdetések

prémium kategóriában

- Keresek - Macbook Air M3 16GB / 24 GB - 512 GB SSD - Magyarországi beszerzés, tehát kb. 3 év garit

- Tyű-ha Lenovo Thinkpad T14 G2 Üzleti "Golyóálló" Laptop 14" -50% i7-1185G7 4Mag 16GB /512GB FHD IPS

- Ej-ha Lenovo Thinkpad T14 G2 Üzleti "Golyóálló" Laptop 14" -50% i7-1185G7 4Mag 32GB /512GB FHD IPS

- Eladó Nitro Venture TLS Snowboard Bakancs 46-os

- Eladó Nitro Team 2022 162W Snowboard Deszka