Hirdetés

- Luck Dragon: Asszociációs játék. :)

- bb0t: Ikea PAX gardrób és a pokol logisztikája

- gban: Ingyen kellene, de tegnapra

- sziku69: Szólánc.

- sziku69: Fűzzük össze a szavakat :)

- eBay-es kütyük kis pénzért

- D1Rect: Nagy "hülyétkapokazapróktól" topik

- D@reeo: Pi-hole és a Telekom Sagemcom F@st 5670 DNS beállítása

- Brogyi: CTEK akkumulátor töltő és másolatai

- Sub-ZeRo: Euro Truck Simulator 2 & American Truck Simulator 1 (esetleg 2 majd, ha lesz) :)

Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

Az Ethereum 2.0 nem fog majd igazán jól futni GPU-n. De mire kivezetik a PoW rendszert, addig még eltelik három év, ameddig az Etheriumon lehet keményen bányászni egy GPU-val is. Emiatt ugranak egyre többen rá, mert most még van benne GPU-val kinyerhető pénz. Majd amikor csak PoS blokkok lesznek, akkor vége lehet a GPU-s bányászatnak Ethereumon, de ez 2023 előtt tuti nem jön el. Akkor majd keresni kell egy új kriptovalutát.

-

Piszmaty76

aktív tag

Nekem úgy tűnik, hogy eddig is az AMD volt aki közzé tette a dolgait a "közjó érdekében" (részben ezért is szimpatizálnak ennyien a céggel), míg az Nvidiára inkább az (volt) a jellemző, hogy sörétessel ücsörög a cuccain hevesen morogva, ha valaki közelebb menne hozzá. Nem véletlenül AMD cuccok ketyegnek a konzolokban. De valóban, olyan érzésem van mintha idén a két cég egy csomó mindenben helyet cserélt volna...

-

-

#09256960

törölt tag

Su királynő kegyet gyakorolt, AMD procikkal is engedik az NV SAMot. Nesztek pribékek

PanemSAM et circenses.

-Szerinted jól tette ezt ?

de ha már itt vagyok...

Ja azok a kazán 6800-asok alulfeszelve 183 wattot fogyasztanak.

Jajj azok a régi szép idők amikor emberek három naponta bementek AMD találgatósba hogy mennyire fontos a performance /watt vajon most is járják NV fórumokat és jajgatnak? és logout cikkeket írnak róla ??? vagy kettős a mérce ?? hm hmmm -

#09256960

törölt tag

A 20 GB AZ JÓ. !!!

Mert akkor kérhet érte többet mint a 6800XT.

Ha 7nm-en hozza le adom a +10%ot is.

Mindkettőnél megér 10-10% felárat.

Na most NVt ismerve ez a 20% ez 40 lesz.

és adni fog egy amúgy jó kártyát csak 999 dollárért több memóriával de a 6900 XT teljesítménye alatt.

Már csak arra vagyok kiváncsi hogy "a 10 GB mindenre elég "szlogenes emberek hirtelen mire váltanak majd át

-

do3om

addikt

Amd oldalon egy plusz pont a 16gb ram .

Kíváncsi vagyok majd azért a többi tesztre is de igen jól kijött most a lépés az amdnek. A memória mérete sokaknak lesz döntő szempont, hát ha még az ellátás is jól menne... De ez sajnos most nagyon kiseséjes.

Nv komoly bajban lesz azzal hogy mit lépjen. Árcsökkenés lenne a legjobb, persze majd meglátjuk az AMD árait.

RAM témában viszont nehéz lesz ha hoz többet ezen az áron mit szólnak a régi vevők. -

gejala

őstag

Azért az is megér egy misét, hogy 5500XT ugyanannyi fpst hoz 1080p/1440p/4K-ban. Mondjuk abból az 5-ből nem nagyon van mit elvenni, de akkor is.

Az a durva VRAM használat meg félig lett igaz. 4K-ban 10 giga simán elég, viszont a 3-4 gigás kártyáknak annyi 900p-ben is. Nem mintha 6 gigás 1060-on játszható lenne az a 26 fps.

-

Kolbi_30

őstag

Mivel itt ezen a forumon/oldalon mindenki maximalista akkor ugye au ultra -high preset es rt az kb 600k+a tobbi alkatresz kezdodik..mert 100 fps alatt szedul hanyingere van meg stb..akikit ez zavar nyugodtan veheti milioert a gepet. akit nem az vehet konzolt. nekem se milios gepem se konzolom sdincs, de nem is a 100+ fpsre verem a bret..

-

szmörlock007

aktív tag

Persze, nekem is csak a pc-re is kijövő címek játszanak, de a watch dogs az szerintem inkább múlt a fejlesztőkön mint a hardveren. Szerintem lesz ez jobb is ahogy elkezd olajozottan működni a gépezet, azért itt most sok minden közbejátszik, időbe telik míg letisztul a kép a konzolokról. Szerintem amúgy mindkettő nagyon jól sikerült a maga módján.

-

szmörlock007

aktív tag

Jó hát a Ubisoftól első körben mit vártunk?

Az a játék megjelent mindenre, szerintem semmi optimalizációt nem kaptak az új konzolok csak rádobták és annyi. Lesz ebben még sokkal több is, azért a ps5-ös spiderman miles morales szerintem gyönyörű, és a ray-tracing is kiváló benne ha nézted a digital foundry elemzését. -

FLATRONW

őstag

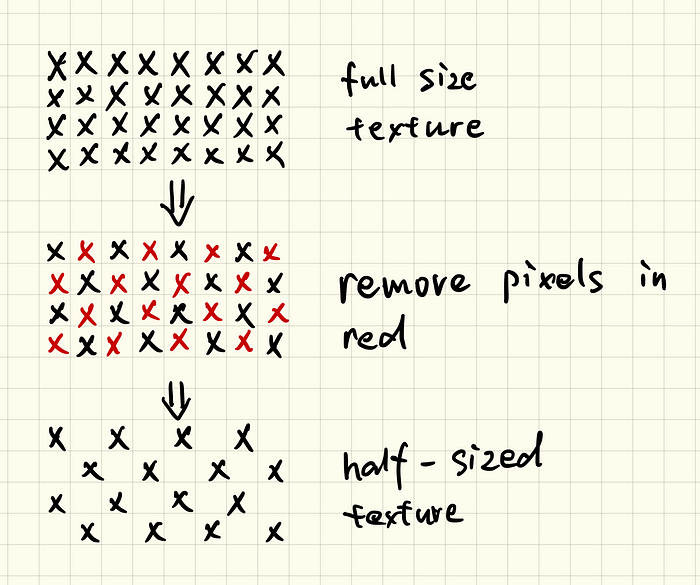

Ha jól értelmezem, akkor a checkboard rendering az hasonló, mint a filmeknél az interlaced felbontás.

Annyi különbséggel, hogy nem a páros és páratlan sorokat tünteti el, ezzel megfelezve a függőleges felbontást (1080i - 540p), hanem a soronként felezi meg a pixelek számát. Az egyik sorban a páros pixelek hiányoznak, a másikban pedig a páratlanok. A hiányzó pixeleket pedig az előző képkockákból interpolálják. Természetesen ez egy összetettebb folyamat, mint az interlaced megoldás, így a minőség nem is romlik annyit.

-

Bőven lehet százszámra mutatni játékot ahol nincsenek ilyenek. Igaz egyiknél sincs a DLSS használva olyankor.

Ez nem bug, hanem DLSS "feature". Az algoritmus velejárója és nem lehet kijavítani. Nem tudsz vele mit csinálni. Ennyire elvakult ember az univerzum létrejötte óta nem volt még... -

#09256960

törölt tag

Én meg szokás szerint ráengedem a Google translate-t:

"Ez azt jelenti hogy a support nem azt jelenti hogy csak neked támogatok valamit mert azon többet bukok mint nyerek, a díl csak úgy köttetik meg ha egy mindenki számára futtatható standard eljárást használok RTben is. A vad paripa bement az egyen istállóba és otthagyta a pont rászabott LÓ alakú istállót."

Nagyon jó ez a google translate hogy így érti a lényeget , de mi lehet az a díl ?

-

Abu85

HÁZIGAZDA

Így pedig Kína mondhatja, hogy ők tisztán játszanak, hiszen a több kínai vezető mást akar. Mennyire kár, hogy Wu hatalma jelenleg túl nagy, és Hszi Csin-ping ezt biztos elképesztően sajnálja is...

Ha Kínának Wu tényleg annyira nagy probléma lenne, már rég eltávolították volna. Gondolod pont egy ilyen illiberális államban nem tudnak piszkos eszközökhöz nyúlni? A valóság az, hogy Kínának nagyon is tetszik az a káosz, amit Wu teremt, mert egy olyan üzletet hátráltatnak vele, ami az országnak rossz. A megegyezés csúszásával viszont fel lehet készülni a későbbiekre. -

Abu85

HÁZIGAZDA

Amit nem fog megkapni, mert az brutálisan sok, vagyis végeredményben teljesíti azt a szerepet, amit rábíztak, hátráltatja az üzlet létrejöttét, amíg a kínai projekteket leszedik az ARM-ról.

Idővel majd el fog fogadni egy ajánlatot, és amikor megy ki az ajtón, akkor visszafordul, hogy sajnálja, hogy Kína otthagyja az ARM-ot. Ez politika már, érdekek és érdekellentétek.

-

-

awexco

őstag

Google is MS is pl Hollandiában meg gondolom sok helyen kurva nagy serverparkokat épít ki most még viszi a pénzt de ha teli lesznek .... Kvázi jó pár csont üresen áll !!!

Ms datacenter amsterdam mellett pl ha elkészül Lesz több is máshol (bár nem tudom azok mekkorák) én az egyiket láttam belüröl a teljes park csúcson olyan 500MW fogyasztásra képes . Szal Paks csúcson 4db ilyet bírna el ami a Magyar energiatermelés felét adja ....

a teljes park csúcson olyan 500MW fogyasztásra képes . Szal Paks csúcson 4db ilyet bírna el ami a Magyar energiatermelés felét adja ....

-

awexco

őstag

Komplikált ez azért ... mert vannak jó fejlesztések is a rosszak mellett mindenhol .

Az biztos , h AMD most sinen van . Teszkó gazdaságosan nem öntik ész nélkül a pénzt sehova (pláne hogy nincs is még ) . Idővel majd megjön az eredménye .

) . Idővel majd megjön az eredménye .

Talán IBM ami megérne egy misét ... nagyon kezd lekerülni a térképről de még mindig bazi nagy cég . Lehet talpra , növekedési pályára álnak ők is . -

awexco

őstag

Az , h túl van árazva a tőzsdén az nem a valós értékét jeleni . Valós adatok tekintetében próbáltam összehasonlítani. Bár most AMD felszálóba van majd meglátjuk pár éven múlva hova jutott.

Xilinx tekintétében Ott kapásból jónak tűnik a dolog . Szerverekbe , de akár desktopba mehetnek árúkapcsolásba dolgok . pl amd cpu, gpu , xilinx lan , wifi stb ... csak egy példa ...

Tuti vannak extrémebb dolgok is amire mi nem látunk rá .

Nvidia esetén elképzelésem nincs , hogy miért jobb így mintha licenszelték volna .

Persze , h legyen teljes platformja az érthető . Lehet az a cél , h szerver célra csak ők legyenek és ne legyen konkurencia ? Persze az AMD , Intel ellenében . Lehet ez a cél nem tudom .

Szívesen meg hallgatom más érvelését . -

#09256960

törölt tag

Nem megváltás, csak arról van szó hogy AMD konzolokon átívelő megoldást hoz. Azaz amit Ps5,-ön Xboxon fejlesztenek tartalmazza NVnek meg szépen plusz pénzért bele kell fejleszteni DLSS-t.

Nem mondjuk hogy rossz a DLSS 2. (1.3 aLatt mondjuk )

)

Ha a program NV supported akkor a Gamernek mindegy.

Miért erősíteni azzal az NV-t AMD hogy megcsinálja ugyanazt a megoldást mint ő és tálcán átnyújtja neki a konzol kompatibilitást ?

Csináljá CPUt lesz SAM-od, csinálj konzolt lesz konzolközeli hardvered. Még meg is előzheti egy supported konzol játékban csak ez mindig PAY TO WIN lesz.

Mondjuk most biztos sok pénze van NVnek mert csak azt az 1000 eladott 3080-hoz adott kupont kellett kifizetniük Európába

-

imi123

őstag

Ja ja.

dxr 1.1-ben fog látszani mit tudnak a nextgenek.

Fölösleges előre temetni az Nv-t,driverből még bőven fognak gyorsulni.

Remélem verseny lesz és mindenki tud kártyát venni és nem csak teszteken csurgatjuk a nyálunk.

Első komoly megmérettetés cyberpunk 2077 teszt lesz.Szóval találkozunk ugyan itt 1 év múlva.

-

Malibutomi

nagyúr

GDDR6X lesz az, ha a vagott GA102-bol jon.

Csak az NV toke (mar bocsanat ketfelol is presben van. Arcsokkentes az problemas a draga GDDR6X miatt

Az uj kartyak 3070ti-3080ti is..mert amugy is hiany van ha meg tobbfele akarjak osztani az a hangyafingnyi legyartott mennyiseget meg rosszabb lesz.Megszivattak magukat most erosen.

-

Persze, mindenki meglephet, csak azt mondom, hogy a 6800 eseten lehet, hogy direkt, kalkulalt overprice-szal jott ki az AMD...

Meg azt azert ne felejtsuk el, hogy szar kihozatal eseten azert nem annyira egyszeru a price cut, mint jo mellett... es az biztos, hogy az Ampere eseten sok minden a kihozatal, csak eppen nem jo...

-

Vagy ha feltetelezzuk, hogy kihozatal szempontjabol a 72 CU-s chip a sweetspot es ezert inkabb a kezdetben aranylag kevesebb 60 CU-s chip helyett a 6800XT akarjak kiszorni es majd kesobb, ha a selejtbol nagyobb a felfutas, akkor akar arat is lehet csokkenteni a 6800-on, foleg ha beesik egy vele egy szinten levo 3070Ti..

-

Malibutomi

nagyúr

RT-rol szerintem addig nem lesz szo amig nincs jatek ami tamogassa. Eddig nem volt RT kepes AMD kartya.

Illetve elvileg Port Royal szivargott mar, es a 2080ti felett vannak picivel RT-ben az alapjan.

A tobbi szerintem okes, DX11 vs DX12 par FPS-t szamit a legtobb jatekban, nagysagrendileg nem befolyasol semmit

50dollar arelony hasonlo teljesitmennyel, jobb fogyastzassal, tobb VRAM-al 3080-hoz nagyon jo.

Plusz arazas 3070-hez nem jo, de gyorsabb kartya dupla VRAM-al...en AMD helyeben levinnem 480-500-ra, es akkor 3070 kanyec.

-

#09256960

törölt tag

Régen tudod volt az a matrica (hitelesítő tanúsítvány) hogy VR Ready, most lesz egy Cat Freindly matrica , amúgy számomra az érdekes hogy miért nem tesztelte még senki hogy egy 20 fokos 30 NM2-es szobát mennyivel emel meg 300-350 Watt.

Plusz két fok télen is lehetne a matricán

még a Gréta Tumberg is melléállna, ne füts, játsz !

-

#09256960

törölt tag

Nem az hogy rettegnek csak hozzá igazítja az árát, meg ha nekik is lesz 12GB akkor kisebb az elégedetlenség

Szerinted nem GDDR6-al tudja ezt elérni ? Más módszert én nem ismerek, kesst már biztos nem épít bele hirtelen a 3080TI-be ..

Ugye most erről beszélünk: Link

300 is sok csak ha nagy tömegeket kérdezel meg akkor a 300ra még sokan azt mondják válalható 420 felett elhagyoda valóságot hogy a Neotonnal válaszoljak

-

Abu85

HÁZIGAZDA

Írni lehet erről, de a TSMC szempontjából miért is adná olcsóbban a wafert, ha eladja normál áron is. Attól, hogy a DigiTimes ír valamit még nem jelent semmit. A DigiTimes azt is állította már, hogy a Zen 3 5 nm-en jön, aztán látjuk, hogy rohadtul nem. De anno le is írtam, hogy miért volt faszság, amit írtak. [link]

A probléma az, hogy média nem tudja elképzelni, hogy a Samsung jót tud gyártani. Pedig igazából a 8 nm egy proven technology. Nem új dolog, évek óta hibátlanul gyártanak rajta vagy a korábbi verzióján a cégek. De ami ennél is durvább, hogy sokan azt hiszik, hogy 7 nm-re könnyű átugrani. Ahogy a DigiTimes azt hitte, hogy 5 nm-re ugrani csak egy döntés, de nagyon nem, bizonyos node-ok nem kompatibilisek egymással, és az áttervezés ideje másfél-két év.

Az NV-nek nem feltétlenül a waferár a gondja a TSMC-nél, hanem az, hogy ha például ma eldöntik, hogy átmennek, akkor abból 2022 első negyedévében lesz termék. Ezt már innen nem viszik sehova. Az ilyen problémákat hagyni kell a fenében, és át kell ugrani azt. El kell vonni az erőforrást a fejlesztéstől, majd koncentrálni a következő generációra.

-

Abu85

HÁZIGAZDA

Minek reflektáljon rá a Samsung? Nagyon régóta működik a 8 nm-es eljárásuk. Az NV előtt sok cég csinált már rá több tucat lapkát, mindet probléma nélkül. A half-node-okkal sosincs igazán baj, mert az mindig egy továbbfejlesztése egy már évek óta tökéletesen működő node-nak, jelen esetben a 10 nm-es eljárásnak.

Akit érdekel a 8 nm, az tud kérni a Samsungtól jelentést, hogy mire képes, és az ezerszer több adatot jelent számukra, mint a pletykacikkek. Az alapján fogják eldönteni, hogy ez az ideális választás-e számukra. Az NV is így csinálta. Kértek jelentést a TSMC-től és a Samsungtől az elérhető gyártástechnológiákra. Ezeket a bérgyártók megadják, természetesen a többi partner adatainak a védelme mellett.A 7 nm-es TSMC node-ra való áttérés lehetséges, de a Samsung és a TSMC gyártástechnológiai nem kompatibilisek, tehát ez nem olyan, hogy akkor eldöntöm, hogy inkább a TSMC, mert előbb át kell tervezni a dizájnt, hogy ott is gyártható legyen. Az NV ezt vállalhatja, de ha ezt eldöntik egyszer, akkor onnan másfél év legalább, hogy tömeggyártható lapkák szülessenek. Tehát, ha még csak most gondolkodnak egy ilyen váltáson, akkor az Ampere refresh az kb. egy 2021Q1-es történet lesz. Jóval hamarabb kellett erről dönteni, ha egy refresht akarnak csinálni 2020-ban.

#41781 b. : De a Samsung nem onnan szerez vevőket, akik a pletykalapokat olvassák. Ha van érdeklődő, akkor ők direkt felkeresik a céget, és kikérik az adatokat az adott node-ra.

A TSMC senkinek sem ad kedvezményt. Lehet licitálni a gyártókapacitásra és kész. Akinek nem tetszik, az várhat a következő licitekre. A TSMC-nek mindegy, a pénzüknél vannak mindenképpen maximum nem az NV-nek gyártanak, hanem a Qualcomm, Apple, AMD, Xilinx, akárkinek. De ha ez a rendszer nem jó, akkor lehet menni máshova, de kedvezmény itt sosincs. Ellenben mindenkinek van esélye waferhez jutni, csak túl kell licitálnia a többieket. Az NV elsődlegesen azért keresi a Samsung kegyeit, mert az említett cégekkel szemben nem túl könnyű waferekhez jutni, ha a Xilinx nem is feltétlenül, de az Apple, AMD, Qualcomm simán túllicitálja őket, és akkor még jön az Intel is a TSMC node-jaira. Ők is olyan piacokat céloznak, amiből okádni tudják a pénzt a TSMC-nek.

Arról nem is beszélve, hogy a TSMC nem különösebben érdekelt abban, hogy specifikus node-okat tervezzen egy olyan megrendelőjének, aki messze nem a legnagyobb. Ellenben a Samsung megcsinálj. Az NV is egy rájuk tervezett 8 nm-es variánst használ. -

Az uzleti partnereik, akik naluk gyartatnak, tokeletesen latjak, hogy az adott csikszelessegen mennyire rossz, illetve jo a kihozatal. A B2B semiconductor szegmensben, ha egy jol "felfuttatott" vevokorod van, teljesen felesleges az ilyen jellegu "vedekezes"...

Magyarra leforditva a Samunak edesmindegy, hogy joskapista azt gondolja esetleg naluk van a bibi az nV szeria eseten....

-

Abu85

HÁZIGAZDA

Az IBM magjai lényegesen erősebbek az ARM és az Intel/AMD magjainál. És a rendszerük teljesítménye is nagyon magas. Olyannyira, hogy nem igazán tudja őket közelíteni az ARM vagy az AMD/Intel. A probléma leginkább az, hogy nem x86/AMD64 az ISA.

1. Az Intelnél ezt bárki később tudja szállítani, még az AMD is. Hiába tud a Cray adni egy másfajta rendszert. A leggyorsabban akkor van meg az Aurora, ha az Intel szállít nekik TSMC-nél gyártott gyorsítót. Mindenki más csak lassabban tudja összerakni a rendszert.

2. Ez a projekt már eleve csúszik. Évek óta kész kellene lennie, csak az Intel törölte a Xeon Phit.

3. Az 3 év legalább. Ha csak a pénzen múlna, akkor már megkérték volna, de a chiptervezés problémája az idő. Ráadásul mire raknak CXL-t az A100-ba, addigra ez a lapka rég elavul, és sokkal újabb rendszerek lesznek kész. Ez nem olyan dolog, hogy kell a funkció, és az NV megoldja fél év alatt. Le kell ülni a tervezőasztalhoz, és egy csomó mindent ki kell cserélni a dizájnban, ami kb. egy év meló, majd két év mire azt tömeggyártásra alkalmassá teszik.

Az, hogy Addison Snell mit szeretne az irreleváns. A DOE meg azt szeretné, ha az Aurora 2022-ben működne, és azt csak az Intel tudja biztosítani. Minden más lehetőség további csúszás. Az AMD ezt nem fogja tudni vállalni 2023 előtt, az NVIDIA pedig 2025 előtt.

Mondjuk a top Ponte Vecchio eleve 40 TFLOPS-ra lő, tehát ha abból 30-35 jön össze, akkor az is elég jó még. Ráadásul az Aurora konfigurációja az 6 GPU-s, tehát 50 TFLOPS-ot egy szerver node TSMC-vel is tudni fog. Az AMD-nek a CDNA-ja 40 TFLOPS körüli. FP64 ezeknek a számoknak a fele. Az NVIDIA nem tudni, hogy hoz-e valamit az A100 mellé, mert az általános számításban nem valami erős, csupán 19,5/9,75 TFLOPS-ot tudnak vele FP32/64-ben.

-

szmörlock007

aktív tag

"Nvidia A100 és AMD MI100 vagy több év csúszás."

Hát meglátjuk, én azért még nem látom ennyire pesszimistán, jelen állás szerint 1 évet csúszik maximum, mint a 7nm, persze lehet további fennakadás. Persze ez mindenképp probléma az Usa-nak, mert lehet Kína pont ezért fog hamarabb exascale-es gépet építeni, de legalább hátha minden intel igazgatótanácsbeli tagban tudatosul, hogy egy tech cégnek állandóan fejleszteni kell gőzerővel.

Esetleg Amd építhet még egyet 2021-re ha nagy baj lenne

A Genoa meg a Cdna2 amúgy is 21 végére van ígérve. -

szmörlock007

aktív tag

Hát nem tudom elviszi-e valaki, utána úgyis jön 2 exascale gép fél-1 évvel, meg ha jól veszem ki akkor az Aurorát nem törlik csak csúsztatják, ergo Intel marad annak a beszállítója, persze ez változhat ha úgy van. Intel az egyetlen megmaradt Chip gyártó az Usa-nak, a másik 2 tajvani meg dél-kóreai, ergo nekik fontos lenne, hogy az Intel talpra álljon, mert elég nagy stratégiai hátrány lenne, ha a későbbiekben nem lenne legalább 1 amerikai cég fejlett gyártástechnológiával. Persze emellett a Tsmc-vel és a Samsunggal is eléggé baráti viszonyt kezdenek ápolni, biztos ami biztos. Nem hiába az Intel az első (vagy egyik első) cég aki szállíthat a Huaweinek. Kicsit támogatni fogják őket most ezt biztosra veszem.

-

-FreaK-

veterán

Én kérek elnézést, de a 3080 is kb. ugyan ott van perf/watt előre lépésben mint a 3090, nem lehet túl nagy a difi. Így aztán az idézett kijelentés megállja a helyét. Amennyivel gyorsabb lett, annyival többet is fogyaszt, illetve egy minimális javulás következett csak a be a kettő arányában. Ez ugyan úgy igaz a 3080-ra, mint a 3090-re.

-

Mumee

őstag

"3080 meg az egyik legjobb előrelépést produkálta még perf / watt terén is."

Az első képeden az "energy efficiency" oszlop, 2. képeden energy efficiency (perf per watt) sor.

2080ti 90,6% 3080 100% azaz kb. 10%-al jobb a perf/watt a 3080-nak.

A 3090 még jobb is ebben a vonatkozásban, hisz nem igazán fogyaszt többet, de gyorsabb így ki is jön a Malibu képen a 13% a 2. képén 2080ti vs 3090 perf/watt.Malibu 1. képén pedig csak teljesítményugrásról van szó.

A 3090 FE kb. 46%-al erősebb, mint a 2080ti FE.

Az általad linkelt 2. képen alul lehet következtetni a 4K és 4K+RT 3080 vs 2080ti eredményekből, ami 31% és 40% átlagolva 35,5% és a 3090 egy ~10-15%-ot ver a 3080-ra.

Így a 46% 2080ti vs 3090 a Malibu ábráján megint csak korrektnek nevezhető. -

Abu85

HÁZIGAZDA

Olyan nincs, hogy 98%-os terhelés. Az maximum azt jelenti, hogy a parancsmotor a 100 ciklusból 98-ban beolvas valamilyen parancsot. De belül azt nem úgy dolgozza ám fel. A GPU-n erősen heterogén processzorok, tehát nagyon sok az üresjárat bennük, és ezeket afterburner nem fogja megmutatni. Érdemes inkább megnézni egy profilozóval, ott azért közel sem az látszik, hogy 98%-os a terhelés. Jó ha 50% megvan.

Minden dizájnnak van egy optimális hatékonysága, ahol arányaiban a legnagyobb teljesítményt adja le a fogyasztáshoz viszonyítva. Ezek gyártói döntések, hogy hogyan állítják be.

Például az AMD ezzel azért nem törődik annyira, mert ma már teljesítménytartományt szállítanak a Radeonokban. Van egy közepesre állított szint, amiből a power limit beállítással elérhető a legnagyobb hatékonyság és a legnagyobb teljesítmény is. A felhasználó egy -50 és +50 százalék közötti csuszkával kiválaszthatja, hogy mit akar. Általában -10-20% között van az optimális hatékonysági szint, de ez termékfüggő, valamelyiknél 12%, valamelyiknél 18%. Ezt azért vezette be az AMD, mert ezernyi igény létezik, és ezt csak teljesítménytartomány felkínálásával fedhetik le. Mindenki beállíthatja azt, amit magának akar.Az NVIDIA ezt még nem vezette be, de az Ampere már tett lépéseket felé, tehát később valószínűleg ők is bevezetik ezt a tartományos modellt, csak ahhoz még szükségük van arra, hogy gyorsabban váltson az órajellépcsők között a dizájn. Valószínűleg a következő körben elérik. Az Ampere annyiban előrelépés, hogy teljesen hardveres lett az órajel- és feszültségmenedzsment, tehát már nincs benne szoftveres tényező.

A gyártástechnológiát könnyű hibáztatni, de az esetek nagy részében nem ott van a gond.

Az undervolt azért nem ajánlott, mert a gyártók a beállításokat nem a programokra nézik, hanem egy szimulációra. Ez a szimuláció bekapcsol minden részegységet a lapkában, tehát egy eléggé worst case mérés. Egy játékban azért működik az undervolt, mert a legtöbb játék közel sem túráztatja a GPU-ban található összes részegységet. Egy adott pillanatban jó ha a teljes lapka 50%-a be van fogva. De ugye jöhet egy olyan feldolgozás, ahol be lesz fogva a 80%-a is, és akkor bizony az undervolt megadja magát, mert ahhoz az a feszültség kellene, amit a gyártók beállítottak, csak a felhasználó nem engedi elérni.

Ez ellen egyébként a Navi már védekezik. Ha túl kevés a feszültség, akkor nem fagy bele a munkába a GPU, hanem indít a rendszer egy fail-safe módot, ami azt jelenti, hogy a GPU az órajelet levágja 500 MHz körülire. Ezért van az, hogy ha valaki undervoltol egy Navit, akkor nő a mikroakadások száma, mert már nem fagy bele az alacsony feszültségbe a rendszer, de harmadolja a teljesítményt arra az időre, amíg a feszültséget alacsonynak tartja. -

Petykemano

veterán

Na várj

Azt akarod mondani, hogy ahelyett, hogy a legjobb minőségű, legjobb eredményeket hozó lapkákat az Nvidia saját kézből adva prémiumot tenne zsebre,

ezúttal a legjobb minőségű lapkákból egy kiváló minőségű hűtővel rendelkező kártyát árul úgy, hogy a ténylegesen boltban kapható termékek ennél vagy rosszabbak, vagy drágábbak lesznek?

-

Petykemano

veterán

"Nvidia sees an opportunity to sell its AI chips and graphics chips to Arm’s customers, too. “If we could leverage their business model, if we could stand on the network they’ve created and take the technology we’ve invented and put it into that channel and make it available to their thousands of partners, the economics for us would be incredible,” Huang said. "

-

Petykemano

veterán

"Egy komplett ökoszisztémát kialakítani"

De ezt megtehették volna akár magok, akár az ISA licelcelésével. Az apple és ígéretben a nuvia is olyat csinál, ami meghaladja az x86 lehetőségeit, de arm alapon bárki utánuk csinálhatná, de nem az arm csinálta ezért nem áll mindenkinek rendelkezésére.

Mindezt úgy, hogy nem kellett hozzá megvenni az armot.Ha az arm az ISA vagy más miatt tényleg jobb, mint az x86 és nyitott marad, akkor bárki más utánacsinálhatja arm alapon. Tehát máris nem annyira zárt. Gyorsítót meg adhat akár az amd akár az Intel CCIX vagy CXL alapon. Kivéve persze ha itt is zárás történik, de akkor azzal minden más gyorsító is kizáródik, (PEZY)

De szerintem ehhez nem kéne megvenni az armot.Tehát a célt értem, amit mondasz és egyet is értékek vele, azt az okot keresem ami miatt muszáj volt a felvásárlás, nem volt elég az ISA.

Pl ha az ISA felett akar kontrolt gyakorolni, mondjuk valahogy integrálni az arm ISAba a CUDA-t? Vagy kikúrni a CCIX-et és az NVLInket szabvánnyá tenni. És akkor ha arm szerverprocit gyártasz, akkor ahhoz vagy nvidia gput veszel,.vagy licenceled az nvlinket (pl FPGA gyártók)

-

szmörlock007

aktív tag

-

Malibutomi

nagyúr

Tudom mit jelent...azt is mind tudjuk hogy az NV azert irta ki szep nagy betukkel hogy a hozzanemertoket beeetessek..az hogy nezett volna ki a dian hogy 8nm process. 0% improvement in perf/watt?

Megegyszer..a negativ velemeny is megoszthato a forumon, aert forum. Ha jon eg hir leirom a velemenyem. Ujfent bocsanat hogy rosszat mondtam a tevedhetetlen nvidiara, gyorsan gyujtok ertuk egy gyertyat

-

Malibutomi

nagyúr

Bocs hogy leirom a velemenyem, miutan az NV elvileg jobb node-ra elorelepve meg 1.9X perf/wattot belengetve a diakon az eddigiek alapjan gyakorlatilag annyi javulast ert el hogy a kartyak pont annyival tobbet fogyasztanak mint amivel gyorsabbak.

Elnezest hogy csunyat mondtam a balvanyodra igerem tobbet nem teszem.

-

TTomax

félisten

Háát...távol álljon tőlem bárki megvédése,de ez a VS topic ahol a fanyalgásoknak igenis helye van.

Valóban nem tett jót a samsung 8nm-e a perf/wattnak viszont az már így előre meg merem jósolni,hogy brutálisan húzhatóak lesznek ezek a kártyák,illetve lehetnek mert nekem nagyon úgy tűnik,hogy a 3080 ismét olyan power limites lesz,hogy csak a shunt mode segít rajta,már aki bevállalja,mert a bios lockolva lesz az máris borítékolható.Egy vga lesz csak ahol engednek mindent,és az a 3090 brutál áron (hogy klasszikust idézzek qrva gyors lesz qrva drágán

)... arra nem is lesz az AMDnek kb semmiféle válasza,de oda a 3070/3080köré megérkezhetnek...persze csak mire már mindenki bevásárolt...

)... arra nem is lesz az AMDnek kb semmiféle válasza,de oda a 3070/3080köré megérkezhetnek...persze csak mire már mindenki bevásárolt... ![;]](//cdn.rios.hu/dl/s/v1.gif)

-

do3om

addikt

A fogyasztással pl Amd esetén nem az volt a baj hogy sok. Senkit nem érdekelne, árban minimális ha 100w a különbség a villanyszámla esetén.

A gond a kártyákkal volt, pl amikor azt gondolta elég a 6pin, itt gond volt a fogyasztás, de csak mert elbaszta. Aztán több karinál is a tuning, nem bírta hüteni semmi, de ha megoldották volna ezt senkit nem érdekel hogy zabál csak menjen. Aztán az alulméretezett gyári hűtések meg a magyarázkodás meg Abu féle mosdatás hogy 100 fok felett hatékonyabb a vrm. Na az ilyen nevetséges dolgok miatt lett fontos a fogyasztás, de ha úgy tervezik hogy bírja nem nézné senki.

Ha netán most az nv kari fogyaszt majd 350w-ot de az a tégla hűtő megoldja, nem szenved miatta hátrányt, netán húzni is lehet és 400w sem okoz gondot akkor elnézzük a fogyasztást. Persze Amd fanok jönnek majd hogy most is legyen fontos, de még kell érteni hogy az ottani karikon sok gondot okozott ahogy azt írtam. -

Jacek

veterán

Nade akkor ütötted az AMD a fogyi miatt, ez olyan mint 10 év fidesz után elmúltnyolcvévezni mert gyurcsány

Akkor is leszartam a fogyasztást meg most is Tőlem jöhet a tégla kerti grill, az jobban zavar hogy 600k lesz..... a 3080-at meg tolják rá a Ti-re... Mondjuk nem érint mert mindenféle képpen megvárom az AMD-t.

Tőlem jöhet a tégla kerti grill, az jobban zavar hogy 600k lesz..... a 3080-at meg tolják rá a Ti-re... Mondjuk nem érint mert mindenféle képpen megvárom az AMD-t. -

paprobert

őstag

A skálázódás tök jó dolog, de kapsz is cserébe valamit felhasználóként?

Sajnos ezt nem lehet egyetlen számba besűríteni, de a motorok között jelentős különbség van a "mit csinál / gépigény" mutatóban.

Mivel nem számszerűsíthető ez, így csak véleményeket lehet formálni, de pl. a R6 motorja az egyik legjobb ebből a szempontból. Alacsony a hardveres belépési küszöb, sok mindent nyújt, skálázódik is.

Ha csak az utolsó pont van meg, az baj.

-

Abu85

HÁZIGAZDA

Most az atmoszféra az nekem is tetszik. Azzal nincs bajom, sőt... csak a tartalmat hiányolom. De lehet, hogy én hamar feladom. A harcnak egyébként nem látom értelmét. Inkább kikerülöm az ellent. Lehet, hogy itt hibázok?

Az a baj, hogy jó néhányszor megaláztak már.

Az a baj, hogy jó néhányszor megaláztak már.

(#41433) Laja333: A Death Stranding kinézete koncepcióból sivár. Ezt nem lehet felróni neki, mert valahogy bele kellett rakni a játék dizájnjába a reménytelenséget, és ezt a legjobban egy kihalt és élettelen táj szemlélteti. Ilyen szempontból a Death Stranding egyáltalán nem rossz, inkább más. Az való igaz, hogy az ember számára egy paradicsomszerű táj sokkal szebb lesz, mint a Death Stranding pusztasága, de ha objektíven nézzük a grafikát, akkor nagyjából ugyanott vannak, csak a HZD-be a dizájn miatt sokkal nagyobb részletesség kell.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Víztisztító berendezések - kancsók - szűrőbetétek

- Bemutatkozott a Poco X7 és X7 Pro

- Kezünkben a OnePlus 15 és az Oppo Find X9-ek

- Assassin's Creed: Valhalla

- Gitáros topic

- Linux kezdőknek

- Luck Dragon: Asszociációs játék. :)

- Kormányok / autós szimulátorok topikja

- OLED monitor topic

- Diablo IV

- További aktív témák...

- XFX Quicksilver AMD Radeon RX 7800 XT Magnetic Air - Arctic White - Alza garancia 2028.02.25.

- GIGABYTE AORUS Radeon RX 580 8GB - MINDEN TARTOZÉKÁVAL.

- MSI RTX 3060 VENTUS 2X OC 12GB - GARANTÁLTAN KIVÁLÓ ÁLLAPOT! - 30 nap próbagarancia!

- Eladó erős 1080p Gamer konfig Gamer monitorral

- ASUS ROG STRIX RTX 3070ti OC EDITION

- Bontatlan iPhone 14 (128 GB) (rendelhető)

- Motorola Edge 40 / 8/256 GB / Kártyafüggetlen / 12Hó Garancia

- Telefon felvásárlás!! iPhone 12 Mini/iPhone 12/iPhone 12 Pro/iPhone 12 Pro Max

- MacBook Pro 13, 14, 15, 16, MacBook Air M1, M2 M3 M4 bill magyarosítás lézerrel / sapkacserével

- Bomba ár! HP Elite X2 1013 G3 - i7-8650U I 16GB I 512SSD I 13" 3K Touch I Cam I W11 I Garancia!

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Cég: BroadBit Hungary Kft.

Város: Budakeszi

a teljes park csúcson olyan 500MW fogyasztásra képes . Szal Paks csúcson 4db ilyet bírna el ami a Magyar energiatermelés felét adja ....

a teljes park csúcson olyan 500MW fogyasztásra képes . Szal Paks csúcson 4db ilyet bírna el ami a Magyar energiatermelés felét adja ....

![;]](http://cdn.rios.hu/dl/s/v1.gif)