Intel backs out of $5.4 billion deal to buy Israeli firm Tower Semiconductor

Chip giant to pay $353 million to terminate acquisition after reportedly failing to receive okay from Chinese regulators as demanded by contract

Intel backs out of $5.4 billion deal to buy Israeli firm Tower Semiconductor

Chip giant to pay $353 million to terminate acquisition after reportedly failing to receive okay from Chinese regulators as demanded by contract

Ha valakinek kellene info.

Intel DG1 működik akár milyen lapban és procival. Kamu volt amit kezdetben írtak. (Vagy csak az Asus féle volt ilyen limittel?)

Persze gondolom itt keveseket érint, pedig a legolcsóbb kapható kártya (ebay, ali 20-30eft)

Drivere ugyan az mint a többi intelesnek.

Gpuz össze vissza ír mindent.

Gpuz össze vissza ír mindent.

Hw infó is baromságokat ír, nem a max verzióm van.

[ Szerkesztve ]

Vintage Story PH szervere újra fut!

integráltra képet kötve lehet játék gyorsítóként használni ezt az intelt?

Lehet, én sem a saját kimenetével használom hanem az a770-esen keresztül és kézzel választottam ki melyik progival menjen. Bár ez win10/11 feature.

[ Szerkesztve ]

Vintage Story PH szervere újra fut!

Ez elég cool, gondolom a konkurrens gyártók kártyáival is így működik.

Egy kis érdekesség:

A Desperados 3 készítőinek új játéka, a Shadow Gambit: The Cursed Crew című játékot is letesztelte a CB.

Motor: Unity

API: DX11

Felskálázás: -

RT: -

A játék finoman fogalmazva rendkívül igénytelen, ami alatt azt értem, hogy piszok gyors, a sebesség igazodik a vizuális megjelenítéshez (nem igényel erős hardvert), teljesen korrekt (RTX 4080 nyaldossa a 400 fps-t), egy RX 580 vagy GTX 1060-as elegendő a 1080p max grafikához stabil 60 fps-el.

VRAM igénye is rendkívül alacsony: 1080p és 1440p felbontáson is legendő a 4 GB, 4K felbontáson "már" 6 GB kell.

Nagyon szépen skálázódik a sebesség a Unity motorral, viszont Vega 64 és RX 5600XT tempójával súlyos problémák vannak, az a kettő pocsék tempót ad valamiért.

Ampere-nak ebben a játékban a 4K különösen jól fekszik.

[ Szerkesztve ]

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

(#47009) MasterDeeJay válasza MasterDeeJay (#47006) üzenetére

[Starfield To Get NVIDIA DLSS 3 & DLSS 2 Mod Support On PC At Launch, Confirms PureDark]![;]](http://cdn.rios.hu/dl/s/v1.gif)

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Nem tudom, hogy AMD-nek miért éri meg az alapból nullához konvergáló eladásait szándékosan még tovább csökkenteni.

ez nagyon eros

a tobbi, korabbi problema kb rushed production. Linuseknal korabban is voltak hulyesegek, amik altalaban azert megmagyarazhatoak voltak a "kiprobaltuk, hogy neked ne kelljen" kiserletezo mindsettel.

Don't dream it, be it. // Lagom amount.

Ezzel húzással eléggé kifogják a szelet launchkor az FRS 3.0 vitorlájából (már ha jön).

Illetve érdekes lesz az összehasonlítás a kettő között.

[Intel Releases PresentMon with a User-friendly Interface]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Korrekt, felrakom. Msi afterburner úgyis bugos volt nálam.

Vintage Story PH szervere újra fut!

Hát ez ( is) szarul sikerült, főleg UE5 bemutatónak.

[Immortals of Aveum Disappoints as Unreal Engine 5’s True Debut]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Lesz az még jobb is, bár engem nem vonz ez a játék. Én is linkelek 1 videót ha nem gond:

AZ ELSŐ AAA UNREAL ENGINE 5 JÁTÉK MEGÉRKEZETT!! :O | Immortals of Aveum (4k60fps) #ue5 #unrealengine - YouTube

[ Szerkesztve ]

Az új Forza Motorsport kap DLSS 2 és FSR 2.2 támogatást, továbbá CPU alapú DirectStorage is lesz:

"We’ve optimized Forza Motorsport to look and play great across a wide range of PCs, taking advantage of cutting-edge PC hardware and technologies with real-time ray tracing on-track and maximum performance enabled by NVIDIA DLSS 2 and AMD FSR 2.2. We will continue to optimize and improve Forza Motorsport on PC after launch.

Forza Motorsport on PC supports native resolutions up to 4K and beyond, including ultrawide resolutions during on-track gameplay, HDR calibration, shader pre-compilation and pre-caching, DirectStorage for improved CPU loading, unlocked single-player framerates with or without V-Sync enabled, and more."

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

Ha a fake frame be van kapcsolva, tépődik a kép.

#tarcsad

Ennyit sikerült észre venned a videóból?  Szerintem nem az a lényeg, hogy ki hogyan fejezi ki magát. Azért linkeltem mert UE fejlesztő, játékokat készít, így többet ért hozzá mint a fórumokon a sok agyoniskolázott fotelharcos.

Szerintem nem az a lényeg, hogy ki hogyan fejezi ki magát. Azért linkeltem mert UE fejlesztő, játékokat készít, így többet ért hozzá mint a fórumokon a sok agyoniskolázott fotelharcos.

Amd-nek asszem fel kell kötnie a gatyát. Bár nekem nem tetszik ez az irány. De nV nagyon nyomul a témában. DLSS 3.5

Úgy gondolom, hogy az AMD-nek már mindegy. Sajnos már nem tud tenni semmit, mert akkora a lemaradása és ez a piacnak nagyon rossz lesz.

[ Szerkesztve ]

"A wise man can learn more from a foolish question than a fool can learn from a wise answer." - Bruce Lee

Ha igy haladnak 2 generacio mulva mar az Intel dedikalt VGA-knak is nagyobb lesz a piaci reszesedesuk mint az AMD-nek ami van.

Nem ertem miert jo ez nekik.

Oke ertheto a konzolos vilag az oveke, de jo lenne nem elfelejteni a gamereket sem.

[ Szerkesztve ]

...

Pletyka, de elvileg az RDNA4-el meg sem próbálják majd a high endet meghódítani. Olyan lesz, mint az RDNA1, 5700XT toppal.

Piacot csak ilyen 300-600$ közti kártyákkal lehet.

¡GLORIA A LAS PLAGAS!

Ez az új Unreal Engine 5 játék szépen beárazta, hogy mit is kapunk a pénzünkért VGA fronton. Nagyon keveset.

[link]

RTX 4060 1080p Low 60-70 fps

ARC A750-nek ugyanehhez a sebességhez már FSR kell.

GTX 1060 - nincs olyan grafikai beállítás amivel játszható, performance FSR-ral sem.

RX 6700XT 80-90 fps, (Ultrán van 60fps.)

[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

Szokásos ratyi optimalizálás, majd egy 5 patch után jó lesz

Sajnos ott sem kapkodnak nagyon.

Lassan egy eve van kint az RDNA3 , erre talan most jon a 7800XT ami vagy tud vagy nem annyit mint a 6800XT.

Es ez lesz a 300-600 dollaros savban.

...

Nem. Ez Unreal Engine 5  Más UE5 játékoknak is hasonló a gépigénye, pl. a Remnant 2 jelenleg 5 patch után se fut ennél jobban.

Más UE5 játékoknak is hasonló a gépigénye, pl. a Remnant 2 jelenleg 5 patch után se fut ennél jobban.

[ Szerkesztve ]

Akkor a drága unreal5-höz majd 5090 kell 3000$-ért, vagy 1080P-hez egy 4090, teljesen reális

Amúgy meg annyira nem is látványos a grafika

Azt sem mondhatjuk szerintem rá, hogy rosszul fut. 4090-en 4K Ultrán megvan a 60fps  Élőben, tehát nem YouTube videón keresztül azt mondják, hogy jóval jobban néz ki.

Élőben, tehát nem YouTube videón keresztül azt mondják, hogy jóval jobban néz ki.

Egyébként meg a szintén UE5-ös Black Myth Wukong-on YouTube-on keresztül is látszik, hogy egyértelmű grafikai előrelépés. Ezzel a kinézettel én elfogadom a gépigény növekedést.

[ Szerkesztve ]

Sajnos ez sem úgy néz ki már mint a legelső videókon

[ Szerkesztve ]

Ezt remélem viccnek szántad. Ez a játék átlagosan néz ki, úgy ahogy.

Egy RTX 4090 kártyán éppen tud 60 FPS-t ez azt jelenti hogy az AMD legerősebb kártyáján tud kb 45 FPS-t natívban. Ilyen közepes grafikával. Fogalmam sincs mit látsz benne de ez a játék szar és optimalizálatlan és nem is néz ki jól.

Mi előnye van így a nanite/ lumken technológiának a RThez nézve?

Black myth meg kap majd megjelenésig 20 downgradet.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

ami savban prev gen van eddig ebben a generacioban

igazabol nem tudom mi volt a terv. a 7900XT 850 euro alatt utobbi harom evet elnezve nem rossz vetel, de az idei ev maradek resze kb ertelmezhetetlen eddig.

b.: ja, ez igy fejlesztoi reszrol nem oke, nem lesz, aki megvegye.

[ Szerkesztve ]

Don't dream it, be it. // Lagom amount.

Az emberek a "halo product" után sóvárogva veszik meg általában a márkán belül, de a pénztárcának megfelelő terméket. "Ha nincs 4090, akkor jó lesz a kistesó is" elven.

Pusztán középkategóriás termékpalettával lényegében azt üzeni az AMD, hogy elengedték a versenyt.

Még benézhet ide is egy Ryzen-szerű újjáéledés, de nem sok esélyt látok rá.

Az Intel nem tudom hogyan csinálta. Én egyszerűen semmi okot nem látok arra, hogy miért venne bárki is Intel kártyát, de mégis jön fel...

nezd meg az A770 eredmenyeit. 400 euroert ahol jol megy, ott kb otvozi a 6800 es a 3070 elonyeit (16GB es RT), csak sokkal olcsobban. fele annyiba kerul, mint a 7900XT, es majd harmadaba mint a 4080 amik ugyanezt valamennyivel jobban tudjak, csak driveresen kiforrottan.

gyakorlatilag vicces, mert 400 euro korul egyedul az Intelnek van vallalhato termeke.

4070/TInel a 12GB memoria a problema, AMDnel meg a 6950XT is csak raszterben eros. 7800XT start holnaputan lesz erdekes.

[ Szerkesztve ]

Don't dream it, be it. // Lagom amount.

"fele annyiba kerul, mint a 7900XT, es majd harmadaba mint a 4080 amik kb ugyanezt tudjak, csak driveresen kiforrottan."

ugyan ezt tudják?

A 4080 kb 2 x erősebb de vannak játékok ahol 3x FG nélkül. Az ARC 770 kb a 4060 / ti kategóriájában játszik. Amúgy szerintem sem rossz kártya.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

atfogalmaztam kozben, kicsit rossz volt: ha legalabb ennyit akarod, hogy tudjon a konkurencia minden helyzetben, az a 4080 es a 7900XT. ez akkor is igy van, ha a 4080 gyorsabb a 7900XTnel.

szerk: igen, a 4080 sokkal gyorsabb, a 4060ti viszont inkabb csak a 8GBs modellnek az ellenfele.

4070/TI bukik a 12GB memorian, 6800/69x0 bukik a hullamzo RTn.

[ Szerkesztve ]

Don't dream it, be it. // Lagom amount.

Szerintem ahova elég az ARC 770 teljesítménye szerintem ott nem bukik el semmi a12 GB memórián.

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

nem vagyok benne teljesen biztos, ld Hogwarts.

HL:Alyxban se vagyok biztos, hogy nem fut memoria limitbe. 5700XT ott kifutott a 8GBbol ugy, hogy egyebkent a GPU meg siman birta volna egy Oculus CV1el is.

hosszabb tavon azert az A770 lehet jobban fogja birni, es megiscsak egy sokkal olcsobb kartya. 4070 elegge felemas lett architekturalisan.

---

mondjuk igazabol a kerdes, hogy mire jutnak a battlemageig. nemi verseny nem artana

[ Szerkesztve ]

Don't dream it, be it. // Lagom amount.

Szerintem ami még mindig a “keresem az állam” kategória a The Last of Us Part 1 PC-n. Natív 2160p render, minden felhúzva High és Ultra 70-100 fps RTX-4090-el. Ez az elfogadható. Várom a Part 2-t is PC-re, ott amúgy több a nagyobb tér, kevésbé csőjáték.

De a Cyberpunk is jól néz ki, várom a Patch 2.0-t és a PL-t.

Amúgy az biztos, hogy a kisebb Ada kártyákat megöli a kis sávszélesség UE5-nél… trükköztek a számozással, minden egyel magasabb néven fut, mint kéne és hiányzik a vágott AD102.

¡GLORIA A LAS PLAGAS!

egy egész jó teszt RX 7900 XT vs RTX 4070 Ti, 44-Game Benchmark | KitGuru

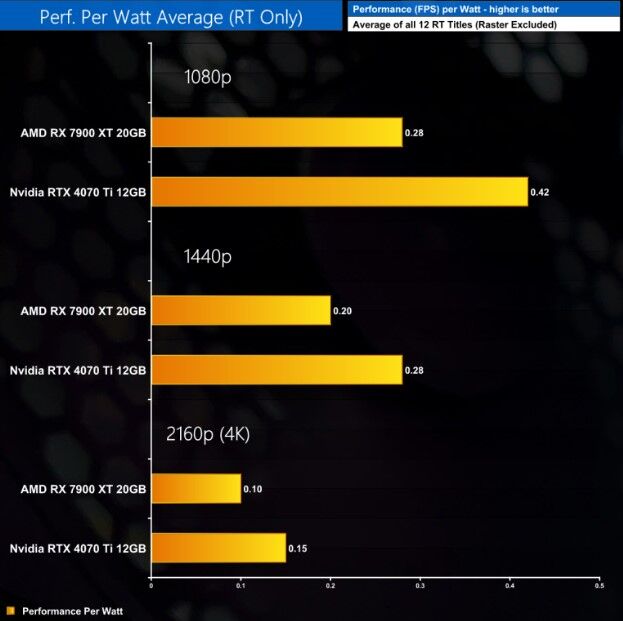

két eredményen akadt meg igazán a szemem:

Rt p/w 40/50% a 4070 Ti előnye a játék megjelenésekor 4k-n kevés volt a 4070 Ti 12GB Vram-ja. mostanra elég látványos a javulás

a játék megjelenésekor 4k-n kevés volt a 4070 Ti 12GB Vram-ja. mostanra elég látványos a javulás

Az eddigi egyik legjobb VGA generáció lehetett volna a zöldek történelmében az Ada, ha Nvidia nem tolja el a szinteket.

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Ebben a generációban az AMD és az Nvidia is eltolt valamit.

Találgatunk, aztán majd úgyis kiderül..

Szerintem mindkét generáció rendben lenne, kivéve az árakat...

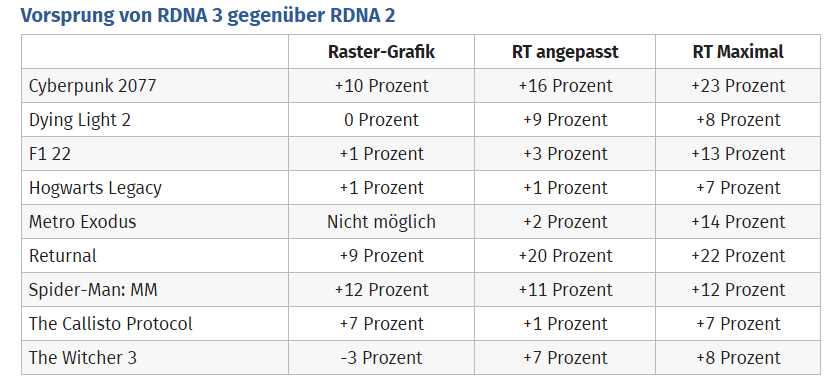

megjelent egy CB teszt elég érdekes eredményekkel, amiben összehasonlítja az előrelépést az architektúrák között.

[link]

Raszterben 10 % csak az előnye de RT ben jobb a helyzet visszafogott RT vel 16 %, magas/ megterhelő RT vel 26 % az előnye az RDNA3 nak.

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

AMD announces Radeon RX 7800 XT 16GB and RX 7700 XT 12GB graphics cards

7700XT picit jobb mint amire szamitottam, de majd elb@ccak az arazast ugyis.

...

Avatar: Frontiers of Pandora - PC Features Trailer

Úgy tűnik az AMD az Ubi-val is exkluzív szerződést kötött, kizárólag FSR 2 lesz a felskálázó technikák közül, a többit itt is blokkolni fogják, mint a Starfield-ben.

Ez igencsak szomorú, mert pont ebben a játékban óriási igény lenne a DLSS nyújtotta temporális stabilitásra, hiszen itt brutális mennyiségű növényzet lesz, ami ugye vékony geometriából áll legfőképp. Nem csak én gondolom így, érdemes vetni egy pillantást a komment szekciókra, igen sokan panaszkodnak a DLSS hiánya miatt, nem véletlen.

Már csak egy kérdésem van: miért nem FSR 3 lesz a játékban? Decemberig még van idő és egy ilyen kaliberű játékban kellene megmutatni, hogy mit tud az új technika, ha már minden konkurens technikát kizártak. Starfield után egy újabb teljesen érthetetlen és logikátlan húzás.

Mi a logika a mögött, hogy az új technológiát, konkrétan az FSR 3-at nem a nagy kaliberű játékokban hozzák be először, hanem olyan felejthető alkotásokban, mint a Forspoken, amivel már a kutya se játszik, illetve az olyan technikai katasztrófákban, mint az Immortals of Aveum? Nem értem.

Valamiért az AMD pont az ellenkezőjét teszi annak, ami logikus lenne és ami segítené az új FSR népszerűsítését. Vajon annyira rossz/félkész állapotban van még az FSR 3, hogy csak fos PC játékokba merik először berakni? Gondolom itt a Gamescomon fel kell mutatni valamit a marketingeseknek, hogy van olyan, ami megkapja az új FSR-t, csak a nagy kérdés, hogy miért nem a legnagyobb projektek, amibe az AMD a legtöbb pénzt ölte?

Nem tudok másra gondolni józan paraszti logikával, minthogy az FSR 3 jelenleg még nincs olyan állapotban, hogy nagy projektbe bekerülhessen. Más magyarázatot nem látok.

Csak ez így a DLSS 3.5 bejelentés után finoman fogalmazva nagyon gáz.

Ez sajnos előrevetíti azt a nagyon valószínű forgatókönyvet, miszerint a jövőre megjelenő Star Wars Outlaws is majd AMD exkluzív lesz és ott is blokkolva lesz a DLSS és XeSS. Mivel az a játék is ugyanazt a motort fogja használni és ugye (sajnos) az AMD az Ubi partnere, így szerintem ez borítékolható.

[ Szerkesztve ]

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.