- Fórumok

- Videokártyák

- AMD GPU-k jövője - amit tudni vélünk

- (kiemelt téma)

- Brogyi: CTEK akkumulátor töltő és másolatai

- Luck Dragon: Asszociációs játék. :)

- sziku69: Fűzzük össze a szavakat :)

- bitpork: Meglátjuk mit hoz a jövő

- bambano: Bambanő háza tája

- gban: Ingyen kellene, de tegnapra

- Sub-ZeRo: Euro Truck Simulator 2 & American Truck Simulator 1 (esetleg 2 majd, ha lesz) :)

- lkristóf: Prohardver fórum userscript – hogy lásd, mikor neked válaszoltak

- Luck Dragon: Utazásra tervezve – Anker Zolo gallium-nitrid töltő

- D1Rect: Nagy "hülyétkapokazapróktól" topik

-

Fórumok

LOGOUT - lépj ki, lépj be!

LOGOUT reakciók Monologoszféra FototrendGAMEPOD - játék fórumok

PC játékok Konzol játékok MobiljátékokPROHARDVER! - hardver fórumok

Notebookok TV & Audió Digitális fényképezés Alaplapok, chipsetek, memóriák Processzorok, tuning Hűtés, házak, tápok, modding Videokártyák Monitorok Adattárolás Multimédia, életmód, 3D nyomtatás Nyomtatók, szkennerek Tabletek, E-bookok PC, mini PC, barebone, szerver Beviteli eszközök Egyéb hardverek PROHARDVER! BlogokMobilarena - mobil fórumok

Okostelefonok Mobiltelefonok Okosórák Autó+mobil Üzlet és Szolgáltatások Mobilalkalmazások Tartozékok, egyebek Mobilarena blogokIT café - infotech fórumok

Infotech Hálózat, szolgáltatók OS, alkalmazások SzoftverfejlesztésFÁRADT GŐZ - közösségi tér szinte bármiről

Tudomány, oktatás Sport, életmód, utazás, egészség Kultúra, művészet, média Gazdaság, jog Technika, hobbi, otthon Társadalom, közélet Egyéb Lokál PROHARDVER! interaktív

-

Frissítve: 2024-08-23 16:13 Téma összefoglaló

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

b.

félisten

b.

félisten

-

Busterftw

nagyúr

Busterftw

nagyúr

-

S_x96x_S

addikt

S_x96x_S

addikt

> Senki nem gondolja, hogy a 30gb kihasznalhato lesz,

Szerintem még a 128GB is kihasználható lenne ...

![;]](//cdn.rios.hu/dl/s/v1.gif)

pl. egy egyszerű "butuska" AI modell

pl, nvidia - https://huggingface.co/nvidia/NVIDIA-Nemotron-3-Nano-30B-A3B-FP8

~ 15GB -ot ( a VRAM felét ) elfoglalja.és az AI a jövő .. elég az nvidia demóit megnézni.

-

Alogonomus

őstag

Alogonomus

őstag

PS6-ról beszélünk, szóval a Microsoft konzoljainak a memóriaigénye teljesen irreleváns a téma szempontjából.

Azt pedig egyikünk sem tudja, hogy a ps6 végül a szintén csak pletykált 30 GB-ból mekkora részt biztosít majd a játékszoftverek számára. A hozzászólásom lényege az, hogy a pletykált 30 GB nem azt jelenti, hogy a PS6 játékok akár csak megközelítőleg is a teljes 30 GB memóriát felhasználhatják majd, aminek következtében már a 16 GB-os kártyák érvényességi ideje is lejárna a ps6 érkezésével, ahogy azzal Yutani humorizált. -

PuMbA

titán

PuMbA

titán

"Elfogadhatnad, hogy nincsenek meg ott, ahol szeretnek, hogy legyenek, a piaci reszesedesben meg plane."

Ez el van fogadva, de hogy az RDNA4 nem sikerült volna jól az előző generációkhoz képest és ne dolgoznának keményebben a szoftveres részen, mint az RDNA2 és RDNA3 időkben...két negyedéve robban felfele az AMD bevétele és 2025Q4 is jó lesz, hogy most már beállít MSRP árra USA-ban is: AMD Radeon RX 9070 XT finally reaches $599 MSRP in the US, eight months after launch. Illetve be is esett akció keretében: Radeon RX 9070 XT Drops to Just $579.99 — Below MSRP

Busterftw: Az RDNA2-nek tök egyszerű helyzete volt a bánya miatt.

-

b.

félisten

b.

félisten

-

Busterftw

nagyúr

Busterftw

nagyúr

Leirtam es tisztaztam, hogy hogy ertettem a hsz-em, ezek objektiven ugyanugy fennallnak.

Nem kevertem ide semmi mast, az elmult generaciokban kollektive minden benne van amit kulon is kiemeltem."akiknek a hozzaszolasa csak gerjesztesre jo"

Ezek lennenek a bizonyos hopium kommentek. Mert ha ezek az userek raszannanak 2 perc utanajarast, akkor nem irnanak marhasagokat es hasrauteseket.

Na latod pont ezek a szubjektiv, wishfulthinking kommentek a karosak."Nem kell mindig mindenre megjegyzest tenni, ha nem tetszik valami. "

Jo reggelt, ez a publikus forum. Objektiv cafolat, az nem "megjegyzes". -

Busterftw

nagyúr

Busterftw

nagyúr

Nem fogalmazom meg maskeppen, az elmult generaciokrol volt szo es arrol, hogy az AMD-nel a consumer gpu szegmens a prioritasi lista legvegen van.

Ezt mutatjak a konkret termekeik, a szoftveres feature-k mar generaciok ota.

Azt mutatjak, hogy letolt gatya es futnak az Nvidia utan.

Ide tartozik az RT felskalazas stb. Ha valamivel nem ertesz egyet akkor inkabb aruld el miert, de ez a "nincs igazad mert nincs igazad" ervelest inkabb hagyjuk.Ez a hozzaallas teljesen visszakovetheto, a piaci reszesedes alakulasan szepen latszik, ahogy generaciok utan atlag 35%-rol 6-12%-ra csokkent, mert szartak bele.

Bealltak arazasban az Nvidia moge es hatradoltek."Nem a hasrautott hopium komment a hibas azert, ahogy fogalmazol."

Amit irt, tenyszerien nem igaz. Ez hasrautott komment aminek semmi alapja nincsen a piacon, se a teszteken. -

X2N

őstag

X2N

őstag

-

Busterftw

nagyúr

Busterftw

nagyúr

Altalanossagban beszeltem az consumer GPU-krol, hiszen erre reagaltam, azt irtam, hogy az AMD-nel nem prioritas mar tobb generacio ota.

Ebbe beletartozik az RT, a felskalazo es minden ami ebben a par generacioban megjelent.Az AMD-t az RT ota minden letolt gatyaval erte es futott a sajat megoldasaival az Nvidia utan.

"Plusz nem azt irtad, hogy jobb minosegben, hanem jo minosegben"

Igen, jo minoseget produkaltak, mig az AMD megoldasa ehhez kepest nem es azota tart a lemaradas. Vannak erre konkret tesztek amik kihoztak ezt a konkluziot.Mellesleg rossz oldalrol kozelited meg, mert ha nincs hasrautott hopium komment, akkor nem kell objektiven korrigalni sem.

-

Busterftw

nagyúr

Busterftw

nagyúr

"Ez igy ebben a formaban nem teljesen igaz. Tobb fejlesztest hoztak, de legtobbjuk zart."

A zart es a minoseg nem zarja ki egymast.

Ebben a formaban, tenyszeruen igaz. Kihozta az RT-t, RT jobban ment a hardveren.

Kihozta a felskalazot, jobb minosegben, tobb jatekkal, jobb supporttal (DLSS 4 7 eves generacion) es sorolhatnank."Egyebkent befejezhetned ezt a folyamatos akadekoskodast"

Nem ertem mi a gond az objektivitassal es a tenyszeru vitaval. Engem inkabb zavarnak a hasrautott kommentek, amik 2 perc utananezessel cafolhatoak. -

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

Van is hozzá driver fél éve. Most csak a végfelhasználói driverbe került bele. Viszont a játékok még nem használják PC-n. Ennek az oka, hogy a Work Graphs futószalagja nem kompatibilis a hagyományos futószalaggal. Tehát, ha erre fordítanak le egy UE5 játékot, akkor az nem fog elindulni azokon a hardvereken, amelyek nem támogatnak mesh shadert. Emellett még van egy igen fontos követelmény a parancsmotorra, ami funkcionálisan ugyan nem okozza a Work Graphs futtathatatlanságát, de a helyzet az, hogy ha nincs teljesítményben erre kigyúrva a parancsmotor, akkor a Work Graphs lassítani fog a feldolgozáson, ha a munkamenet nincs kifejezetten a Work Graphs futószalagjára kigyúrva, de akkor meg azért gyorsul, mert túlléped az Execute Indirent határait, és ott nem nehéz az 1 fps-nál jobban elérni, mondjuk 5 fps-t. Gyakorlati haszna ugyanúgy nincs.

A jelenlegi játékok nem ilyenek, ha csak a jelenlegi jellemző futószalag mellett cseréled az Execute Indirectet Work Graphs-ra, akkor azt tapasztalod, amit a legtöbben, hogy az RDNA 3-on és RDNA 4-en hoz tempót, de máshol lassít. Az Xbox Series X-en azért gyorsít, mert a Microsoft két különálló parancsprocesszort használ, de az RDNA 2-ben, a PC-s verzióban csak egy van ebből a hardverben, és nem is ugyanolyan, amit a Microsoft alkalmaz. Emiatt RDNA 2-re már rég elvetették a Work Graphs funkciót, mert ugyan funkcionálisan megoldható, de -30% az eredménye. Mivel nem erre tervezték a hardvert, sosem fogják tudni megoldani azt, hogy az RDNA 2 PC-s változata a Work Graphs funkcióval gyorsabb legyen, mint Execute Indirecttel. A jelenlegi környezeteben ezt a teljes iparág kizárólag RDNA 3 és 4 GPU-kon tudja kivitelezni, és ezért nem látsz egy olyan játékot sem, ami Work Graphs API-t igényel. Majd akkor fogsz, amikor az UE5 PCG-je át lesz emelve valós idejűbe, mert akkor a Work Graphs megkerülhetetlen lesz. De az szerintem leghamarabb jövőre esedékes. Tehát a Work Graphs API-s játékok úgy 2027-ben jöhetnek.

SER már van fejlesztői driverben, de mivel a fejlesztők nem törik magukat azon, hogy támogassák, így majd akkor lesz bevezetve leghamarabb, ha lesz olyan program, ami kéri.

-

PuMbA

titán

PuMbA

titán

Ezen én is felhúztam a szemöldököm, hogy eddig miért nem volt, hiszen abban a tudatban voltam, hogy ez van, hiszen alap

De most már érthető, hogy miért volt az összes Work Graphs írásukban 7900XTX példaként. Ebben az új 25.20-as driver branch-ben ezek szerint tömérdek újdonság lesz november végén, aminek látjuk az előszelét.

De most már érthető, hogy miért volt az összes Work Graphs írásukban 7900XTX példaként. Ebben az új 25.20-as driver branch-ben ezek szerint tömérdek újdonság lesz november végén, aminek látjuk az előszelét. -

T.Peter

őstag

T.Peter

őstag

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

-

PuMbA

titán

PuMbA

titán

-

Alogonomus

őstag

Alogonomus

őstag

-

S_x96x_S

addikt

S_x96x_S

addikt

Én se vagyok game engine programmer, ráadásul az "art"-hoz se értek,

de az adatokhoz igen.az én megértésem:

> Mint ahogy írtam, ami nincs a memoriaban,

> az nem fog megjelenni, szoval nem lehet arra támaszkodni, ami meg nincs ott.pontosabban - több memória elérési réteg van[2]

( cache(SRAM) -> VRAM -> (rendszermemória) -> diszk .. )

és egy open world -os játéknál ( pl. MS Flight sim ) egyáltalán nem fér be minden a VRAM-ba, és hogy folyamatos legyen a játék-érzet, kell pár trükk;

pl. a PC-s rendszer memóriát kell használni gyorsító cache-nek.

Vagyis onnan rántják be a VRAM-ba az újabb és újabb adatokat - ahogy mozog a játékos az open-world-ben.

A PS5-nél viszont nincs nincs akkora rendszermemória, ami

tcachelésre is lehetne használni

és emiatt fontos, hogy milyen gyorsan lehet berántani

az adatot a PS5 VRAM-ba a diszkről - 22 GB/s - es [1],

és ez már pariban van a PC-s rendszermemóriából való olvasással.

( ~ durván, leegyszerűsítve ; A PCIe Gen4 8x -nál több )Jelenleg egy PC-s játékgép ideális rendszermemóriája már 32GB -nál tart, aminek a szerepe nagyrészt VRAM cachelés (és amit a PS5 -nél már beleterveztek a rendszerbe)

--------

[1] "The PS5 team enlisted the use of Kraken (and Oodle Texture) to complement the console’s I/O system, with Cerny stating that the combination of the tool and the PS5’s fast SSD could lead to 22 GB/s bandwidth with well-compressed data." ( via )

[2]

"But when the GPU carries out a shader routine that requires a texture or render target sample, the first place it will look for that data is the first level of cache. If it's not there, then the processor will work through the remaining levels, and ultimately the VRAM, to find it.

When all these searches result in a miss, then the data has to be copied across from the system memory into the graphics card, and then into the cache. All of this takes time, so the GPU will just stall the shader instruction until it has the required sample. Either the game will just pause momentarily until the routine is complete, or abandon it altogether, leading to all kinds of glitches."

https://www.techspot.com/article/2670-vram-use-games/[3]

bónusz; ha valakit érdekelne, hogy milyen egy VRAM probléma hibakeresése:

és hogyan swappel a VRAM a rendszer memóriába - azoknak érdekes lehet:

"How I Resolved my VRAM Overflow Issues in DCS World" (2023)

https://www.youtube.com/watch?v=y7jkkGNKVV8 -

S_x96x_S

addikt

S_x96x_S

addikt

én valami ilyen válaszra vártam volna:

Egy PS5-ös egy open world (nyílt világú játékot)

16 GB memória (RAM + VRAM kombináció)-val megoldja,

mert a gyors SSD + az optimalizált tömörítési megoldások (KRAKEN) ezt lehetővé teszik.

De ugyanez a játék PC-n sokszor 32 GB RAM-ot és 12-16 GB VRAM-ot igényel,Vajon miért ?

-

Busterftw

nagyúr

Busterftw

nagyúr

-

S_x96x_S

addikt

S_x96x_S

addikt

ha viszont nincs Kraken ( 8-22Gb/s ) -es gyors adatbetöltés

akkor mennyivel több VRAM -kell egy konzolon,

ahhoz hogy ugyanaz az open-world játék - hasonló minőségben müködjön?

Szerintem több VRAM-al lehet megoldani.

PC-n a Microsoft's DirectStorage API -ja valami hasonlót próbál implementálni, de az még nem annyira hatékony. -

S_x96x_S

addikt

S_x96x_S

addikt

> Szerintem nem sok koze van a bcpack-nek es a kraken-nek a memoria meretehez.

Open world játékoknál hasznos;

A segítségével gyorsabban ( ~ a játékosok számára észrevétlenül )

be tudja rántani a memóriába a szükséges adatokat

és emiatt a VRAM sokkal dinamikusabban és hatékonyabban használható ki,

mivel nem kell olyan sok adatot egyszerre a memóriában tartani.És ha nem lenne ilyen megoldás, akkor sokkal több VRAM kellene.

-

huskydog17

addikt

huskydog17

addikt

-

PuMbA

titán

PuMbA

titán

-

PuMbA

titán

PuMbA

titán

Unreal Engine 5 MegaLights Demo - Technology Explained

Itt elmondják, hogy egy doksiban látták, hogy ReSTIR "testvér" megoldással csinálták. Na meg a limitációkat. A Cyberpunk-hoz hasonló RT limitációkat láthatunk, ami biztosan ReSTIR-rel megy. Fény akkumuláció miatti lassú reakció, szemcsésedés.

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

A metszésvizsgálat csak hardveresen van implementálva, ez kell a teljesítményhez. És ehhez kell a hardverből a textúrázók mellé helyezett részegység.

Olvasd el, hogy mit írtam. Az ami hiányzik a PC-s API-ból helyettesíthető compute shaderrel. Nem azt mondom, hogy optimális, de működik. Csak hatékonyabb, ha erre van eredetileg szabva egy API, és ilyenje van a PS5-nek. Az egész egyébként hasonlít az Intel-féle MPLB-re. Ez adhatta az Epyc-nek az ötletet. Amikor az Intel prezentálta ezt pár éve, akkor is a meglévő hardvereken oldották meg, csak OpenCL API-n. De igazából az API nagyrészt mindegy, mert a compute shader is alternatíva. Megoldhatta volna az Intel is így. A compute shader azért hasznosabb, mert nem kell API interaoperability, szimplán használhatod a DXR-rel a metszésvizsgáló hardvert, ami van a GPU-kban, miközben számolsz az ALU-kkal olyat, amire nincs még megoldás az API-ban.

Ez tényleg egy nagyon ügyes megoldás, és kifejezetten hatékony, mert PS5-ön egész jól fut, miközben a minősége igen kellemes. Valszeg PC-re is jó lesz a sebesség, csak bonyolultabb, de ki tudja, lehet, hogy jövőre már érkezik olyan DXR verzió, amire rászabható.

-

X2N

őstag

X2N

őstag

Fejlesszék csak, jobb lesz mint az nvidia féle RTX. Mindezt a fortnitozó srácoknak köszönhetjük hogy van erre pénze az Epic-nek... Nem kell hozzá dedikált nvidia hardver és gyors is lesz...

nvidia mit is fejlesztett szoftveresen az RTX-en amióta kijött 6 éve? A bányászattal, DLSS-el többet foglalkoztak az utóbbi 6 évbe most meg az AI-al, az RTX-el összesen, a Remix nem fogja megváltani a világot...az se segít hogy kiadnak jövőre egy 2x gyorsabb kártyát. Ha ilyen ütembe növekszik a teljesítmény nem fogunk RT-vel játszani 10 év múlva se, az igények is növekednek...

nvidia mit is fejlesztett szoftveresen az RTX-en amióta kijött 6 éve? A bányászattal, DLSS-el többet foglalkoztak az utóbbi 6 évbe most meg az AI-al, az RTX-el összesen, a Remix nem fogja megváltani a világot...az se segít hogy kiadnak jövőre egy 2x gyorsabb kártyát. Ha ilyen ütembe növekszik a teljesítmény nem fogunk RT-vel játszani 10 év múlva se, az igények is növekednek... -

PuMbA

titán

PuMbA

titán

A Black Myth Wukong Unreal Engine 5.0-ára épül sajnos, látszik, ha az exe-t megnézed. Nincs lehetőség ezekre, mert az első verzióban gyakorlatilag minden béta állapotban volt és csak 5.1-re lett stabilnak nyilvánítva, ekkor kezdte a Fortnite is használni a Lumen-t / Nanite-ot / Virtual Shadow Maps-ot

Amit ezzel a kezdetleges UE verzióval kihoztak belőle az csoda.

Amit ezzel a kezdetleges UE verzióval kihoztak belőle az csoda.hahakocka: Igen, érthető

UE 5.4 is van már. Ebben már a sebesség is sokkal jobb, mert elkezdték az optimalizációt.

UE 5.4 is van már. Ebben már a sebesség is sokkal jobb, mert elkezdték az optimalizációt. -

PuMbA

titán

PuMbA

titán

Pontosan így van. Szerencsére a DLSS az AI jóvoltából ezeket a helyzeteket is jól kezeli, ha nincs motion vector, ezért néz ki vele teljesen jól a víz is

Amikor kijöttek az FSR 3.1 kontra DLSS kontra XeSS videók, akkor a víz probléma jól látszott más játékokban is az FSR-rel.

Amikor kijöttek az FSR 3.1 kontra DLSS kontra XeSS videók, akkor a víz probléma jól látszott más játékokban is az FSR-rel.Aki jó képminőséget akar, annak NVIDIA-t kell vennie, de ezt itt már rongyosra beszéltük. Az AMD nem "for the gamers", így az AMD-seknek csúnya víz jár.

-

Ribi

nagyúr

Ribi

nagyúr

-

X2N

őstag

X2N

őstag

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

Ez önmagában orbitális baj, hogy butítani kell a geometriát. De nem azért, mert a hardver nem bírná, hanem azért, mert a DXR nem engedi neked, akkor beállítani a LOD-ot, amikor tudod, hogy mire lenne szükséged. Akkor kell beállítani, amikor még fogalmad sincs róla, hogy mi a helyes részletességi szint. Tehát ez nem egy hardveres akadály, hanem magából az API-ból hiányzik az a programozhatóság, amivel megvalósítható lenne a részletesebb sugárkövetés.

Szóval vagy elfogadod, hogy szarok az API által biztosított lehetőségek, vagy csinálsz egy gyorsabb szoftveres kerülőutat.

#65027 Albus_D : Nem fog eltűnni a hardveres sugárkövetés, mert a metszésvizsgálatra ez nagyon is kelleni fog. De az egy masszív akadályozó tényező, hogy a bejárást nem tudod programozni, így nem tudod előre eldönteni, hogy mi az optimális részletesség. Nem véletlen, hogy az Epic vagy az Ubisoft szoftveres kerülőutakat csinál. Egyszerűen production ready szintre marha nagy akadály, hogy nem változtatható meg a LOD szint, amikor kiderül, hogy mire lenne szükség. Tehát vagy a részletesség lesz szar, vagy a memóriát pazarlod, és ha nagyon pazarlod, akkor hiába gyors BVH, ha utána minden más futószalaglépcső szenved a 32 GB/s-os PCI Express limittől. Ezt a részét a DXR-nek már most többen kicserélik compute shaderre, hogy az ALU-kon fusson. A fixfunkciós metszésvizsgálattal viszont mindenki elégedett, senki sem cserélte le szoftveresre.

Teljesen mindegy, hogy raksz egy V12-es egy kocsiba, ha biciklikerekeket használsz hozzá.

-

PuMbA

titán

PuMbA

titán

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

Az Epic ugye AMD-n fejleszt, ők az elsődleges hardverpartnerek, és nyilván tele van nyomva az Epic Threadripper+Radeon gépekkel. Tehát az ilyen kvázi fejlesztés alatt álló szabványos funkciók mindig AMD-n vannak prezentálva, ha PC-ről van szó. Szóval ez nem meglepő.

A Work Graphs egyébként AMD szabadalom. Az NV DGC-t akarta szabványosítani, de se a Khronos, se a Microsoft nem azt választotta, hanem az AMD-féle megoldást. Ennek a fő oka az, hogy a DGC-t nagyon nehéz lenne támogatni az ultramobil hardverekkel, míg az AMD megoldását viszonylag egyszerű. Eközben amire kell azt nagyjából mindkettő biztosítja. Szóval végeredményben ezért van most szabványosítva a Work Graphs. Hardveresen egyébként ezt nem nagy kunszt támogatni, a mai modernebb GPU-k megfelelnek hozzá. Annyi biztos, hogy mindegyik hardveren előnyt jelent, ezt már a Microsoft megerősítette egyszer, de persze az előny mértéke függ a hardver felépítésétől. De támogatni érdemes, mert mindenen pluszt hoz.

-

Petykemano

veterán

Petykemano

veterán

-

Raymond

titán

Raymond

titán

-

PuMbA

titán

PuMbA

titán

Igen, elnézést. A GPU decompression része került zsákutcába. A CPU-s része sokkal szabadabb és gyorsabb a jelenlegi implementációkban és a Nixxes már ezt használta a Horizon Forbidden West-ben.

Ratchet & Clank-ban volt / van a GPU decompression használva, de lassabb lett a PS5-től betöltési időkben, míg a Horizon Forbidden West a CPU-s megoldással még kicsit gyorsabb is, mint a PS5-ös változat betöltési sebessége a tesztek alapján

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

Az a videó nagyon releváns, mert ha nem korlátozod nagyon a sugarak pásztázási távolságát, akkor muszáj egy rakás memóriát pazarolni. Az UE5-nél ez úgy megy, hogy lekorlátozod nagyon az RT működési távolságát, és kész. De ez nem megoldás. Ez egy korlátozás. Persze értem, az Epic abból főz, amije van, de jelenleg nem nagyon tudnak mást csinálni.

Az XSX teljesen más API-t használ. A Microsoft kínál egy mono hozzáférést a konzoljához, így ott van programozható bejárás, és így vannak LOD szintek is. Az Xbox konzoljának API-ja eleve úgy működik, ahogy abban a videóban a megoldásként aposztrofált technika, és azt használják is a motorok. PS5-nél dettó ugyanez. A PC-s DXR viszont sokkal limitáltabb, mint a konzolos alacsony szintű hozzáférések. Tehát az, hogy a konzolon működik valami nem sokat jelent, mert a konzolos RT API-k sokkal jobbak.

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

Az Unreal Engine 5 egy motor. Azzal akármit tehetsz, de nem fognak tenni vele akármit, mert nagyon nagy a geometriai részletessége, ha a Nanite használva van. Még régebben volt egy előadás, hogy miért baj ez, itt le lehet tölteni: [link] - 6:53-nál látszik, hogy a DXR miért működik irtó szarul. Nem is látszik az objektum a kamerában, de mégis ott kell lennie a memóriában. Az Intel compute shaderes megoldásával nem (ez amúgy nagyon hasonló ahhoz, amit az Ubisoft használ, vagy ahogy a Brixelizer működik). Tök jó, hogy a motor lehetőséget ad a DXR-re, csak cseszheted az egészet, ha nincs elég memóriád arra, hogy elviselj az RT miatt 10-15 GB-nyi overheadet. Tényleg nagyon-nagyon tanulságos az az előadás, hogy miért vérzik az egész DXR, és miért nem láttok áttörést a játékokban, annak ellenére, hogy a motorokban, ott van egy rakás funkció, az Unreal Engine 5-ben is. Mi is használja úgy, ahogy a motor lehetőséget ad rá? Ja igen, semmi.

-

b.

félisten

b.

félisten

-

PuMbA

titán

PuMbA

titán

Render time-ra mínusz 50%-ot, a GPU time-ra mínusz 25%-ot mondtak

Utóbbi amiatt, hogy gyorsabb lett a Lumen, árnyékok és az RT. Valamint megérkezett a variable rate shading Nanite-ra és javítottak az instance culling sebességen is.

Utóbbi amiatt, hogy gyorsabb lett a Lumen, árnyékok és az RT. Valamint megérkezett a variable rate shading Nanite-ra és javítottak az instance culling sebességen is.Hubba12: Csak ha majd váltanak UE5.4-re.

-

M@trixfan

addikt

M@trixfan

addikt

-

PuMbA

titán

PuMbA

titán

-

Raymond

titán

Raymond

titán

A bonusz meg ennel az upgrade-nel az is ahogy a hirekben az van, hogy 3x gyorsabb lesz mert az 33 TFLOPs van a az aktualis 10 helyett csak valahogy ignoralva van az hogy ez a 33 jo eselyel az RDNA3-as dual issue amit meg latjuk a 7800XT vs 6800XT eseteben hogy mennyit er. Aztan a PS5-nel lehet jobban kihasznaljak majd vagy jobban tudnak belole valamit kicsikarni, de a valosag inkabb az hogy ez igy nem 3x hanem 60-70%-al gyorsabb mar ami a TFLOPs-ot illeti.

-

M@trixfan

addikt

M@trixfan

addikt

Én ezt elfogadom, mert akár lehet így is, én az architektúra egészét elemeztem. A gond azzal van, hogy jelen konzol generáción az UE5 nem fut jól, lásd az összes UE5 játék és a GPU kevés. Tehát logikailag nem változtat a dolgon az említett CPU ütemezési probléma. “Imortals of Aveum” és társai az ékes példák 720p 20fps mellett és ebben, nem emlékszem már, lehet nincs is Lumen, se Nanite. Az ütemezési problémát a fix hardware esetén szerintem megoldják egy custom build-del, de ez UE5 specifikus amúgy is, nem jelenti azt, hogy IPC probléma lenne általánosan, mint pl. a harmatgyenge Jaguar magoknál anno.

-

PuMbA

titán

PuMbA

titán

"Nem hiszem, hogy konnyebb dolguk lenne csak a hardver miatt optimalizalas szempontjabol."

Nem csak az optimalizálás, de azt gondolom az is sokat számít, hogy textúrákat se kell olyan részletesen megcsinálni, nem kell foglalkozni a szuper részletes modellek megalkotásával

Ez azért sok időt vesz el egy fejlesztésben. Egy Switch játékban sokkal egyszerűbb rendszerek, például fizikai motor van, mint egy PS5-ös AAA játékban, hiszen a CPU is vagy 10-szer gyengébb. Ugyanúgy, ahogy a PS2 érában is, a játékok nagy része nagyon egyszerű volt.

Ez azért sok időt vesz el egy fejlesztésben. Egy Switch játékban sokkal egyszerűbb rendszerek, például fizikai motor van, mint egy PS5-ös AAA játékban, hiszen a CPU is vagy 10-szer gyengébb. Ugyanúgy, ahogy a PS2 érában is, a játékok nagy része nagyon egyszerű volt.Jöjjön egy topikba vágó dolog akkor:

Az AMD emelte a részesedését a GPU piacon, de a 6000-res szériával és nem a 7000-ressel. A 7000-res széria az elmúlt 20 évre visszamenőleg a leggyengébb széria lett, semmiféle befolyást nem tett a részesedési számokban.

-

PuMbA

titán

PuMbA

titán

Igazából nem tudom

A programozók valahogy saját maguk kritikusai is. Én tudom, hogy vannak régebbi munkáim, ami egyszerűen gyalázatosak, illetve a programozás maga nem csak egyes embereken múlik, hanem az egész csapaton.

A programozók valahogy saját maguk kritikusai is. Én tudom, hogy vannak régebbi munkáim, ami egyszerűen gyalázatosak, illetve a programozás maga nem csak egyes embereken múlik, hanem az egész csapaton.A Starfield 6 hónap alatt 97%-ot esett játékosszámban, sokkal kevesebben játsszák már, mint a 15 éves Skyrimet vagy bármilyen más Bethesda játékot. Maguk a programozók rosszak? Nem, csak senki sem ült le a 8 év fejlesztés közben játszani a játékkal, hogy valójában megéri-e csinálni, tényleg jó / élvezetes játék lesz? Egyszerűen a menedzsment orbitálisan benézte a dolgot.

-

PuMbA

titán

PuMbA

titán

-

Yutani

nagyúr

Yutani

nagyúr

-

Busterftw

nagyúr

Busterftw

nagyúr

-

b.

félisten

b.

félisten

Köszi megnéztem .

Úgy látszik ők már látták a LoU1 ben. Érdekes, kissé kettős dolgokat írnak, meglátjuk a valós eredményeket :"Az AMD kissé óvatos volt, amikor megmutatták nekünk a TLOUp1 demót, mert még korai volt, és a csak optikai áramlást biztosító megoldás a legtöbb tartalomban nem fog megfelelni az FSR 3 vagy a DLSS 3 minőségének. Ez egy nyilvánvaló korlátokkal rendelkező technológia. Véleményünk szerint ezt felülmúlja az a tény, hogy minden DX11-es vagy DX12-es játékkal működnie kell"

Minél többet használ egy játék az aszinkron számítást, annál kevesebb erőforrás áll rendelkezésre az FSR 3 számára, ami azt jelenti, hogy az interpolált keret létrehozásához szükséges idő hosszabb. Azonban fordítva, minél kevesebb aszinkron számítást használ a játék, annál gyorsabban számítja ki az FSR 3 optikai áramlást. Ez a szoftver alapú megoldás nem csak azt jelenti, hogy az FSR 3 bármelyik gyártó GPU-ján futni fog"Valószínűleg a framegen nem lesz túl acélos megoldás, nagyjából egy szabványos interpoláció, cserébe mindenen szinte működni fog.

Amit nem láttam, hogy a IGP/ APU-k támogatottak? -

hahakocka

őstag

hahakocka

őstag

Unreal 3-4 ből is voltak csodaszép gamek és rusnyák. Fejlesztőtől függ mit hoz ki belőle. Az azért nem jó hír ha egy 6800xt ennyit fog érni benne.... Optimalizálás kuka? Pedig emlékeztek mit ígértek az UE5 re annó a bemutatásakor? Kb alig kell majd a fejlesztőknek optimalizálni mert az engine maga el tud végezni sokféle optimalizációs lépcsőt s utána csak símítani kell. Hát nem úgy néz ki egy ideje

-

Komplikato

veterán

Komplikato

veterán

-

S_x96x_S

addikt

S_x96x_S

addikt

> Ki sem jottek meg azok a jatekok amik azt veszik figyelembe

> hogy mit lehet elerni az uj hardware-rel.1.)

még pár nap és GDC és várhatóan sok új játék.

March 20-24, 2023; San Francisco, CAÉs az UE 5.2 és sok más is bejelentésre kerül.

- New Tools for Building Photoreal Worlds in Unreal Engine 5.2

"In this tech talk, we'll take a deep dive into some of the powerful new features and updates in Unreal Engine 5.2. Come learn about new tools that empower artists to quickly and efficiently create large worlds; a paradigm-shifting material authoring system that enables users to focus on how a material is composed, assembled, and layered from slabs of matter to achieve visuals not possible before in real time; and the latest additions to Chaos physics for vehicle and fluid simulation—all showcased in a demo you won't want to miss."

- Battle-testing UE5 Next-Gen Systems with Fortnite

- ...see more:

https://www.unrealengine.com/en-US/events/gdc2023> Ne ragadjunk mar le az eddigi szintnel.

inkább "forward compatibility" ...

Ha ma elkezdenek egy fejlesztést, akkor szükség van a "forward compatibility" -re,

mivel ~2-3-4 év is egy játék kifejlesztése.

https://www.unrealengine.com/en-US/nextgen

"With support for Sony PlayStation 5 and Microsoft Xbox Series X, Unreal Engine is ready for next-gen games. Forward compatibility ensures that even if you start in UE4, you can move everything over to UE5 when you are ready.

Unreal Engine 5 is now available in Early Access, supporting next/current-generation consoles, PC, Mac, iOS, and Android." -

PuMbA

titán

PuMbA

titán

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

Mert amúgy manapság a next-gen az AI-ról és a rombolhatóságról híres?

A legfőbb előnyt az új gépek ott adják, hogy jobb lehet az assettek minősége, mert gyorsabb a dekódolásuk. De az assettek skálázhatók, és innentől kezdve előállítható az a minőség, ami pont jó a régi gépeknek.

#60521 Busterftw : Ezért kell skálázni a grafikát.

-

DudeHUN

őstag

DudeHUN

őstag

-

Alogonomus

őstag

Alogonomus

őstag

A linkelt videód ezen pontjánál válik nyilvánvalóvá, hogy sokkal kevésbé professzionális a tesztelő, mint a HU teszteket készítő Steven. Pont te mutattál rá helyesen, hogy a hw/sw RT együtt nem futhat. Más eljárással működnek. A tesztelő pedig simán kijelenti, hogy "akkor kikapcsolom a hw raytracinget, de továbbra is használja a Lumen-t" A kettő együtt nem használható.

Az édes-selymes tanáros hangját persze szívesebben hallgatja az ember, mint Steven karakán férfias hangját, de szakmailag sokkal képzetlenebb. -

S_x96x_S

addikt

S_x96x_S

addikt

> En az sw/hw kozti elteresrol irtam.

sajnos nagyon nehéz leválasztani a sw és a hw -t az FPS-es eredményről ..

főleg ha a sw-hez hozzátartozik az ABU által említett:

- vajon "a fejlesztők mennyire tartották be az NVIDIA ajánlásait." .. témakör is.

( meg az AMD/Microsoft .. ajánlásait is )a legtöbb (vég) felhasználót ( ~ játékost ) meg

úgyis csak az ár/fps mutató érdekli, ami nagyon változatos ..A játékfejlesztőknek meg kompromisszumot kell kötni a konzolos AMD és a desktop-os nVidia dominancia között - ami nem mindig sikerül és itt az Intel is az ARC -al.

meg van még pár mobil GPU is.Tisztán csak a HW elméleti képessége is érdekes lehet ..

de a Cell procinál (PS3) nem mindig lehetett olyan könnyen gyakorlati teljesítményre átváltani. - vagyis kell a kettőt együtt nézni.Ha félreértettelek volna - akkor elnézést ..

-

S_x96x_S

addikt

S_x96x_S

addikt

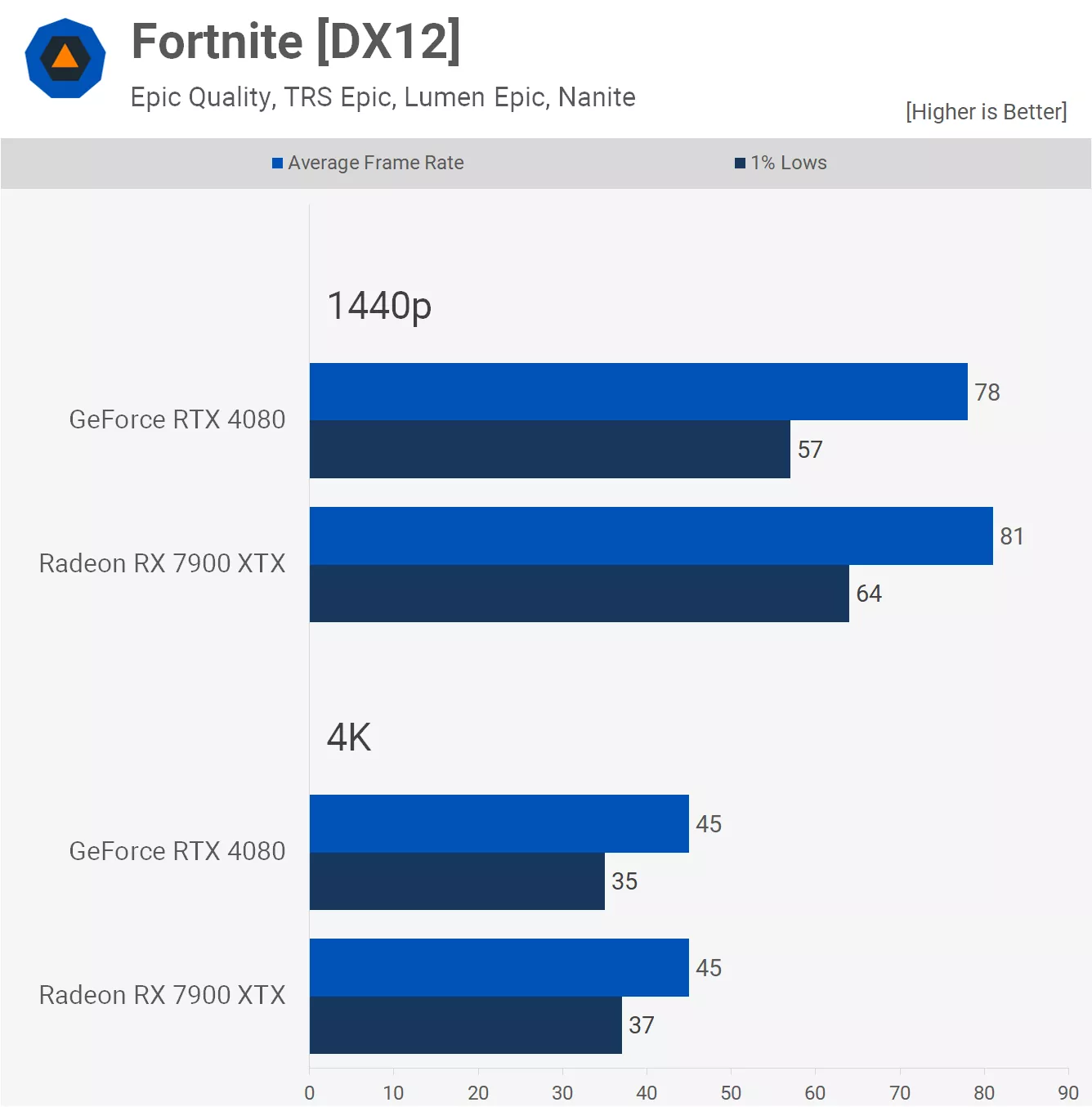

> mert nem sok kulonbseg van frame rate-ben hw rt off/on kozott.

"RT Lumen and Nanite" nincs engedélyezve akkor a 4080 4K-ban egy picit jobb.

Ha meg engedélyezve van, akkor már fej-fej mellett van a 2 GPU.

és ez már jelentős eltérés:4K 7900 XTX Fortnite DX12

- "TRS epic, Lumen Epic, Nanite" ON : 45 fps

- "TRS epic, Lumen Epic, Nanite" OFF : 82 fps <---- -

Petykemano

veterán

Petykemano

veterán

Egyet tudok érteni a felhozott ellenérveiddel.

És én sem azt mondom, hogy ez biztosan be fog következni.A kérdés nem az volt, hogy fog-e változni az, hogy az AMD a konzol hardver beszállítója és ennek megválaszolása közben körül kell járni a lehetséges alternatívákat.

Nem tudom, mennyire szorít a cipő a sonynál. Csak olvasom, hogy a MS negyedévente felvásárol egy stúdiót és nemsokára jöhetnek a cloud native játékok az Azure-ba. Az ha mondjuk exkluziv nem is lesz, de mondjuk mit lép a Sony, ha a MS úgymond a ChatGPT-vel turbózza fel a játékélményt? Nem előre megírt scriptek, hanem valódi dialógus egy RPG-ben? Egyénre szabott játékmenet?

Nekem úgy tűnik, hogy ugyan a Sony még lehet, hogy több konzolt ad el, de hosszútávú kilátásai a MS-Nak jobbak. Ha és amennyiben így van, akkor a Sony kiszorulhat. Amit vagy.elfogad és ennyi, vagy megpróbál erősíteni, ahol lemaradásban van.

Nem csak cloud tekintetében, hanem az AI vonatkozásában is az egyik ász az Nvidia. A vele való partnerség a sonynak cloudot, és AI know-howt hozna, az nvidiának pedig a PS-t vásárlókat és előfizetőket.Ez persze továbbra is csupán egy szcenárió arra nézve, hogy milyen feltételek/körülmények mentén látnám elképzelhetőnek a konzol hardverbeszálllító váltást. Lehet, hogy a sonynak egész más tervei vannak.

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

A 4:4:4 stream dekódolása a Xilinx miatt nem esélyes, mert a Zynq UltraScale+ MPSoC-nak ez a piaca. Ez nem egy hardveres limit, hanem pénzt szed érte az AMD. Az Intel és az NV nem eszi meg a saját piacát, ha ezt engdélyezik a játszótérre, de az AMD dollármilliókat bukna rajta havonta.

-

b.

félisten

b.

félisten

az UE4 és az 5 ugye kettő, neked ezt nem kell bemutatni, szakmabeli vagy ha jól emlékszem. Az 5.1 eddig nem volt NvRTX branch-os November 15 től az új kártyák megjelenésével már bekerült ez is. [link] Megkapta a teljes plugin és beépülő készletet, [link] 15-én lett bejelentve a SER támogatás is [link] beépülő formában és a DLSS3.0 is . Lumen és nanite ugye alap az RTx IO/ Dx 12 -val.

Kollega nem érti meg hogy maga az Unreal mint engine direkt nem köteleződik el egyetlen gyártó irányban, mert nekik az a jó, ha nagyon széles körben tudják használni a fejlesztők a mobil soctól a munkaállomásokig ARM vagy X86 / IOS/ Windows Android. stb fronton.

Az hogy lesznek Amd és Nvidia támogatott játékok, szabják meg valószínűleg, hogy egy fejlesztő majd kinek az eszközkészletével dolgozik majd az UE5 mellé, illetve optimalizál jobban, de ez mindig is így volt szerintem. -

Alogonomus

őstag

Alogonomus

őstag

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

A probléma a Kraken hiánya. Az UE5 erre nagyon épít, hiszen ezzel tömörítik a geometriát, és ezt PC-n lehet is használni, például a 32 magos Threadrippereken simán kiváltod a PS5 fixfunkciós blokkját úgy 20 magból. A maradék 12 mag pedig elég másra. Az Xbox Series S/X-ben viszont nincs elég erőforrás erre, nincs benne szabad 20 mag, és a Microsoft algoritmusa csak a textúrák tömörítését támogatja. Ehhez majd írni kell valami megoldást, ami már készül is, a magok egy része, illetve az IGP együtt dolgozva biztosíthatja a szükséges erőforrást. De a Sony megoldása elegánsabb és hatékonyabb is. A probléma alapvetően az, hogy nincs elég memória a mai rendszerekben, hogy ezt nem streamelve oltjuk meg, és ne tömörített tartalommal. Persze az UE5 egy hosszabb távú projekt, mire ez kész lesz, addigra simán lesznek 32-magos PC-s CPU-k mainstreamben, tehát nem lesz gond 20 magot ellőni erre PC-n, de a boxon ez állandó para lesz.

-

cowboy_bebop

őstag

cowboy_bebop

őstag

-

cowboy_bebop

őstag

cowboy_bebop

őstag

Új hozzászólás Aktív témák

-

Fórumok

LOGOUT - lépj ki, lépj be!

LOGOUT reakciók Monologoszféra FototrendGAMEPOD - játék fórumok

PC játékok Konzol játékok MobiljátékokPROHARDVER! - hardver fórumok

Notebookok TV & Audió Digitális fényképezés Alaplapok, chipsetek, memóriák Processzorok, tuning Hűtés, házak, tápok, modding Videokártyák Monitorok Adattárolás Multimédia, életmód, 3D nyomtatás Nyomtatók, szkennerek Tabletek, E-bookok PC, mini PC, barebone, szerver Beviteli eszközök Egyéb hardverek PROHARDVER! BlogokMobilarena - mobil fórumok

Okostelefonok Mobiltelefonok Okosórák Autó+mobil Üzlet és Szolgáltatások Mobilalkalmazások Tartozékok, egyebek Mobilarena blogokIT café - infotech fórumok

Infotech Hálózat, szolgáltatók OS, alkalmazások SzoftverfejlesztésFÁRADT GŐZ - közösségi tér szinte bármiről

Tudomány, oktatás Sport, életmód, utazás, egészség Kultúra, művészet, média Gazdaság, jog Technika, hobbi, otthon Társadalom, közélet Egyéb Lokál PROHARDVER! interaktív

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- NVIDIA® driverek topikja

- Brogyi: CTEK akkumulátor töltő és másolatai

- Gumi és felni topik

- Vigneau interaktív lokálblogja

- Megújult mobilos felület, fórumos ráncfelvarrás a PROHARDVER! lapcsaládon

- Parfüm topik

- Spórolós topik

- Autós topik

- Milyen asztali (teljes vagy fél-) gépet vegyek?

- Kiszivárgott a Xiaomi 17T és 17T Pro teljes specifikációja és eurós ára

- További aktív témák...

- HP Z420 Workstation,Xeon E5-1620 CPU,8GB RAM,500GB SATA3 HDD,WIN10

- Telefon felvásárlás!! iPhone X/iPhone Xs/iPhone XR/iPhone Xs Max

- Konzol felvásárlás!! Playstation 5, Playstation 5 Pro

- HP EliteBook 735 G6,FHD,13.3",AMD Ryzen 5 3500U,8GB DDR4,256GB SSD,WIN11

- Dell Precision 5570! 4K Touch / i7-12800H / RTX A2000 / 32GB DDR5 / 512GB NVMe! BeszámítOK

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Érdekes dolgok mennek ebben a boltban.

Érdekes dolgok mennek ebben a boltban.

![;]](http://cdn.rios.hu/dl/s/v1.gif)

De most már érthető, hogy miért volt az összes Work Graphs írásukban 7900XTX példaként. Ebben az új 25.20-as driver branch-ben ezek szerint tömérdek újdonság lesz november végén, aminek látjuk az előszelét.

De most már érthető, hogy miért volt az összes Work Graphs írásukban 7900XTX példaként. Ebben az új 25.20-as driver branch-ben ezek szerint tömérdek újdonság lesz november végén, aminek látjuk az előszelét.

nvidia mit is fejlesztett szoftveresen az RTX-en amióta kijött 6 éve? A bányászattal, DLSS-el többet foglalkoztak az utóbbi 6 évbe most meg az AI-al, az RTX-el összesen, a Remix nem fogja megváltani a világot...az se segít hogy kiadnak jövőre egy 2x gyorsabb kártyát. Ha ilyen ütembe növekszik a teljesítmény nem fogunk RT-vel játszani 10 év múlva se, az igények is növekednek...

nvidia mit is fejlesztett szoftveresen az RTX-en amióta kijött 6 éve? A bányászattal, DLSS-el többet foglalkoztak az utóbbi 6 évbe most meg az AI-al, az RTX-el összesen, a Remix nem fogja megváltani a világot...az se segít hogy kiadnak jövőre egy 2x gyorsabb kártyát. Ha ilyen ütembe növekszik a teljesítmény nem fogunk RT-vel játszani 10 év múlva se, az igények is növekednek...