Kalandom egy kívánatos kütyüvel.

A csillagozás a címben nem véletlen  benne minden egyes állításom erős kitételekkel igaz.

benne minden egyes állításom erős kitételekkel igaz.

Ebay-en lehet kapni egy nagyon érdekes hálókártyát, a képességeihez képest nagyon olcsón: Silicom PE3100G2DQIRM-QX4 a becses neve.

és ilyen gyönyörű:

elsőre nagyon csábítóan hangzik, hogy ennyiért 2x100Gbps-es NIC-et vesz az ember, de ha egy kicsit tovább gondolkodunk, akkor azért felmerül ez-az:

PCIe slot-ok

- bizony két darab x16 slot-ra van szüksége, nem egyre (Mellanox ezt kicsit elegánsabban oldotta meg, ők Gen4 x16-ot támogatnak es kész, lefedve az ígért 200Gbps)

- egyetlen hálókartya érdekes lehet magában, de a visszahurkoláson kívül mást nem nagyon lehet vele csinálni (dehogynem!)

itt most álljunk meg kicsit. abszolút nem tipikus, de képzeljünk el egy dual-socket tesztrendszert vagy szimulációs környezetet, ahol az erőforrások megfelelő szétválasztása miatt egyik socket-en kap helyet a tesztelendő rendszer (legyen az akár nativ, akár virtuális gép, konténer, stb) míg a másik socket pedig a teszteléshez szükséges forgalmat generálja. ugye a két socket hozzáfér egymás erőforrásaihoz a QPI-n v UPI-n keresztül, de tipikusan ethernet forgalmat valami hálókártyán akarunk átküldeni. ebben az esetben ha a két PCIe csatlakozót szétosztjuk a két socket között, akkor nyert ügyünk van, egy 100G-s loop-kábellel már tud is beszélgetni egymással a két oldal (sőt, még trükkösebben is, de azt később).

Összeköttetés

- ha pedig az ember két ilyenben gondolkodik, akkor muszáj lesz beruházni közéjük egy (vagy két) 100G-s madzagra is, ami megintcsak nem elhanyagolható befektetés.

mégpedig azért, mert innen kétfelé lehet elindulni: optikán vagy rézen visszük át a 100G-t. a csatlakozó típusa QSFP28, ilyen kábelre lesz szükségünk. rezes változat (avagy DAC) általában olcsóbb, viszont csak pár méternyi távolság áthidalására alkalmas. ezzel szemben az üvegszálas összeköttetés sokkal drágább, de akár sokszáz méter is megoldható vele. (a különböző csatlakozó-típusokról - SFP, SFP+, SFP28, QSFP - majd később esetleg)

- aztán ha még tovább olvasgatunk, akkor jön mégegy érdekesség: a működéséhez szükséges a PCIe sávok szétválasztása.

Bifurkáció

hopp, megállunk. bifurkáció.

ilyen magyar szó nem létezik. [szerk: de bizony! UnA kolléga hívta fel rá a figyelmet, értelmezés pl itt ]

az angol 'bifurcation' szó szerint talán 'kettéágaztatás'-t jelent, de ha PCIe busszal kapcsolatban használjuk, akkor legyen inkább 'szétágaztatás', mert nem csak kétfelé, hanem három- és négyfelé is lehet.

nagyon nagy vonalakban az Intel procikban logikailag négyesével csoportosíthatóak a pcie sávok, tehát amikor van egy x16 slot-od, akkor 4 db ilyen x4 van oda bekötve adatbusz szempontjából. órajel más kérdés, ez később lesz fontos.

- sok lapnál már lehetséges ezt az x16-ot szétválasztani x8x8-ra vagy x4x4x4x4-re de akár x8x4x4-re is. aminek több esetben lehet értelme, de egyik sem túl gyakori. ilyenek pl a következők:

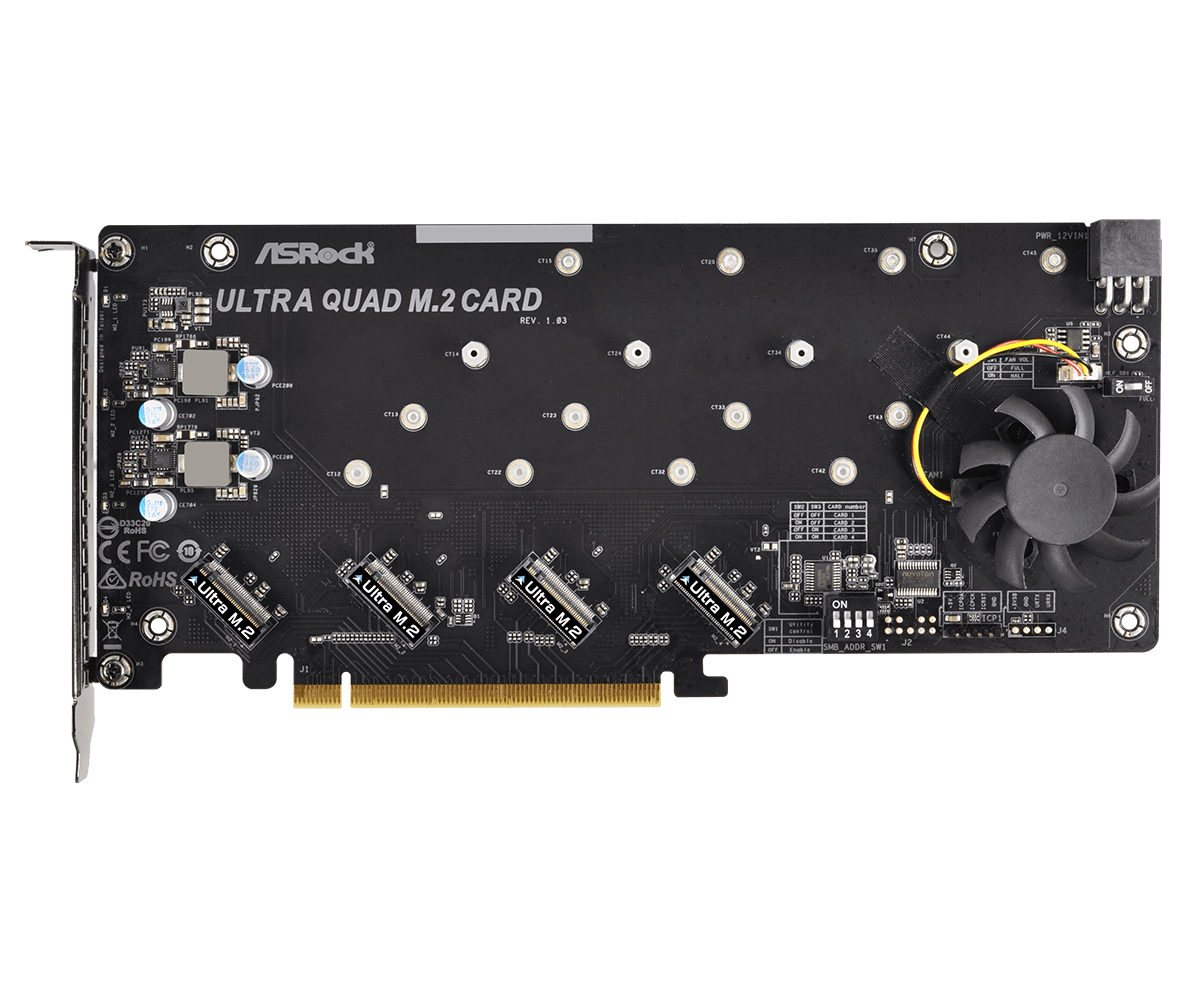

léteznek PCIe->nvme átalakítók, az Asusnak és Asrocknak pl van olyan, ami tud fogadni 4 db nvme m.2 pcie x4 ssd-t. namost, ha ezt bifurkáció nélkül csak bedugod egy x16 pcie slot-ba, akkor abbol tipikusan csak a legelső ssd látszik, a többi nem. ahhoz, hogy 4 eszközt láss, át kell állítani a pcie busz logikai felosztását x16-ról x4x4x4x4-re és akkor látszik az összes meghajtó. (ha csak x8x8-ra állítod, akkor nyilván csak kettő látszik és mindkettő x4-en tud kommunikálni). PCIe riserek használatához akkor is kell, amikor egyszerűen kevés az alaplapon a pcie slot a terveidhez, viszont eszközönként beéred kevesebb pcie lane-nel is, úgyhogy akkor bedugsz egy riser-t, hozzáállítod az adott pcie slot sávjainak a konfigurációját és boldog vagy.

- tipikus felhasználási eset (számomra) az, hogy mivel a mini-itx lapok is csak egyetlen pcie slot-tal rendelkeznek, de szükségem lenne két kártyára, pl egy videokártya mellé akarok hálózati kártyát vagy hangkártyát, capture kártyát, esetleg crossfire-t

- és ott vannak még a szörnyszülött kártyák is, mint pl a bejegyzés alanya: az eleve bifurkációra lett tervezve, két PCIe eszközként kéne látszódjon az óperenciás rendszer számára, de a PCX chip nélkül. (PCX csip az az állat, aki a bifurkáció támogatása nélkül is szét tud osztani pcie sávokat, sok alaplapban használják, ahol pl. az adott proci által támogatott 28 v 40 pcie sávot attól függően kell szétosztani, hány pcie slot-ba dug valamit a felhasználó)

szóval a bifurkáció már nem csak a szerverlapok sajátja, konzumer lapok közül is egyre többen tudják, pl mini-itx méretben egyre nő rájuk az igény.

tehát ennek a Red Rock Canyon kártyának (későbbiekben : RRC) a használatához bifurkáció szükséges, ami pedig nem minden esetben könnyíti meg a használhatóságot. (jaigen, ahogy a processzor-családoknak is van az Intelnél nevük, mint Haswell, Broadwell, Skylake, stb, úgy a legtöbb más terméküknek is, itt egy szép gyűjtemény belőlük)

sajnos akkor sem lehetünk maradéktalanul boldogok, ha megvan a kártya és van alaplapunk, amibe beledugjuk. az történt ugyanis, hogy nincs teljes opensource támogatasa az RRC-nek, tehát amíg hálózati eszközként a kernel számára látszik az fm10k driveren keresztül, addig a PCIe eszköz es a 100G-s fizikai ethernet port között lévő switch felprogramozásának neki sem tudunk állni eleinte. márpedig az nem úgy van konfigolva, hogy automatikusan kilásson a világra, hanem talán biztonsági megfontolásból fekete lyukként működik, amíg át nem állítjuk. na jó, de hogy?! és nem mellesleg, mivel a gyártását beszüntették és a tervezett utódja - a Black Rock Canyon - sosem jelent meg, ezért az fm10k driver sem frissül már.

kedvező kilátások, egyelőre senki ne rohanjon ilyen kártyát venni.

folyt.köv.

![;]](http://cdn.rios.hu/dl/s/v1.gif)